- Detalles

- Categoría: Minitab

- Visto: 550

Por Caitlin Pagano.

Durante todo el mes de marzo, hemos celebrado a las mujeres en ciencia, tecnología, ingeniería y matemáticas (CTIM/STEM) que han transformado nuestra forma de pensar, construir y resolver problemas hoy en día. De las historias que compartimos destaca un tema: algunos de los trabajos más importantes se realizan discretamente, entre bastidores.

Esta historia podría ser el ejemplo más claro de ello.

Porque cada vez que abres una aplicación de mapas, rastreas un paquete o pides un servicio de transporte compartido, te basas en décadas de precisión matemática en las que la mayoría de la gente nunca piensa.

En el centro de esa precisión se encuentra la Dra. Gladys West.

Antes de que el GPS fuera una herramienta, era un problema matemático.

Pensamos en el GPS como satélites que orbitan la Tierra. Pero antes de eso, los…

- Detalles

- Categoría: Minitab

- Visto: 562

Por David Peralta

La Eficiencia Global de Equipos (OEE, por sus siglas en inglés ) es una de las métricas más utilizadas en la fabricación. Mide cuánto tiempo de producción planificado es realmente productivo y ayuda a detectar pérdidas relacionadas con tiempos de inactividad, ciclos lentos y mala calidad.

¿Qué es la OEE y cómo se calcula?

Para la mayoría de los fabricantes, el desafío no reside en la métrica en sí, sino en la calidad de los datos que la respaldan.

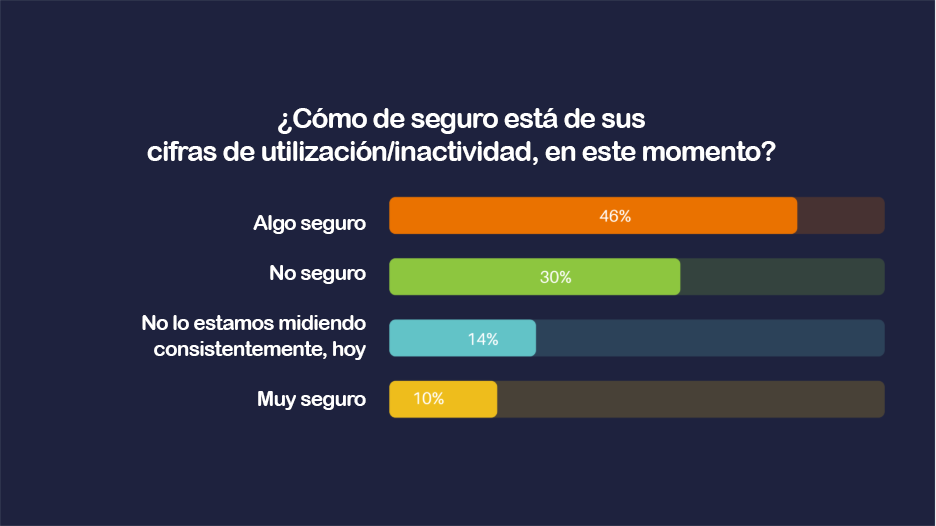

Según un reciente seminario web de Minitab, solo el diecisiete por ciento de los asistentes encuestados miden automáticamente la utilización de las máquinas y el tiempo de inactividad desde los sistemas conectados a las máquinas.

El treinta por ciento de los asistentes encuestados afirma no tener confianza en sus métricas de utilización/tiempo de inactividad. ¿Por qué? Porque…

- Detalles

- Categoría: Minitab

- Visto: 611

Por Peter Goos.

Una conversación con el profesor Peter GoosLa adquisición de Effex por parte de Minitab (ahora Minitab DOE by Effex) incorpora capacidades avanzadas de diseño experimental a un ecosistema analítico más amplio, lo que facilita a las organizaciones el diseño de experimentos más inteligentes, la reducción de costes y la aceleración de la innovación. Para explorar qué significa esto en la práctica, hablamos con el profesor Peter Goos, cofundador de Effex y un experto destacado en diseño estadístico y análisis de experimentos. En esta conversación, explica los fundamentos del Diseño de Experimentos (DOE), por qué sigue estando infrautilizado y cómo los enfoques modernos están cambiando la manera en que las organizaciones abordan la experimentación. |

|

Dentro de la experimentación moderna: del ensayo y error al diseño más…

- Detalles

- Categoría: Minitab

- Visto: 757

Por Stacey McDaniel.

Cuando su metodología ya no encaja

Los proyectos rara vez se desarrollan exactamente como se planearon. Las prioridades cambian. Los requisitos evolucionan. Una metodología que parecía lógica al inicio puede empezar a resultar restrictiva a mitad de la ejecución. Cuando esto sucede, los equipos necesitan adaptarse. El problema es que adaptarse a menudo genera más trabajo del que ahorra.

Es por eso que es importante la nueva función Reiniciar proyectos en Minitab Engage.

Reiniciar un proyecto activo sin perder el progreso

Reiniciar Proyectos permite a los equipos de proyecto o de ingeniería/mejora reiniciar un proyecto activo con una metodología diferente sin perder nada del trabajo original. Si un equipo necesita cambiar de un formato de gestión de proyectos a otro o adoptar una metodología diferente, puede hacerlo…