- Detalles

- Categoría: Minitab

- Visto: 89610

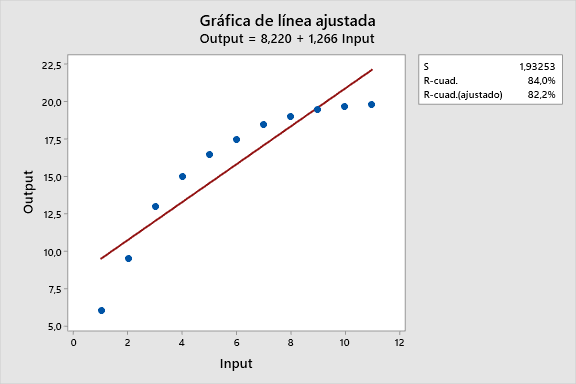

A menudo pensamos en una relación entre dos variables como una línea recta. O sea, si se incremente un predictor en 1 unidad, la respuesta siempre crece en X unidades. Sin embargo, no todos los datos tienen una relación lineal, y el modelo debe de ajustarse a las curvas que presentan los datos.

¡Este gráfico de línea ajustada muestra la tontería de utilizar una línea para ajustar una relación curva!

¿Cómo ajustamos una curva a los datos? Afortunadamente, Minitab Statistical Software incluye una variedad e métodos de ajuste de curvas tanto en regresión lineal como no lineal.

Para comparar estos métodos, ajustaremos modelos a la algo complicada curva del gráfico de línea ajustada. Para otros propósitos, consideraremos que estos datos vienen de un proceso físico de bajo ruido que tiene una función curva. Queremos predecir con precisión la salida dada la entrada.

Ajustar curvas con términos polinomiales en regresión lineal

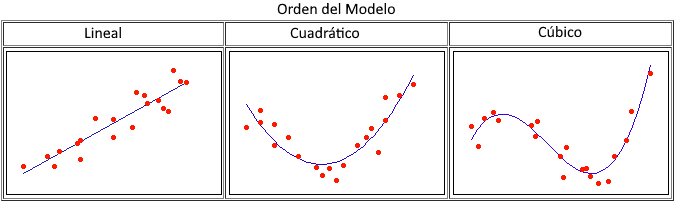

La forma más común de ajustar curvas a los datos utilizando la regresión lineal es incluir términos polinomiales, como predictores cuadráticos o cúbicos.

Típicamente, se escoge el orden del modelo por el número de curvas que se necesitan en la línea. Es muy raro utilizar más que un término cúbico.

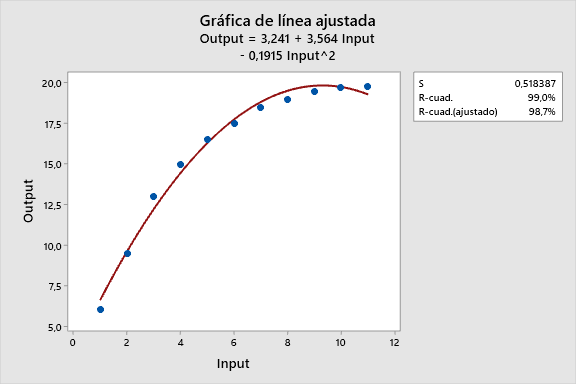

El gráfico de los datos parece tener una curva, por lo que intentaremos ajustar un modelo lineal cuadrático utilizando Estadística > Regresión > Gráfica de línea ajustada

Mientras el coeficiente de determinación R-cuadrado (R2) es alto, el gráfico de línea ajustada muestra que la línea de regresión sistemáticamente sobre- e infra- predice los datos en diferentes puntos de la curva. Esto muestra que uno no siempre se puede fiar de un R-cuadrado alto.

Veamos si podemos hacerlo mejor.

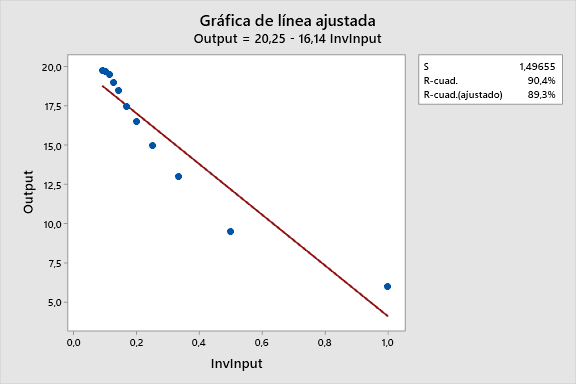

Ajuste de curvas con términos recíprocos en regresión lineal

Si los datos de respuesta descienden a un suelo, o ascienden a un techo a medida que la entrada crece (por. ej., se aproximan a una asíntota), se puede ajustar este tipo de curva en una regresión lineal incluyendo el recíproco (1/X) de una variable predictora más en el modelo. De forma más general se desea utilizar esta forma cuando el tamaño del efecto para una variable predictora decrece cuando su valor crece.

Como la pendiente es una función de 1/X, la pendiente se hace más plana cuando crece X. Pare este tipo de modelo, X nunca puede ser igual a 0 porque no se puede dividir por cero.

Observando los datos, parece que se aplanana y se aproximan a una asíntota en algún punto alrededor de 20.

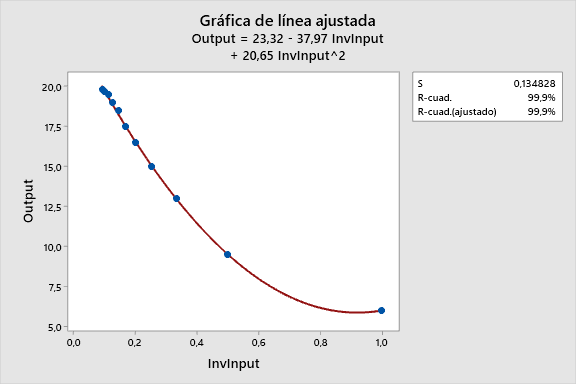

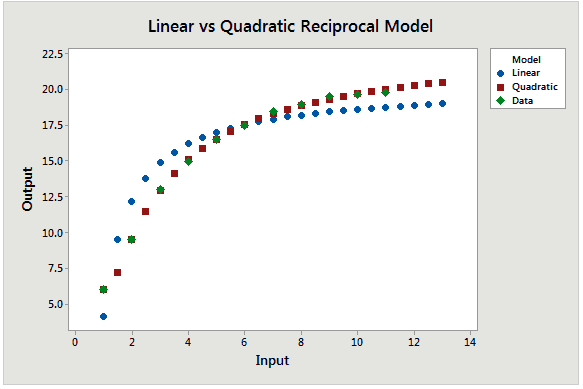

Utilizando Calc > Calculadora para crear una columna 1/Input (InvInput). ¡Veamos cómo funciona! Lo ajustamos tanto con un modelo lineal (arriba) como con uno cuadrático (abajo).

Para este ejemplo en particular, el modelo recíproco cuadrático se ajusta a los datos mucho mejor. El gráfico de línea ajustada cambia el eje X a 1/Input, por lo que es difícil de ver la curvatura natural de los datos.

En la gráfica de dispersión inferior, se utilizan las ecuaciones para dibujar los puntos ajustados para ambos modelos en la escala natural. Los puntos de datos verdes claramente se acercan más a la línea cuadrática

Comparado con el modelo cuadrático, el modelo recíproco con el término cuadrático tiene un valor S más bajo (bien), mayor R-cuadrado (bien), y no muestra predicciones desviadas. Así que hasta ahora este es nuestro mejor modelo.

Transformar las variables con funciones logarítmicas en regresión lineal

Una transformación logarítmica es un método relatívamente común que permite a la regresión lineal realizar ajustes de curvas que de otra forma solo serían posibles con regresión no lineal.

Por ejemplo, la función no lineal:

Y=eB0X1B1X2B2

puede expresarse en forma lineal como:

Ln Y = B0 + B1lnX1 + B2lnX2

Se puede tomar el logaritmo de ambos lados de la ecuación, como arriba, lo que se conoce como la forma doble logaritmo. O se puede tomar el logaritmo de solo un lado, conocida como la forma semilogaritmo. Si se toman los logaritmos en el lado del predictor, puede ser para todos o solo algunos de los predictores.

Las formas funcionales logarítmicas pueden ser bastante potentes, pero existen demasiadas combinaciones para entrar en detalles en esta visión general. La elección de doble logaritmo versus semilogaritmo (para la respuesta o los predictores) depende de la especificidad de los datos y del conocimiento del área temática. En otras palabras, si se coge este camino se necesitará investigar un poco.

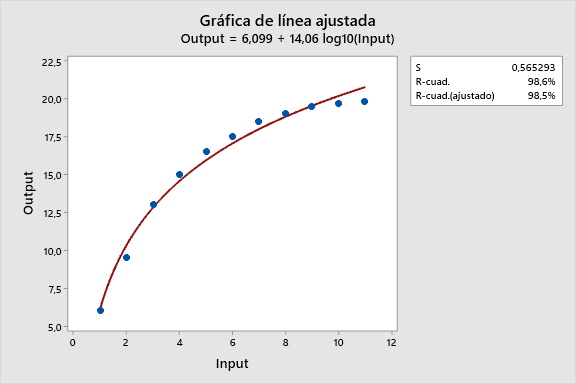

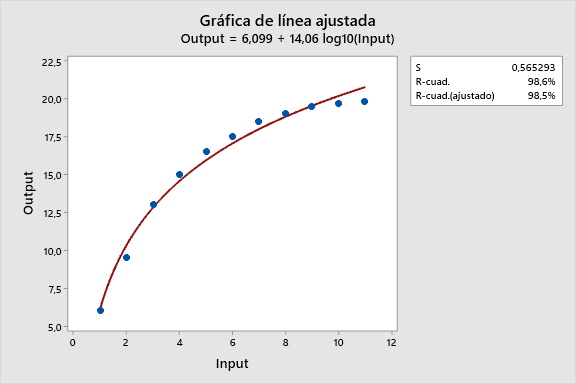

Volviendo al ejemplo. Para datos donde la curva se aplana a medida que el predictor crece, un modelo semilogarítmico de los predictores puede ajustar. ¡Intentémoslo!

El gráfico de línea ajustada de Minitab dispone convenientemente de la opción para transformar logarítmicamente uno o ambos lados del modelo. Así que se ha transformado solo la variable predictora en el gráfico de línea ajustada inferior.

Visualmente podemos ver que el modelo semilogarítmico sistemáticamente sobre- e infra- predice los datos en diferentese puntos de la curva, igual que el modelo cuadrático. Los valores S y R-cuadrado también son virtualmente idénticos a los de ese modelo.

Hasta aquí, el modelo lineal con los términos recíprocos todavía proporcionan el mejor ajuste para los datos curvos.

Ajuste de curvas con regresión no lineal

La regresión no lineal puede ser una potente alternativa a la regresión lineal porque proporciona la funcionalidad de ajuste de curvas más flexible. El truco es encontrar la función no lineal que mejor se ajusta a la curva específica de los datos. Afortunadamente Minitab proporciona herramientas para facilitarlo.

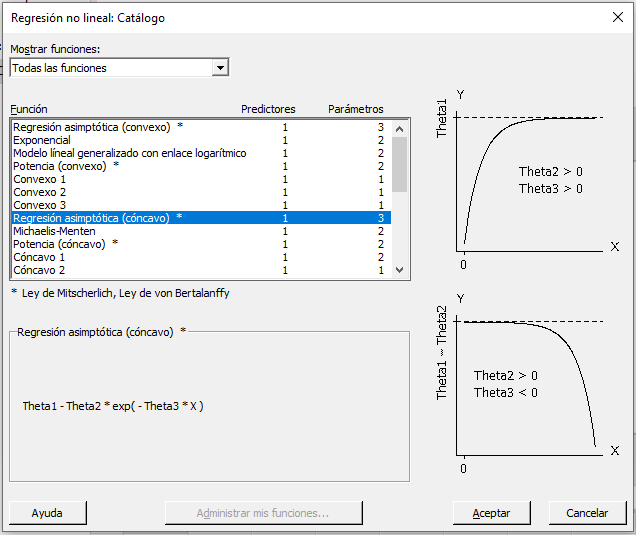

En el cuadro de diálogo Regresión no lineal (Estadísticas > Regresión > Regresión no lineal), entrar Output para Respuesta. Después haga clic en Usar catálogo para escoger entre las funciones no lineales que Minitab proporciona.

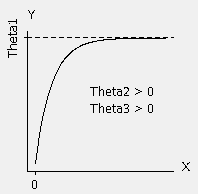

Sabemos que nuestros datos se aproximan a una asíntota, así que podemos seleccionar en las dos funciones de Regresión Asintótica. La versión cóncava se ajusta más a nuestros datos. Seleccionamos esta función y hacemos clic en Aceptar.

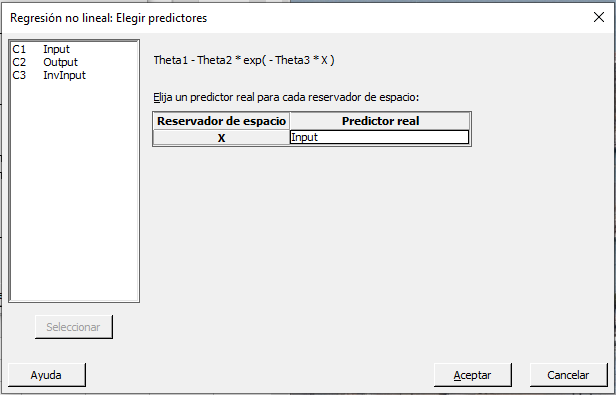

Después Minitab muestra un diálogo donde escogemos nuestro predictor.

Entre Input, clique Aceptar, y volvemos al diálogo principal.

Si hacemos clic en Aceptar del diálogo principal, Minitab muestra el siguiente cuadro de diálogo:

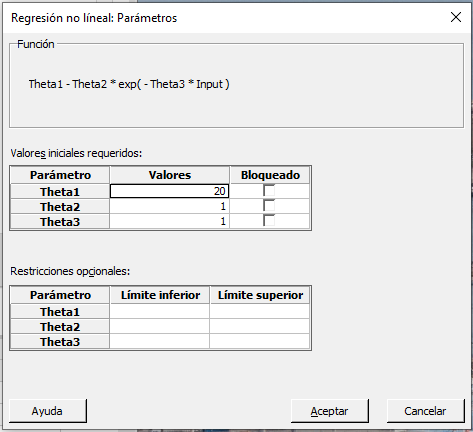

A diferencia de la regresión lineal, la regresión no lineal utiliza un algoritmo para encontrar el mejor ajuste paso a paso. Se necesita proporcionar los valores de arranque para cada parámetro de la función. ¡Vaya, no tengo ni idea! Por suerte Minitaba lo facilita.

Volvamos a la función que escogimos. ¡La figura lo facilita!

Nótese que Theta1 es la asíntota, o el techo, al que nuestros datos se aproximan. A la vista del primer gráfico de dispersión, eso ocurre aproximadamente en 20 para nuestros datos. Par un caso como el nuestro, donde la respuesta se aproxima a un techo cuando el predictor crece, Theta2 > 0 y Theta3 > 0.

Consecuentemente entramos lo siguiente en el cuadro de diálogo:

- Theta1: 20

- Theta2: 1

- Theta3: 1

Después de entrar esos valores, volvemos al diálogo principal, clicamos Aceptar, y ¡voila!

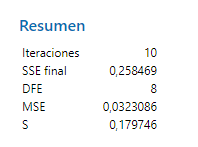

Es imposible calcular R-cuadrado para la regresión no lineal, pero el valor S para el modelo no lineal (0.179746) es prácticamente tan pequeño como el del modelo recíproco (0.134828). Queremos un valor S pequeño porque significa que los puntos de los datos caen más cerca de la línea curva de ajuste. El modelo no lineal tampoco tiene una desviación sistemática.

Comparación de la efectividad del ajuste de curvas de los diferentes modelos

| Modelo | R-cuadrado | S | Ajuste desviado |

| Recíproco-cuadrático | 99.9 | 0.134828 | No |

| No lineal | N/A | 0.179746 | No |

| Cuadrático | 99.0 | 0.518387 | Sí |

| Semilogarítmico | 98.6 | 0.565293 | Sí |

| Recíproco-lineal | 90.4 | 1.49655 | Sí |

| Lineal | 84.0 | 1.93253 | Sí |

Tanto el modelo lineal con el término recíproco cuadrático como el modelo no lineal vencen a los otros modelos. Estos dos modelos superiores producen predicciones igualmente buenas para la relación curva. Sin embargo, el modelo de regesión lineal con los términos recíprocos también produce valores-p para los predictores (todos significativos) y un R-cuadrado (99.9%), ninguno de los cuales puede obtenerse para un modelo de regresión no lineal.

Para este ejemplo, estas estadísticas extra pueden ser convenientes para un informe, aunque los resultados no lineales sean igual de válidos. Sin embargo, en casos donde el modelo no lineal proporciona el mejor ajuste, se debería de proceder con el mejor ajuste.

Últimos pensamientos

Si se tiene una curva difícil de ajustar, encontrar el modelo correcto puede parecer una tarea inmensa. Sin embargo, después de todo el esfuerzo para obtener los datos, vale la pena encontrar el mejor ajuste posible.

Al especificar cualquier modelo, debería permitir que la teoría y el conocimiento sobre el área temática le guíe. Algunas áreas tienen prácticas y funciones estándar para modelar los datos.

Si bien se desea un buen ajuste, no se desea inflar artificialmente el R-cuadrado con un modelo demasiado complicado. Hay que ser consciente que:

- R-cuadrado puede ser engañoso

- Los modelos demasiado complicados pueden producir resultados engañosos

- Verificar los gráficos residuales evita resultados engañosos (no se han mostrado en este artículo, pero el autor los revisó).

- Detalles

- Categoría: Comsol

- Visto: 8465

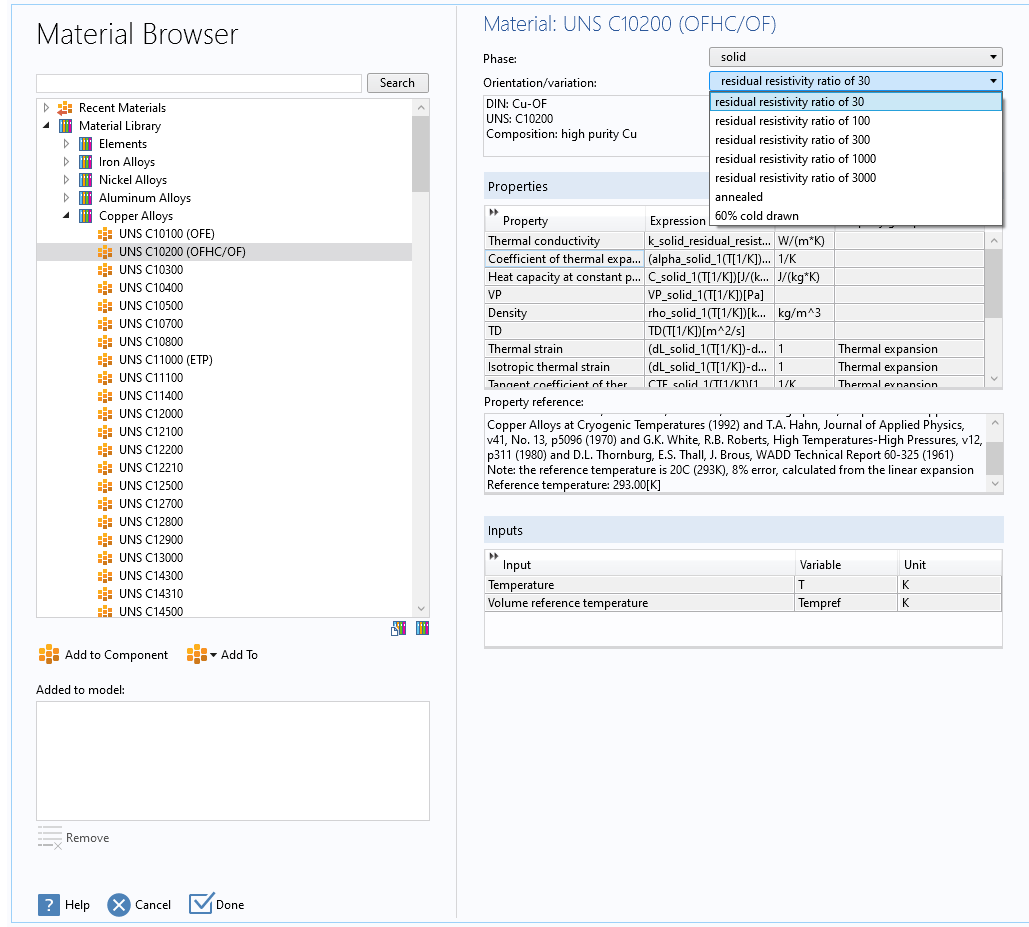

Toda simulación requiere el uso de un conjunto de materiales y, por tanto, de la definición de una serie de parámetros de los mismos que nos permitan emular el comportamiento de los fenómenos físicos sobre estos materiales.

COMSOL Multiphysics y la mayoría de sus módulos incluyen bibliotecas de materiales integradas. Cada biblioteca de materiales consiste en una base de datos de materiales y sus propiedades asociadas. Además de estas librerías de materiales incluídas con los módulos existe un producto adicional Material Library Module, que contiene hasta 24 propiedades de materiales para más de 3800 materiales (versión 5.5).

En la entrada del blog de COMSOL "Using the Materials Libraries in COMSOL Multiphysics®", Magnus Ringh hace un repaso sobre las librerías de materiales incluídas en los módulos y del módulo Material Library, y de cómo utilizarlas en las simulaciones.

- Detalles

- Categoría: Minitab

- Visto: 4273

Por Evan McLaughlin.

Solo el 30 por ciento de las iniciativas de mejora de rendimiento tienen éxito. Entonces, la pregunta es ¿por qué estas iniciativas fallan con tanta frecuencia? La investigación revela que la razón número 1 es la falta de apoyo administrativo. Las encuestas a ejecutivos de alto nivel realizadas por la Economist Intelligence Unit coinciden: dicen que la falta de aceptación y apoyo del liderazgo puede detener el éxito de muchas iniciativas estratégicas.

La evidencia del Instituto Juran revela que, simplemente, los líderes de las compañías no tienen un buen acceso al tipo de información que necesitan. La investigación de la Sociedad Estadounidense para la Calidad en realidad muestra que cuanto más personas suben en la escala corporativa, menos frecuentemente reciben informes sobre las métricas (¡más de la mitad recibe actualizaciones una vez trimestralmente o incluso menos!).

Los datos dispersos e inaccesibles del proyecto hacen que sea difícil reconstruir la imagen completa de las iniciativas de mejora y su impacto en una empresa. A menudo se usa una variedad de aplicaciones para crear cartas de proyectos, mapas de procesos, mapas de flujo de valor y otra documentación. Mantener los registros oficiales del proyecto actualizados y accesibles para todas las partes clave interesadas se convierte en un trabajo que consume mucho tiempo en sí mismo. Además de eso, las métricas inconsistentes en los proyectos pueden hacer que sea imposible evaluar los resultados de manera equivalente.

Pero las iniciativas estratégicas exitosas se basan en la planificación y la buena comunicación. Entonces, ¿Qué hacer? Aquí están nuestras tres sugerencias principales.

1. Garantizar la eficiencia

Al usar una plataforma para realizar un seguimiento de los hitos, los KPI y los documentos abordan las redundancias de recopilación de métricas clave de diversas fuentes necesarias para informar sobre los proyectos, ahorrando a los equipos horas de valioso tiempo. Mirando más allá del proyecto actual, una plataforma también puede facilitar en el futuro la replicación rápida de procesos, como hojas de ruta y plantillas que fueron útiles en iniciativas anteriores.

2. Apuntar a la consistencia

Se puede usar una herramienta como Companion by Minitab para centralizar el almacenamiento y hacer que todos los documentos relevantes sean accesibles para los miembros del equipo y las partes interesadas. A medida que los equipos crecen y los proyectos se vuelven más complejos, tener a todos los miembros del equipo alineados puede ser un gran beneficio, ya que puede evitar confusiones, ayudar con el control de versiones, ayudar a mantener las métricas consistentes y reducir la cantidad de correos electrónicos de ida y vuelta.

3. Obtener una 'instantánea' en tiempo real con paneles

La visibilidad del progreso de su proyecto facilita la gestión diaria del seguimiento de los resultados y la resolución de los desafíos. Los paneles muestran el progreso de su proyecto en un solo vistazo.

Lograr la eficiencia, la coherencia y la visibilidad necesarias para gestionar con éxito los proyectos es un desafío común que escuchamos a nuestros clientes. Companion fue creado para abordar estos problemas de manera directa en base a los comentarios de los clientes. Para los ejecutivos, gerentes y partes interesadas, Companion ofrece una visión sin precedentes y sin igual, sobre el progreso, el rendimiento y el impacto final de toda la iniciativa de calidad de la organización, o cualquier parte individual de la misma.

- Detalles

- Categoría: Comsol

- Visto: 4208

Por Henrik Sönnerlind.

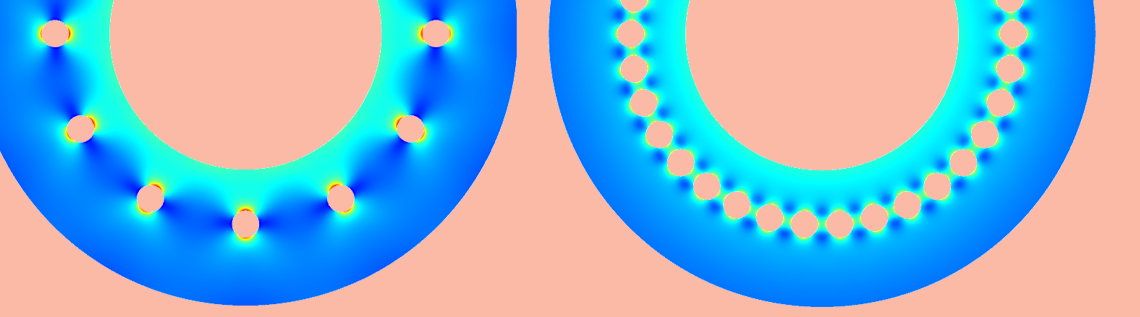

Henrik Sönnerlind, nos muestra cómo hay casos, cuando las tensiones en una estructura exceden los límites aceptables, en los que aunque intuitivamente pueda parece que lo más adecuado es añadir material para incrementar la capacidad de tranporte de carga, justo hay que seguir el camino opuesto.

En esta entrada del blog de COMSOL Henrik nos muestra el caso de un cliente en el que las tensiones alrededor de los orificios en un tipo de centrifugadora eran muy grandes y como la solución de añadir orificios al dispositivo no convencía al cliente. Pero la simulación con COMSOL Multiphysics desveló este llamativo efecto.

- Detalles

- Categoría: Lakes

- Visto: 5702

A continuación le indicamos una lista de las principales características implementadas en esta versión. Otras características y cambios están descritos en detalle en las notas de la versión que podrá encontrar en la pestaña RECURSOS del producto, o con el enlace inferior.

- Nuevos modelos: Soporte para la nueva versión BETA de modelos 7.3, que incluyen CALPUFF (7.3.2), CALPOST (7.2.0), POSTUTIL (7.1.0), y CALSUM (7.1.0)

- Nueva fuente rociado: CALPUFF 7.3.2 incluye un nuevo tipo de fuente para analizar actividades de rociado (spray) para agricultura.

- Soporte de uso de suelo Shapefile: Ahora se pueden abrir datos de uso del suelo en formato Shapefile en el Land Use Creator para generar datos compatibles con las utilidades de procesado geofísico de CALPUFF.

- Hoja de cálculo de garantía de calidad de meteorología de superficie: Una nueva hoja de cálculo de garantía de calidad detalla las variables de datos meteorológicos de superficie que faltan para ayudar a los modeladores a construir conjuntos de datos completos.

- Otros asuntos adicionales: Revise las notas completas de la versión para una lista detallada de todos los cambios.

Encontrará más detalles de las características de la versión de CALPUFF View 9.0 en el documento de Notas de la versión.

- Detalles

- Categoría: NAG

- Visto: 4789

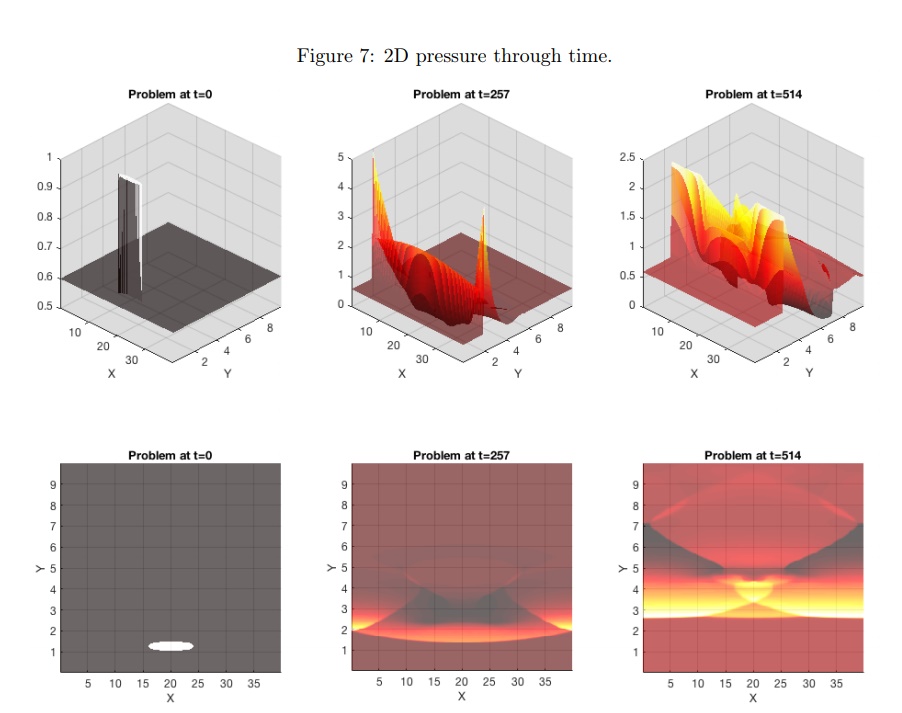

En el campo de la computación científica, hay un gran enfoque en resolver ecuaciones diferenciales parciales (PDE) dependientes del tiempo de la manera más eficiente posible. El refinamiento de malla adaptativo (AMR) se puede utilizar para construir una malla dispersa en cada paso de tiempo que mantenga una aproximación precisa a la solución. Las wavelets interpoladoras se usan a menudo en AMR.

En este artículo se presenta una comparación detallada de dos wavelets para AMR: la wavelet de interpolación de Donoho y una versión elevada (también llamada wavelets de segunda generación) de la wavelet de interpolación de Donoho. Las wavelets se comparan en problemas de PDE de finanzas computacionales y dinámica de fluidos computacional. También examinamos diferentes formas de manejar los límites y el impacto de los mismos. La wavelet de interpolación de Donoho con implementación de plantilla de límite de orden inferior parece ser la más precisa, al tiempo que resulta en una compresión muy alta en comparación con la malla original. Para un conjunto de datos, la wavelet interpoladora de Donoho mantiene menos del 5% de los puntos y tiene un error menor que 0.0001. En general, la wavelet interpoladora de Donoho produce mallas dispersas mientras mantiene una buena precisión, incluso para formas muy irregulares.

NAG está trabajando actualmente en el área PDE.

- Detalles

- Categoría: Twinn Witness

- Visto: 5401

Por Sam Dean.

En esta entrada, Sam Dean explica el uso de WITNESS Experimenter y cómo se puede usar para optimizar modelos sujetos a funciones objetivas, restricciones y parámetros modificables.

En nuestra vida cotidiana, dejamos que los ordenadores decidan mucho de lo que hacemos: si esa es la ruta más rápida para trabajar o qué música escuchar, confiamos en los algoritmos informáticos para optimizar nuestras vidas. En la misma línea, hay una herramienta simple para ayudarle a optimizar sus modelos WITNESS, permitiéndole enfocarse en otras cosas mientras se ejecutan, brindándole una valiosa información sobre los efectos de cada uno de sus parámetros, a través de miles de ejecuciones.

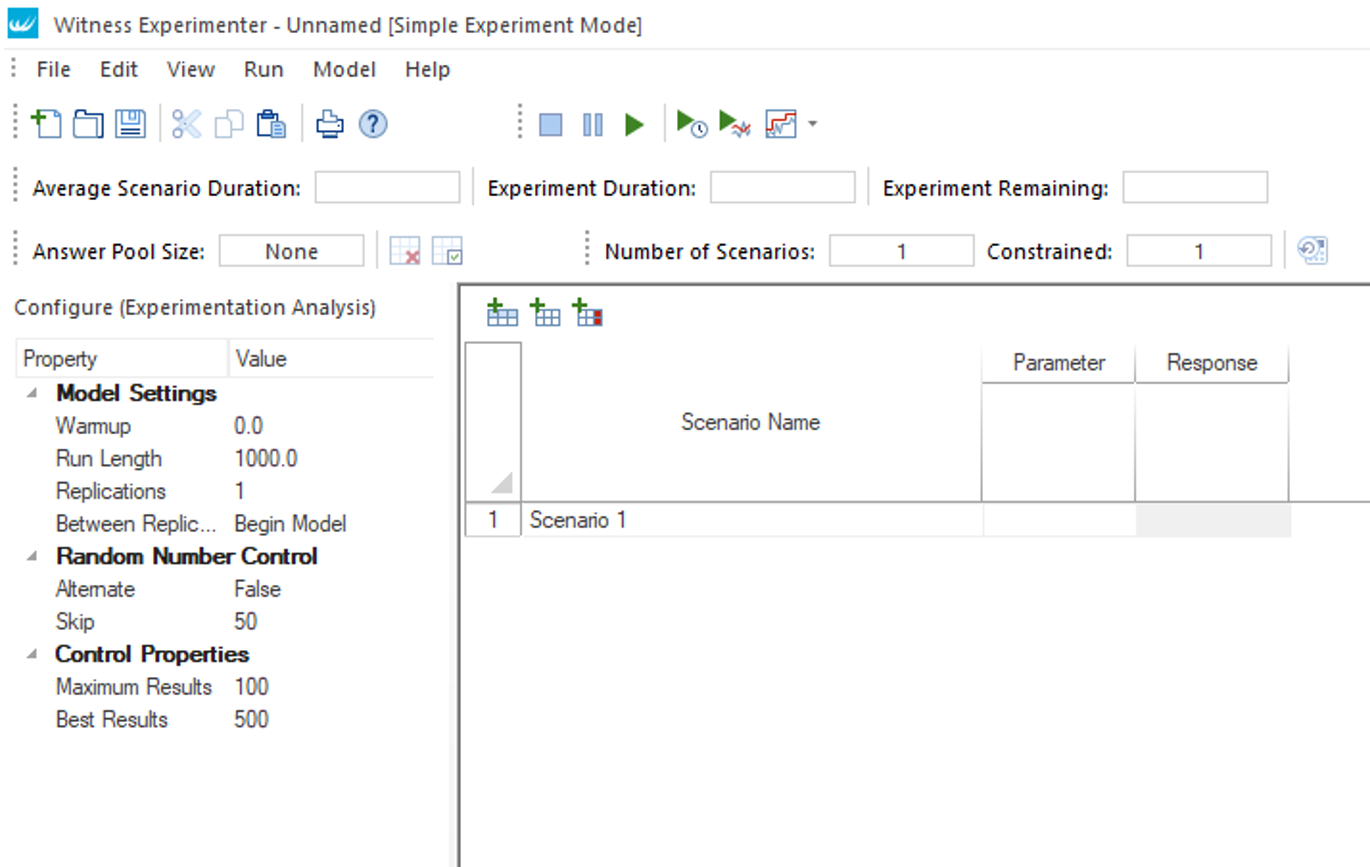

Para acceder al Experimenter, haga clic en el icono del tubo de ensayo o vaya a Model -> Experimenter. Cuando intente esto, verá que hay 2 versiones de Experimenter: modo Simple y Advanced.

Simple Experimenter

WITNESS Simple Experimenter es sencillo, ya que se especifica cada escenario que se desea ejecutar, en lugar de dejar que Experimenter decida qué combinaciones de valores de parámetros probar. Esto se utilizaría mejor cuando se sepa exactamente qué escenarios se desea ejecutar, y sepa que cada uno de ellos tardará un tiempo razonable en ejecutarse. Por lo tanto, puede configurarse para que se ejecute y luego regresar cuando haya terminado, habiendo configurado previamente las respuestas para todas las cosas que se desean saber, o configurar su modelo para que envíe todos los datos a otro programa, como un archivo csv.

A continuación puede verse la configuración del Experimentation Model.

- Warmup es el punto en el que el modelo restablecerá todas sus estadísticas. Debe establecerse este valor en un punto del modelo cuando se desee comenzar a registrar información.

- Run Length es el tiempo durante el que se desea registrar datos, se desea que sea lo suficientemente largo como para reflejar adecuadamente el nivel de variabilidad en los datos, pero no tanto como para hacer que la experimentación dure una eternidad.

- El número de Replications para cada escenario es el número de veces que desea ejecutar cada escenario utilizando diferentes flujos de números aleatorios, probando cada modelo con diferentes valores para cada variable aleatoria. Este número dependerá en gran medida de la cantidad de aleatoriedad en su modelo y la longitud de ejecución (Run Length) que haya configurado previamente.

- El valor Skip indica cuántos números aleatorios se omiten entre las réplicas. En general, éste debería ser mayor para tramos más largos. Se puede encontrar una recomendación para esto haciendo Run Length o Replication Analysis.

- Las propiedades de Control cambian la cantidad de resultados que se podrán ver cuando se termine la Experimentación. Solo debería ser un problema en el modo Avanzado.

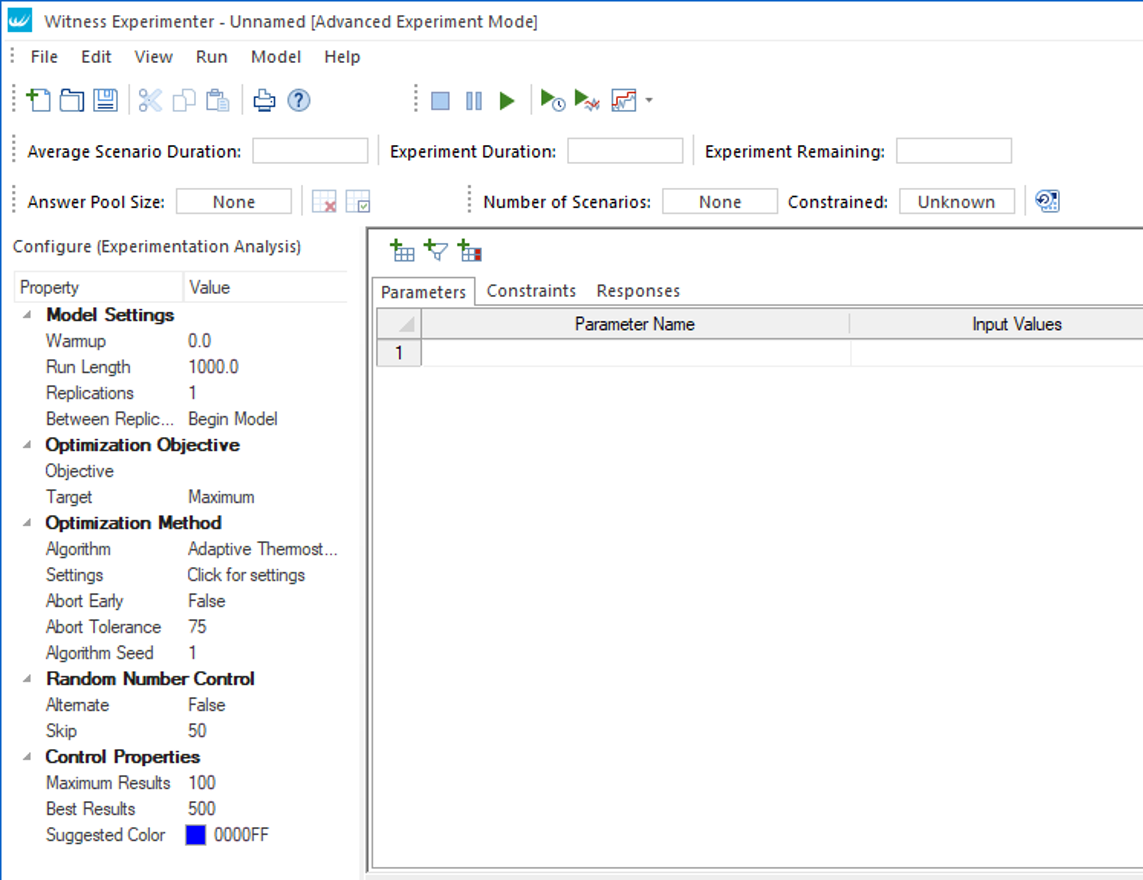

Advanced Experimenter

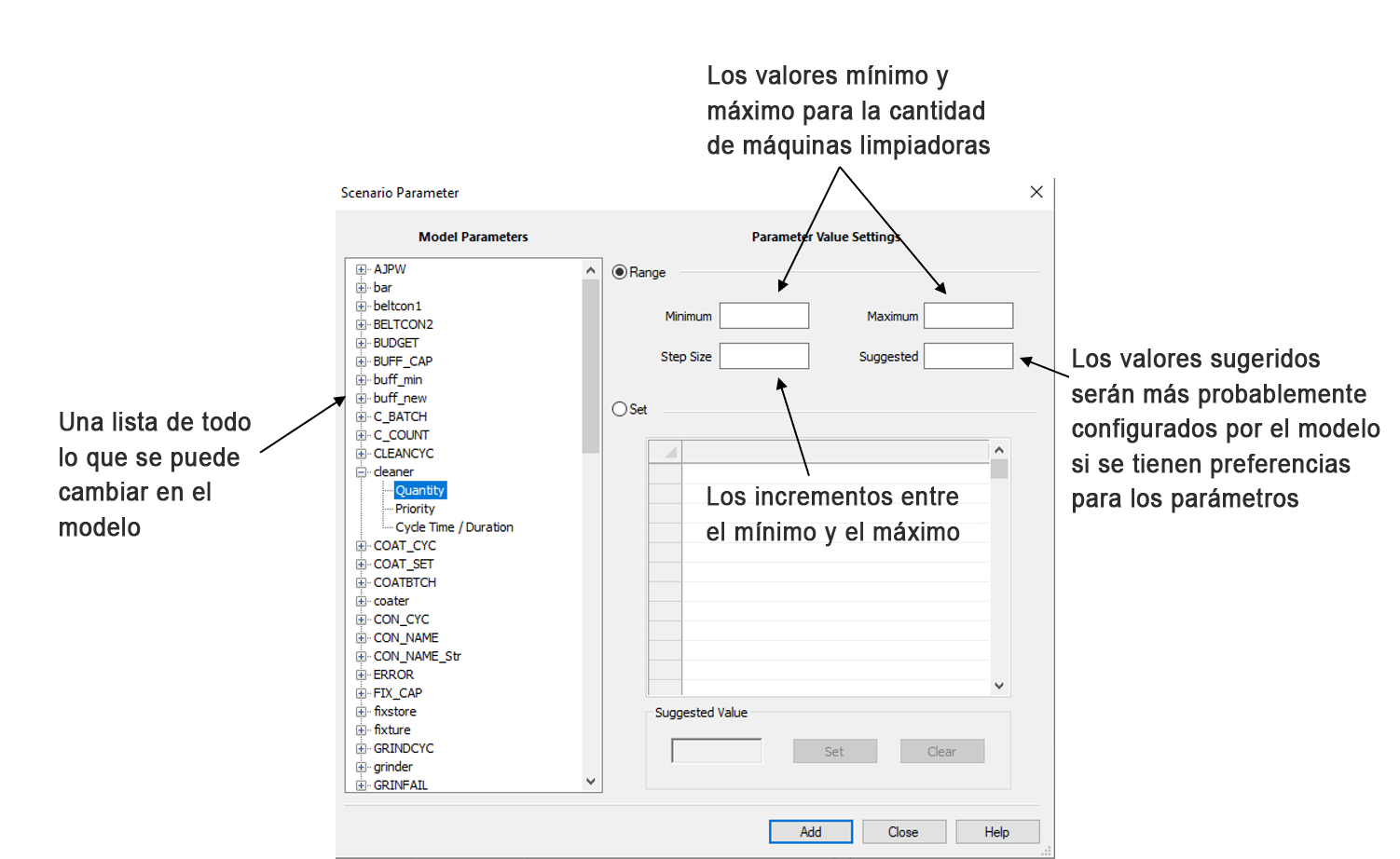

WITNESS Advanced Experimenter es un poco más complicado (como su nombre lo indica), pero sigue siendo increíblemente manejable y añade mucha más capacidad de optimización que puede necesitar. En primer lugar, le permite especificar restricciones, como presupuesto, personal, etc. obligando al software a planificar en función de sus datos de entrada. También tiene varios algoritmos incorporados para la optimización.

Para esto, solo se necesita especificar una función objetivo, por ejemplo, ganancias, utilización, etc. y luego un algoritmo para intentar optimizar su modelo. Se pueden encontrar más detalles sobre los algoritmos en los archivos de ayuda en Experimenter.

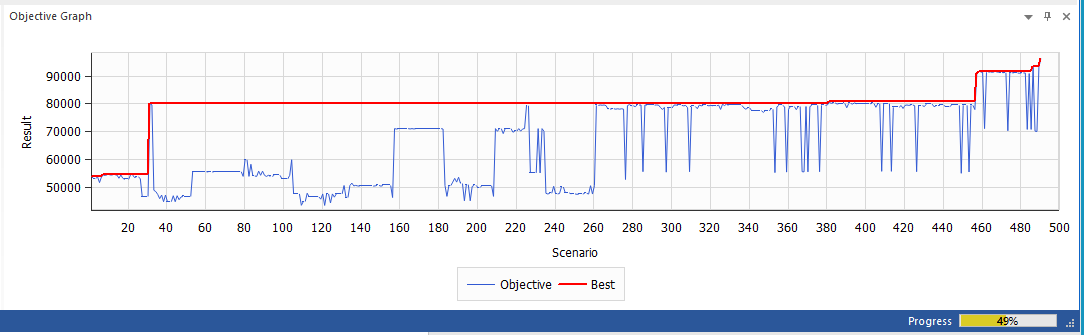

El cuadro a continuación muestra Advanced Experimenter mejorando gradualmente su función objetivo a medida que prueba muchos conjuntos diferentes de parámetros de entrada para encontrar una solución óptima.

En conclusión, Simple Experimenter debe de utilizarse si se conoce el escenario exacto que se desea ejecutar, sin embargo, si tiene una serie de parámetros que puede cambiar, aquí es donde brilla Advanced Experimenter.