- Detalles

- Categoría: Comsol

- Visto: 4934

Todos los productos de COMSOL® han mejorado su estabilidad que se han introducido como actualizaciones. La siguiente lista contiene las mejoras más importantes de COMSOL® versión 5.4 update 2 (incluyendo las del update 1).

COMSOL Multiphysics®

- Solucionado un problema con un botón de radio que no respondía en el Model Builder para macOS.1

- Solucionado un problema donde las aplicaciones podían fallar al lanzarse en instancias de ejecución largas.2

- Mejorada la implementación de forma que las rutas de los archivos de informes proporcionados por el usuario durante las llamadas a métodos se almacenan en el modelo.2

- Mejoras de rendimiento para barridos paramétricos grandes.

- Solucionado un problema donde los recursos de archivos podían perderse al calcular en la ventana Test Application.2

- Se han realizado varias mejoras de estabilidad y rendimiento.1,2

COMSOL Server™

- Solucionado un problema con el instalador de COMSOL Server™ en versiones Windows® localizadas.1

- Solucionado un problema donde aplicaciones reemplazadas fallaban al lanzarse en servidores secundarios.2

- Implementoda una gestión más robusta de límites de tiempo de red en el lado servidor.2

COMSOL Compiler™

- Renombrado el botón Executable y la correspondiente ventana de Settings a Compiler.1

- Renombrado el botón Compile, utilizado para compilar aplicaciones, a Create Executable.1

AC/DC Module

- Añadido soporte de análisis de sensibilidad a la funcionalidad Terminal, aplicable a las interfaces Electric Currents, Electrostatics, Electrostatics, Boundary Elements, y Magnetic and Electric Fields.2

- Se han realizado varias mejoras de estabilidad.2

Acoustics Module

- Corregidas las variables de postprocesado globales generadas por la condición de Port en los modelos 2D axisimétricos.1

- Solucionado un problema cuando se utilizaba únicamente una frecuencia en un estudio junto con la funcionalidad de Port Sweep.1

CFD Module

- Correción de la densidad y viscosidad utilizadas para la condición de contorno Inlet en la interfaz Darcy's Law al utilizarla con el nodo de acoplamiento multifísico Multiphase Flow in Porous Media.1

- Corrección de la implementación para el uso de múltiples nodos Mass Source en la interfaz Phase Transport.1

- Realizas varias mejoras de estabilidad.2

Chemical Reaction Engineering Module

- Corregida la función de la tasa de capacidad calorífica (Cp/Cv) en la interfaz Thermodynamics.2

Composite Materials Module

- Solucionado un problema donde, en la interfaz Layered Shell, podían aparecer tensiones espúreas en elementos con grandes variaciones en la orientación normal. Este problema, que podía ocurrir para mallas importadas o junto con operaciones geométricas virtuales, ahora está solucionado.2

ECAD Import Module

- Mejorada la implementación de forma que las caras verticales ahora se incluyen en selecciones de red de contornos para capas de taladros en archivos ODB++.1

Heat Transfer Module

- Solucionada la definición del coeficiente de compresibilidad isobárica cuando se utiliza la densidad definida por el usuario.1

- Solucionado el soporte de malla móvil en las funcionalidades de cáscara.1

- Habilitado el acoplamiento multifísico Surface-to-Surface Radiation para las interfaces Slip Flow y High Mach Number Flow.1

- Corregida la expresión para Zmean (figura de mérito media) en el acoplamiento multifísico Thermoelectric Effect.1

- Solucionada la contribución de grosor fuera de plano a las funcionalidades de la interfaz de flujo de calor en geometrías 2D.1

- Corregida la definición de variables de postprocesado de flujo de calor difusivo cuando se utiliza el acoplamiento multifísico Heat Transfer with Radiative Beam in Absorbing Media.2

- Corregida la definición de temperatura ambiente en el nodo Ambient Thermal Properties cuando la lista de Temperature se pone a User-defined coefficient for deviation o User-defined correction.2

- Corrección de coeficientes de unos cuantos polinomios de Legendre de orden superior a 4.2

- Corregido el grosor fuera de plano a unidad y desactivadas las funcionalidades fuera de plano cuando está activo un acoplamiento multifísico que involucre una interfaz de radiación.2

- Solucionada la contribución del grosor fuera de plano para flujo no isotérmico turbulento con funciones pared o tratamiento de pared automático.2

- Corregida la funcionalidad de Opaque Surface para la interfaz Radiative Beam in Absorbing Media.2

- Solucionada la definición de densidad en el nodo Phase Change Material cuando se utiliza bajo la funcionalidad Solid con una malla móvil.2

- Eliminado el filtro de selección redundante en el conjunto de datos de postprocesado de un material en capas para obtener modelos más concisos.2

- Reemplado definido entre las subfuncionalidades Irreversible Transformation y Phase Change Material.2

- Solucionado un problema con la definición de la tasa de flujo de masa en la funcionalidad Interior Fan.2

- Corregida la definición de variables de postprocesado de balance de energía en casos con un acoplamiento multifísico que defina fuentes de calor en contornos.2

- Corregida la definición de la conductividad térmica en el nodo Phase Change Material cuando es utilizado bajo una funcionalidad Solid con una malla móvil.2

- Solucionado un problema de migración para modelos que contengan las interfaces Heat Transfer with Radiation in Participating Media construidas en las versiones 5.3a y anteriores.2

- Actualizada la definición de conductividad térmica cuando se especifican diferentes propiedades de material para el tejido dañado en la subfuncionalidad Thermal Damage.2

- Cancelada la contribución de trabajo realizada por cambios de presión para fllujo incompresible con aproximación Boussinesq para la interfaz Nonisothermal Flow.2

- Eliminada la posibilidad de definir un grosor fuera de plano en interfaces de transferencia de calor en geometrías 1D, 2D, y 2D axisimétrica cuando la transferencia de calor está acoplada con una interfaz de radiación.2

- Se ha añadido la visualización de la dirección de radiación en la funcionalidad Prescribed Radiosity.2

LiveLink™ for SOLIDWORKS®

- La interfaz LiveLink™ y el entorno de simulación de única ventana integrada ahora soporta SOLIDWORKS® 2019.1

Nonlinear Structural Materials Module

- Correción de un error en el modelo Souza-Auricchio para aleaciones con memoria de forma.1

- Corrección de un problema cuando se creaba una ley de deslizamiento definida por el usuario utilizando un Potential en el nodo Creep. En versiones anteriores, se aplicaba un factor de dos en los téminos fuera de la diagonal en la expresión de potencial para tener en cuenta la simetría en el tensor de tensión. Este factor se basaba en la asunción de que la expresión del potencial se escribió en términos de únicamente las partes superiores a la diagonal del tensor de tensión. Con esta actualización, el potencial se considera que está escrito en una forma estándar, de forma que las tasas de deformación de cizalladura se calculan directamente como la derivada del potencial respecto al elemento tensor de tensión correspondiente.1

Particle Tracing Module

- Las funcionalidades de Heat Source, Convective Heat Losses, y Radiative Heat Losses para la interfaz Particle Tracing for Fluid Flow ahora respetan las selecciones de dominio.1

- Mejora del manejo de dispersión difusa o emisión de partículas o rayos desde contornos interiores.2

- Corregido el coeficiente en la fuerza de elevación Saffman para tener en cuenta una corrección al papel Saffman original.2

- Añadidas variables dependientes auxiliares en partículas al menú Add/Replace Expression durante el procesado de resultados.2

Pipe Flow Module

- Las funcionalidades de Pipe Connection en modelos antiguos que uitlizan la interfaz Nonisothermal Pipe Flow tal cual, con un aviso de que la funcionalidad está obsoleta y que se eliminará en versiones futuras.1

Plasma Module

- Cambiada la funcionalidad de forma que la interfaz Boltzmann Equation, Two-Term Approximation ahora está disponible en componentes 0D. La versión anterior, que estába disponible en 1D, ahora se ha retirado. Los modelos existente que utilizaban la versión 1D de la interfaz todavía pueden ser abiertos y modificados.2

Ray Optics Module

- Salvaguarda adicional contra errores por divisiones por cero al utilizar la funcionalidad Ray Termination.1

- Mejorada la funcionalidad para configurar automáticamente la entrada del modelo de frecuencia para índices refractivos que dependan de la frecuencia o longitud de onda del rayo. Si se había configurado la entrada del modelo previamente de forma manual, por ejemplo a comp1.gop.f0, entonces, después de la actualización, hay que ir a Common Model Inputs, hacer clic derecho en Frequency (Hz) -minput.freq y escoger Reset to Default.1

Semiconductor Module

- Corrección de la visualización de la ecuación de Poisson en la interfaz Semiconductor.1

Structural Mechanics Module

- Corrección de un error que podía ocurrir al añadir Adhesion en una interfaz Solid Mechanics que todavía contenga el nodo Plasticity.1

- Corrección de un error que podía ocurrir al utilizar Compact History en un modelo que contenga un acoplamiento multifísico Solid-Beam Connection.1

- Mejora en el rendiimiento para postprocesado con conjuntos de datos Shell.2

- Corregido un error que ocurría durante la generación de secuencias del resolvedor por defecto para modelos multifísicos que contenían un nodo Damage en la interfaz Solid Mechanics.2

- Incluidas pérdidas desde la funcionalidad Thin-Film Damping al calcular la disipación de potencia y el factor de calidad en la interfaz Solid Mechanics.2

- Se han realizado mejoras de estabilidad.2

Subsurface Flow Module

- Corrección en la definición de la formulación de la Permeabilidad y Kozeny-Carman para la ecuación de Richards para utilizar la permeabilidad relativa para calcular la transmisibilidad.1

- corregida la contribución de velocidad debida a la gravedad con aceleración especificada para la funcionalidad Fracture Flow.2

1Nuevo en update 1

2Nuevo en update 2

- Detalles

- Categoría: Minitab

- Visto: 187227

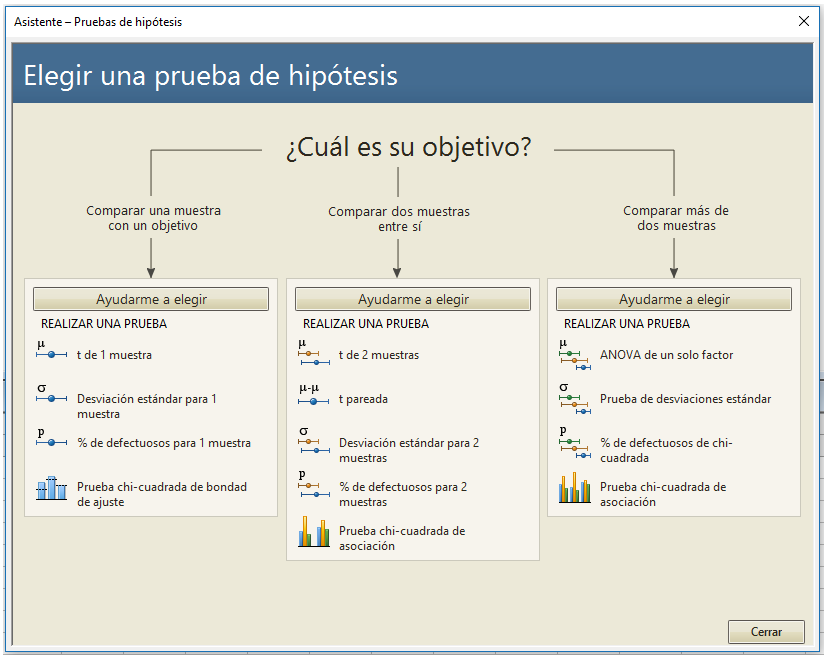

En esta publicación se muestra cómo funcionan las pruebas de hipótesis y los intervalos de confianza, centrándose en conceptos y gráficos en lugar de las ecuaciones y números.

Previamente se había utilizado gráficos para mostrar lo que realmente significa significación estadística. Pero en esta publicación se explicarán tanto los intervalos de confianza como los niveles de confianza, y cómo están estrechamente relacionados con los valores de P y los niveles de significación.

Cómo interpretar correctamente los intervalos de confianza y los niveles de confianza

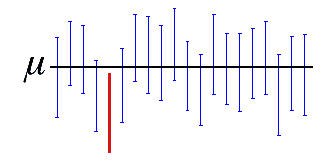

Un intervalo de confianza es un rango de valores que es probable que contenga un parámetro de población desconocido. Si se dibuja una muestra aleatoria muchas veces, un cierto porcentaje de los intervalos de confianza contendrá a la media de la población. Ese porcentaje es el nivel de confianza.

Con mayor frecuencia, se utilizarán los intervalos de configanza para delimitar la media o la desviación estándar, pero también pueden obtenerse para los coeficientes de regresión, las proporciones, las tasas de incidencia (Poisson) y las diferencias entre poblaciones.

Un intervalo de confianza del 95% indica que 19 de cada 20 muestras (95%) de la misma población producirá intervalos de confianza que contienen el parámetro de la población.

Del mismo modo que hay una idea errónea de cómo interpretar los valores de P, también hay una idea errónea de cómo interpretar los intervalos de confianza. En este caso, el nivel de confianza no es la probabilidad de que un intervalo de confianza específico contenga el parámetro de población.

El nivel de confianza representa la capacidad teórica del análisis para producir intervalos precisos si se es capaz de calcular muchos intervalos y conoce el valor del parámetro de población. Para un intervalo de confianza específico de un estucio, el intervalo contiene el valor de la población o no, no hay posibilidad de que existean probabilidades diferentes de 0 o 1. Y no se puede elegir entre estas dos posibilidades porque no se conoce el valor del parámetro de población.

"El parámetro es una constante desconocida y no se puede hacer una afirmación de probabilidad respecto su valor." —Jerzy Neyman, desarrollador original de los intervalos de confianza.

Esto se comprenderá más fácilmente después de que hablemos de la gráfica más abajo...

Con esto en mente, ¿cómo se interpretan los intervalos de confianza?

Los intervalos de confianza sirven como buenas estimaciones del parámetro de población porque el procedimiento tiende a producir intervalos que contienen el parámetro. Los intervalos de confianza se componene de la estimación puntual (el valor más probable) y un margen de error en torno a esa estimación puntual. El margen de error indica la cantidad de incertidumbre que rodea la estimación muestral del parámetro de población.

En este sentido, pueden utilizarse los intervalos de confianza para evaluar la precisión de la estimación de la muestra. Para una variable específica, uni intervalo de confanza más estrecho [90 110] sugiere una estimación más precisa del parámetro de población que un intervalo de confianza más amplio [50 150].

Intervalos de confianza y el margen de error

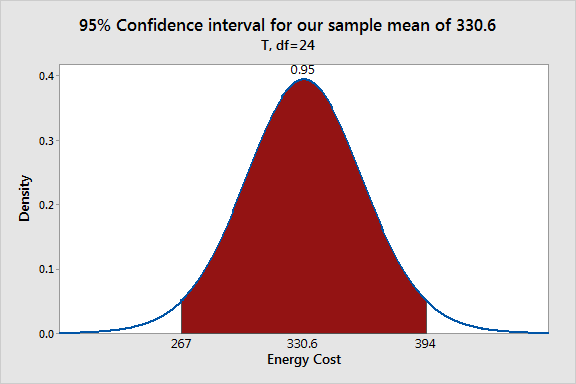

Continuemos para ver cómo los intervalos de confianza explican ese margen de error. Para hacer esto, utilizaremos las mismas herramientas que hemos estado usando para entender las pruebas de hipótesis. Se creará una distribución de muestreo utilizando gráficos de distribución de probabilidad, la distribución t y la variabilidad en los datos. Basaremos el intervalo de confianza en el conjunto de datos de costes de energía que se han estado utilizando.

Cuando observamos los niveles de significación, los gráficos mostraban una distribución muestral centrada en el valor de la hipótesis nula, y el 5% exterior de la distribución estaba sombreado. Para los intervalos de confianza, necesitamos desplazar la distribución del muestreo para que esté centrada en la media de la muestra y sombrear el 95% central.

Gráfico de distribución de probabilidad que ilustra cómo funcionan los intervalos de confianza

El área sombreada muestra el rango de la muestra que significa que se obtendría el 95% del tiempo utilizando nuestra media muestral como la estimación puntual de la media poblacional. Este rango [267 394] es nuestro intervalo de confianza del 95%.

Utilizando el gráfico es más fácil comprender cómo un intervalo de confianza específico representa el margen de error, o la cantidad de certeza, alrededor de la estimación puntual. La media muestral es el valor más probable para lamedia poblacional dada la información que tenemos. Sin embargo, el gráfico muestra que no sería totalmente inusual que otras muestras aleatorias extraídas de la misma población obtuvieran diferentes medias muestrales dentro del área sobreada. Estas otras muestras probables significan que todos sugiere valores diferentes para la media de la población. Por lo tanto, el intervalo representa la incertidumbre inherente que viene con el uso de datos de muestra.

Se pueden utilizar estos gráficos para calcular probabilidades para valores específicos. Sin embargo nótese que no se puede posicionar la media de la población en el gráfico porque el valor es desconocido. En consecuencia, no se pueden calcular probabilidades para la media de la población, ¡tal y como dijo Neyman!

Por qué los valores de P y los intervalos de confianza siempre concuerdan con la significación estadística

Se puede utilizar valores de P o intervalos de confianza para determinar si los resultados son estadísticamente significativos. Si una prueba de hipótesis produce ambos, estos resultados concordarán.

El nivel de confianza es equivalente a 1 - el nivel alfa. Entonces, si el nivel de significación es 0.05, el nivel de confianza correspondiente es del 95%.

- Si el valor de P es menor que su nivel de significación (alfa), la pruebas de hipótesis es estadísticamente significativa

- Si el intervalo de confianza no contiene el valor de la hipótesis nula, los resultados son estadísticamente significativos.

- Si el valor de P es menor que alfa, el intervalo de confianza no contendrá el valor de hipótesis nula.

Para nuestro ejemplo, el valor de P (0.031) es menor que el nivel de significancia (0.05), lo que indica que nuestro resultado es estadísticamente significativo. De manera similar, nuestro intervalo de confianza del 95% [267 394] no incluye la media de la hipótesis nula de 260 y llegamos a la misma conclusión.

Para comprender por qué los resultados siempre concuerdan, recuérdese como funcionan tanto el nivel de significación como el nivel de confianza.

- El nivel de significación define la distancia que la media de la muestra debe estar de la hipótesis nula para que se considere estadísticamente significativa.

- El nivel de confianza define la distancia para lo cerca que están los límites de confianza de la media de la muestra.

Tanto el nivel de significación como el nivel de confianza definen una distancia de un límite a una media. ¿Adivina? ¡Las distancias en ambos casos son exactamente iguales!

La distancia es igual al t-valor crítico * el error estándar de la media. Para los datos del ejemplo del coste de la energía, la distancia llega a ser de 63.57$.

Imagine esta discusión entre la media de la hipótesis nula y la media de la muestra:

- Media de la hipótesis nula, representante de la prueba de hipótesis: ¡Hola amigo! Descubrí que eres estadísticamente significativo porque estás a más de 63,57$ de mi.

- Media de la muestra, representante del intervalo de confianza: En realidad yo soy significativo porque tú estás a más de 63,57$ de mi!

Muy agradables, ¿verdad? Y, siempre estarán de acuerdo mientras se comparen los correctos pares de P valores e intervalos de confianza. Si se comparan los pares incorrectos, se obtendrán resultados conflictivos, como se muestra en el error típico #1 en esta publicación.

Pensamientos finales

Los análisis estadísticos, tienden a centrarse más en los P valores y simplemente detectar un efecto o diferencia significativos. Sin embargo, un efecto estadísticamente significativo no es necesariamente significativo en el mundo real. Por ejemplo, el efecto puede ser demasiado pequeño para tener algún valor práctico.

Es importante prestar atención tanto a la magnitud como a la precisión del efecto estimado. Por eso me gustan los intevalos de confianza. Permiten evaluar estas importantes características junto con la significación estadística. A todos nos gustaría ver un intervalo de confianza estrecho donde el rango completo representa un efecto que es significativo en el mundo real.

- Detalles

- Categoría: Maple

- Visto: 11365

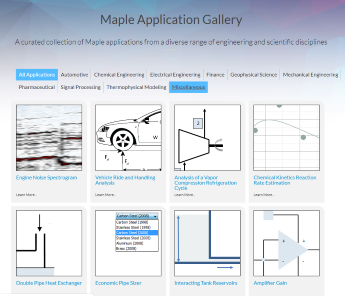

Maplesoft pone a disposición de los usuarios de sus herramientas Maple y MapleSim un gran número de recursos para el aprendizaje y el aprovechamiento del trabajo realizado por otros usuarios. Además de sitios comunitarios como Maple Cloud y Maple Primes, también está disponible la Maple Application Gallery, una colección filtrada de aplicaciones de Maple libres, sobre un diverso rango de disciplinas científicas y de ingeniería.

Las aplicaciones se dividen en las siguientes áreas:

- Automoción

- Ingeniería química

- Ingeniería eléctrica

- Finanzas

- Ciencias geofísicas

- Ingeniería mecánica

- Farmacia

- Procesado de señal

- Modelado termofísico

- Misceláneos

- Detalles

- Categoría: Comsol

- Visto: 13576

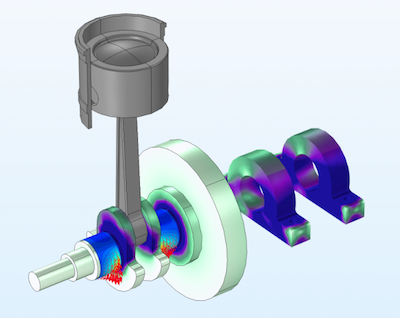

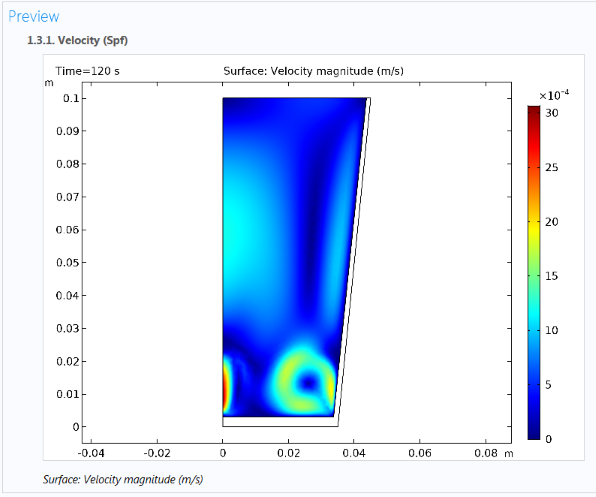

Varios tipos de máquinas, como motores, bombas y turbinas, utilizan componentes que transmiten la carga entre las partes sólidas que están en movimiento relativo. Los ejemplos más típicos son los aros del pistón, levas, dientes de engranajes y, por supuesto, los cojinetes. A menudo estos componentes se lubrican manteniendo una película de aceite entre las dos partes sólidas para minimizar la fricción y el desgaste. En esta publicación del blog de COMSOL, Prashant Srivastava analiza los métodos para modelar la fricción del fluido en uniones lubricadas.

Tras presentar los diferentes regímenes de lubricación, el autor se centra en los regímenes de lubricación de película completa, porque las juntas forman superficies conformes y la presión no es lo suficientemente alta como para causar una deformación significativa.

Continúa con el cálculo teórico de la fuerza de arrastre viscosa entre las placas separadas por un lubricante y determina la fuerza viscosa en juntas lubricadas para acabar explicando cómo se modelan las juntas lubricadas utilizando COMSOL Multiphysics, y mostrando un ejemplo de fricción fluida en las juntas y otro de un motor recíproco con rodamientos hidrodinámicos.

- Detalles

- Categoría: Comsol

- Visto: 10885

Los informes son muy valiosos para documentar y mostrar resultados de nuestras simulaciones. A partir de la versón 5.4, el software COMSOL Multiphysics® incluye el soporte para utilizar plantillas de informes, lo que puede ser utilizado para crear informes a medida. En este post del blog de COMSOL, Magnus Ringh describe cómo añadir plantillas de informes y muestra algunos ejemplos de cómo pueden ser de utilidad para crear informes con disposiciones y contenidos específicos.

Informe de los resultados de la simulación

Crear informes a partir de las simulaciones de COMSOL Multiphysics proporciona una manera de documentar los justes y resultados de la simulación. Los informes también posibilitan la distribución de información a partir de simulaciones a una audiencia más amplia. Pueden crearse informes en dos formatos:

- HTML: El formato HTML es apropiado para visualizar un informe en un navegador web. Se puede personalizar la disposición utilizando una hoja de estilo (archivo CSS) a su elección.

- Microsoft Word: Este formato es adecuado para imprimir y para ampliar el informe con texto e información adicional. La disposición del documento Word puede controlarse utilizando una plantilla de Microsoft® Word personalizada (archivo *.dotx).

Hasta la versión 5.4 de COMSOL Multiphysics, han habido tres plantillas predefinidas diferentes o niveles para los contenidos de un informe:

- Breve: Un informe breve contiene una visión general del modelo con todos los resultados y gráficos pero sin detalles sobre las interfaces físicas, los ajustes del resolvedor o las variables.

- Intermedio: Un informe intermedio contiene información detallada sobre el modelo, incluyendio los ajustes y variables de la interfaz física, pero no dispone de información completa, por ejemplo, sobre las ecuaciones subyacentes.

- Completo: Un informe completo contiene información exhaustiva sobre el modelo, incluyendo los detalles de la interfaz física como expresiones de la ecuación débil y funciones de forma.

Estas plantillas predefinidas proporcionan diferentes niveles de detalle, pero todos informan sobre cada uno de los aspectos de su proyecto de simulación. Además, se puede crear una plantilla a medida, que inicialmente está vacía, de forma que puede ser configurada libremente utilizando los componentes de informes disponibles.

Lea la entrada completa en el blog de COMSOL para conocer los detalles sobre los informes a medida y un par de ejemplos prácticos.

- Detalles

- Categoría: Minitab

- Visto: 40160

En el mundo sanitario podemos encontrar muchas actividades cuyos datos pueden ser usados para mejorar los tiempos de ciclo, la satisfacción de los clientes, los tiempos de espera, la capacidad de las plantas y el inventario.

Haciendo honor a la Semana de Calidad Sanitaria y al Mes de Calidad Nacional (octubre) llevados a cabo en Estados Unidos, y al mes de Calidad Mundial, el objetivo de este artículo es compartir las capacidades principales de los Mapas de Flujo de Valor (comúnmente conocido como VSM, por sus siglas en inglés). Los mapas de flujo de valor pueden ayudar a plantear el mapa, visualizar y entender el flujo de pacientes, materiales e información.

Se denomina cadena de valor a todas las actividades requeridas para completar un proceso particular, y el objetivo de los VSM es identificar mejoras que pueden ser llevadas a cabo para reducir el gasto, como puede ser, por ejemplo, el tiempo de espera de los pacientes.

¿Cómo son los Mapas de la cadena de valor aplicados a la sanidad?

Cuando aplicamos los VSM a la sanidad, uno de los principales enfoques es su uso para plasmar el flujo del paciente hasta su tratamiento, para mejorar los servicios y la calidad de atención y minimizar retrasos.

Para plantear el sistema de manera adecuada, la clave reside en buscar información fiable y de calidad acerca del flujo de información y el tiempo que el paciente pasa en alguna etapa o entre distintas etapas. Es esencial la toma de datos de tiempo precisos y el uso de equipos de distintos departamentos que puedan contrastar datos.

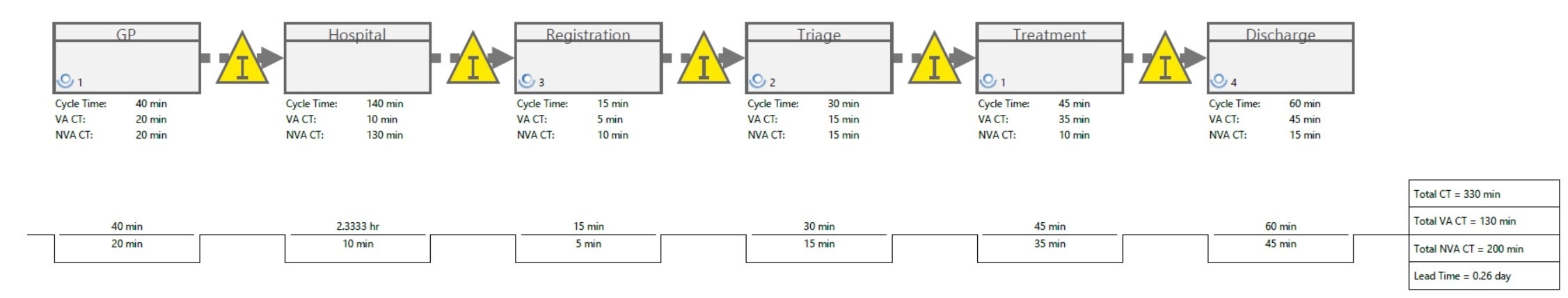

Para realizar el mapa del tratamiento de un paciente, lo ideal será crear un mapa de estado presente con VSM (una de las herramientas principales de Companion by Minitab), para que nos sirva de guía para identificar las áreas donde procede realizar alguna mejora.

En el ejemplo de la imagen superior, la primera etapa por la que pasa el paciente es la visita al médico general (en el VSM: “GP”, de General Physician), y esto es representado con un proceso con forma rectangular en el VSM. El tiempo que el paciente está en este paso puede ser resumido en los tiempos de ciclo de Valor Añadido (VA) y No Valor Añadido (NVA). VA es el tiempo que el paciente está dispuesto a esperar sin percibir demora alguna, en este caso 20 minutos en la consulta del doctor. NVA es el tiempo que el paciente ya percibe una demora, en este caso 20 minutos en la sala de espera.

La línea de puntos entre los procesos muestra que una vez que el paciente acaba de pasar por una etapa, es enviado directamente a la siguiente. Muchas veces no se adapta a la realidad del proceso, ya que hay tiempos de espera entre las distintas etapas. Estos tiempos de espera (el tiempo que el paciente está esperando a ser recibido en la siguiente consulta) se representan con triángulos amarillos. Son procesos intermedios considerados como “NVA” (procesos de valor no añadido) para el paciente, ya que suponen una percepción de demora.

Si bien es cierto que los VSM pueden ser creados sobre papel, el uso de herramientas informáticas como Companion by Minitab, nos facilita y agiliza el trabajo. Como podemos ver en la siguiente captura parcial, Companion calcula y muestra automáticamente una línea temporal en la parte inferior al VSM, que va sumando el tiempo total a través de todo el proceso (denominado “lead time” o tiempo de espera) y muestra la información temporal de cada proceso y del proceso global.

Identificando todas estas etapas se puede empezar a plantear el mapa de todo el proceso. Una vez se ha creado el mapa del estado presente con todas las etapas correctamente definidas, puede procederse a la creación del mapa de estado futuro, añadiendo o eliminando etapas o tiempos entre ellas. Este mapa de estado futuro permite identificar áreas de mejora, y una vez haya sido implementado, será el nuevo mapa de estado presente, de manera que formará parte del proceso global de mejora.

¿Cómo mejorar el mapa de estado presente?

Cuando se buscan áreas de mejora, el objetivo es enfocar los cambios en la mejora del flujo de pacientes durante el proceso: el estado ideal es el flujo continuo de los pacientes por todo el proceso. El flujo continuo mueve a los pacientes a través del sistema sin que tengan que esperar. A pesar que el flujo continuo puede no ser posible, puesto que en sanidad entran en juego muchos factores, una serie de herramientas nos pueden ayudar a introducir otros cambios: por ejemplo el FIFO (primero en entrar, primer en salir) puede ser aplicable a consultas de extracción de sangre.

Es importante también tener en consideración el takt time (tiempo medio entre el inicio de una actividad y el inicio de la siguiente), ya que puede ayudar a estudiar el comportamiento del paciente. Podemos interpretar el takt time, en este caso, como el número de pacientes que pueden ser atendidos por unidad de tiempo. Companion by Minitab calcula este dato de manera automática.

Una vez se hayan completado tanto el mapa de estado presente como el de estado futuro, podrán compararse los dos, cuantificar la mejora de oportunidades, y estudiar cómo implementar los cambios. En este ejemplo, se propone que el protocolo de intervención y clasificación y los pasos relativos a la cita se realicen de manera conjunta, ya que combinados supondrán menos visitas al hospital por parte del paciente, y una percepción de mejora.

A continuación se ilustra, de manera resumida, cómo sería el proceso de realización de un Value Stream Map con Companion by Minitab:

- Detalles

- Categoría: Otras

- Visto: 8633

A medida que los proveedores de medicamentos se esfuerzan por crear fármacos basados en proteínas eficaces, la inmunogenicidad sigue siendo un desafío complejo. La inmunogenicidad no deseada es un tema candente hoy en día, en parte porque todavía no se comprende por completo.

Ir lejos, ir juntos

La tasa de desgaste es un problema recurrente en la industria farmacéutica. Un proceso que genera miles de moléculas en la fase de investigación generalmente concluye con solo unos pocos productos terapéuticos viables. Esto aumenta el coste de llevar nuevos medicamentos al mercado, lo que hace que los pacientes paguen precios más altos por los medicamentos que necesitan.

Esto pretende solucionarse con herramientas predictivas, estas se basan en algoritmos establecidos que se han validado a lo largo del tiempo. No es difícil para los analistas estadísticos construir modelos predictivos, pero el grado en que se puede confiar en la respuesta de un modelo depende de qué datos se utilizan. Las plataformas seguras de terceros podrían permitir recopilar y centralizar datos biológicos de las organizaciones participantes para crear modelos predictivos. Los datos estarían protegidos, por lo que las empresas solo tendrían acceso a los datos que proporcionan mientras se benefician del conocimiento colectivo de todos los contribuyentes. Tal estrategia puede mejorar la precisión científica para toda la industria y reducir el coste de los medicamentos para los pacientes, todos ganan.

Iniciativas como la Alianza Pistoia y la Fundación Allotrope son precedentes exitosos para este tipo de cooperación entre organizaciones de ciencias de la vida. En estos proyectos, los expertos de las compañías de ciencias de la vida y otros grupos se reúnen para compartir estrategias precompetitivas y establecer un formato de datos y una ontología comunes para la industria.

Consigamos que funcione

Una vez realizados los estudios previos utilizando herramientas de predicción, cuando los investigadores descubren un fármaco candidato que tiene el potencial de curar a un gran porcentaje de la población de pacientes, no lo descartan si los estudios revelan inmunogenicidad. Hoy en día es más común buscar formas de disminuir la inmunogenicidad sin afectar la eficacia del tratamiento. ¿Podemos definir una terapéutica como exitosa cuando el diez, cinco o cero por ciento de la población muestra una respuesta inmunogénica? ¿Qué nivel de inmunogenicidad es aceptable?

La perspectiva lo es todo

La ciencia trata de reproducir resultados. Cuando una empresa desarrolla un medicamento, se deben registrar todos los experimentos y pruebas. Las organizaciones deben poder demostrar a los organismos reguladores - como la Administración de Medicamentos y Alimentos (FDA) de EE. UU, - que los resultados de desarrollo son reproducibles. Por lo tanto, es importante que las reglas estén claramente definidas y se cumplan para experimentos virtuales (como los realizados mediante herramientas predictivas), experimentos de laboratorios y todos los datos asociados. El desafío es mantener esos datos para que el modelo y sus resultados sean reproducibles en el futuro.

Los datos utilizados en investigación deben ser completos, coherentes, correctos y contextualizados. Los trabajadores deben, además, asegurar que la información utilizada no se modifique respecto a la original. Deben existir procedimientos para el control de los datos, para garantizar que se gestionen de manera adecuada. La gestión adecuada del ciclo de vida de los experimentos virtuales, los experimentos de laboratorio y todos los datos asociados son tan importantes como los resultados de los experimentos. Esto, como se comentó al principio, puede suponer que el ciclo de vida de un proceso de investigación farmacológica sea mayor o menor, siempre en función de las herramientas empleadas.

Como alinear experimentos virtuales y reales

A medida que los expertos se esfuerzan por desarrollar terapias exitosas para poblaciones de pacientes cada vez más personalizadas, la colaboración efectiva y la cooperación precompetitiva pueden ayudarlos a predecir la inmunogenicidad con mayor precisión. Los profesionales de la industria necesitan soluciones que permitan la reproducibilidad de los resultados experimentales, impongan la integridad de los datos y ofrezcan entornos de trabajo que sean fácilmente accesibles para personas con una amplia gama de experiencia. Se busca equipar con estándares y protocolos que consideren que los experimentos virtuales y reales son socios equitativos en el desarrollo de productos bioterapéuticos. Los científicos podrán tomar mejores decisiones e identificar antes las respuestas inmunitarias potenciales.

Y usted, ¿qué método utiliza para mejorar su rendimiento y, con él, la obtención de mejores resultados? Pregúntenos si quiere más información sobre los métodos de los que disponemos.