- Detalles

- Categoría: Lakes

- Visto: 1061

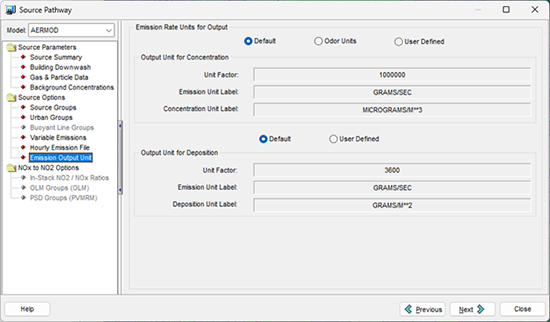

El modelo AERMOD incluye unidades predeterminadas para las entradas de emisiones y las salidas de concentración o deposición. Las emisiones se expresan en gramos por segundo (g/s) y las concentraciones se calculan en microgramos por metro cúbico (µg/m³) . Sin embargo, puede que sea necesario modificar estas unidades predeterminadas para representar mejor los datos del proyecto. Este cambio se puede realizar fácilmente mediante las opciones Source Pathway.

En Source Pathway, busque en Source Options y selecciona la configuración de Emission Output Unit.

Para habilitar unidades personalizadas, seleccione el botón User Defined. El usuario podrá introducir sus propios valores para cada uno de los tres campos:

- Unit Factor: El factor utilizado para convertir las unidades de entrada de la tasa de emisión a las unidades de salida. El factor predeterminado de 1000000 se utiliza para obtener microgramos a partir de la entrada de gramos.

- Emission Unit Label: La etiqueta aplicada a la unidad de emisión. Puede tener hasta 40 caracteres.

- Concentration Unit Label: La etiqueta de la unidad de salida. Puede tener hasta 40 caracteres.

Como se muestra arriba, las unidades personalizadas también se pueden aplicar a los cálculos de deposición.

Un ejemplo de cómo los ajustes en las etiquetas de unidades pueden mejorar la legibilidad de los datos es cuando las unidades predeterminadas producen valores numéricos demasiado grandes o demasiado pequeños para que el modelo los escriba con precisión. Por ejemplo, emisiones muy bajas para una fuente dada (p. ej., 1E-6 g/s) pueden resultar en concentraciones demasiado pequeñas para que el modelo las escriba (<1E-5 µg/m³). En esta situación, se podría:

- Modificar el factor de unidad a 1000

- Reducir la magnitud de la Emission Unit Label a MICROGRAMOS/SEC

- Escriba la Concentration Unit Label como NANOGRAMS/M**3

- Cambie el valor de las emisiones de entrada en el cuadro de diálogo Entrada de fuentes para reflejar la nueva unidad

Con esta modificación, los valores de salida tendrán mayor precisión haciendo que los gráficos de contorno sean más fáciles de leer.

- Detalles

- Categoría: MapleSim

- Visto: 1224

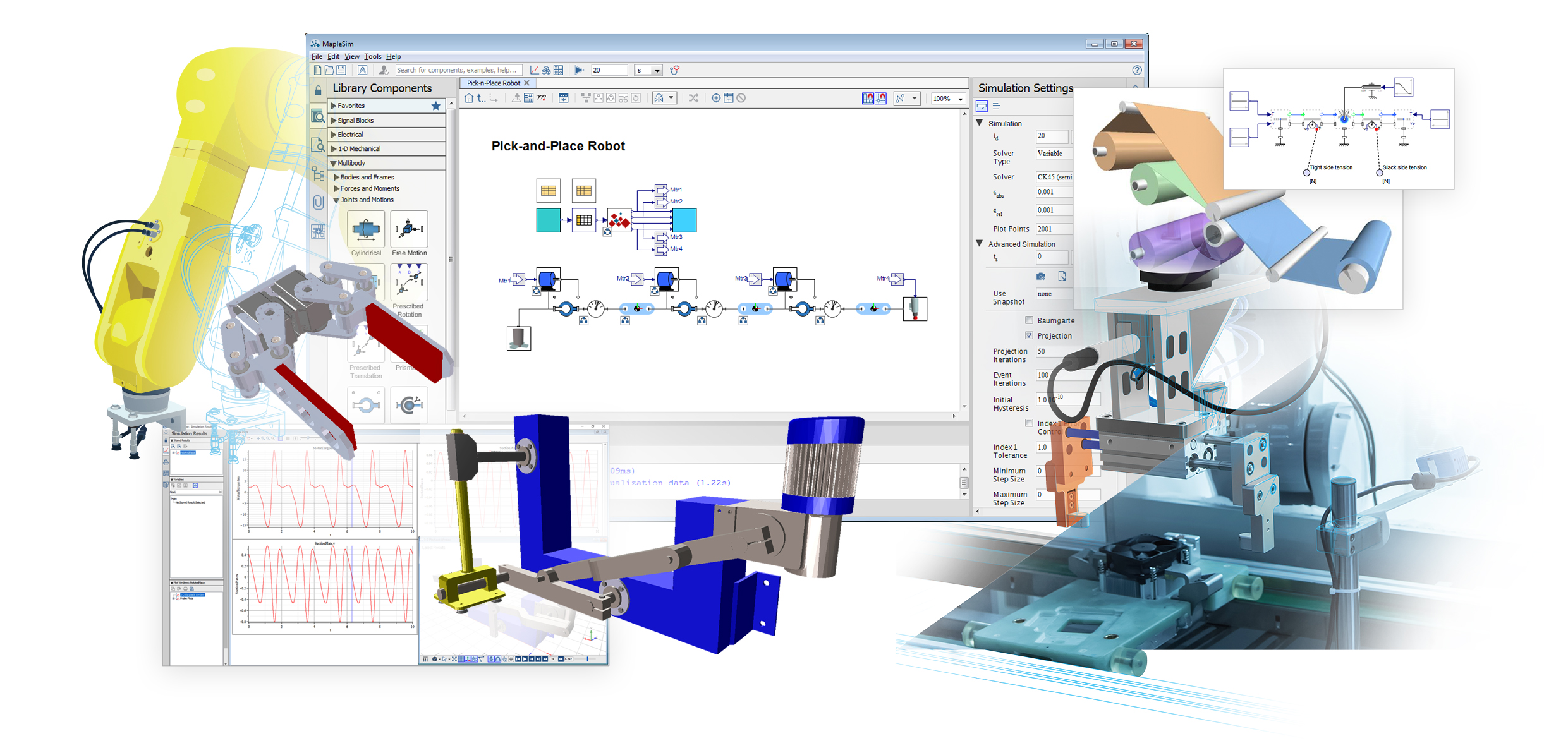

MapleSim 2025 ofrece una serie de mejoras para ahorrar tiempo y esfuerzo al crear y analizar simulaciones.

Esta versión incluye una nueva biblioteca de componentes para respaldar el modelado de controladores de motores, actualizaciones de varias aplicaciones dentro del producto que facilitan aún más la realización de optimizaciones y análisis, y un motor de cálculo actualizado para aprovechar las mejoras recientes que estuvieron disponibles en Maple 2025.

Nueva biblioteca de componentes: controladores de motor

Los aspectos más destacados incluyen:

|

|

Actualizaciones de las aplicaciones de análisis de modelos

|

|

- Detalles

- Categoría: Comsol

- Visto: 1240

Los análisis de sensibilidad constituyen una técnica que permite comprender cómo las variaciones de los parámetros de entrada como propiedades de los materiales, dimensiones, cargas, etc., afectan a su modelo. Este tipo de análisis se puede aplicar en los siguientes escenarios:

- Se necesitas realizar cambios para mejorar el rendimiento de un diseño y quiere averiguar cuáles son los cambios más eficaces para alcanzar sus objetivos.

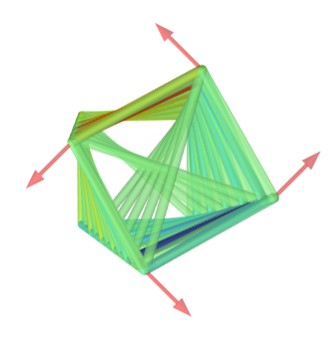

¿Quiere conocer cómo llevar a cabo este tipo de análisis en COMSOL Multiphysics®? Se lo contamos en este artículo a través del siguiente ejemplo que trata sobre una torre de celosía como la que se muestra en la Figura 1 [1]. El modelo utiliza elementos de viga delgada (representados como una cruz negra en la parte superior de la figura de la derecha) para medir la inclinación y la guiñada [2].

Fig.1 Los casos de carga de flexión y torsión (izquierda) y la definición de la deformación por guiñada (yaw) e inclinación (tilt) (derecha), que se calcula utilizando los desplazamientos en los cuatro nodos superiores.

La torre está sometida a cargas de torsión y flexión en la parte superior, como se ilustra en la parte izquierda superior de la Figura 1. El modelo utiliza elementos de celosía (truss), los cuales no contienen información sobre la rotación. Sin embargo, esta información es necesaria para calcular la inclinación (tilt angle) y la guiñada (yaw angle). Las cargas que aplican en los vértices de la parte superior de la torre se muestran en la Figura 2.

Fig.2 Cargas aplicadas en los cuatro nodos superiores de la torre.

En el ejemplo se lleva a cabo un doble análisis de sensibilidad. Para añadir cualquiera de ellos, podemos hacer clic con el botón derecho del ratón en el estudio y seleccionamos “Sensitivity analysis” entre las opciones que aparecen, tal y como se muestra en la Figura 3.

Fig.3 Forma de añadir el análisis de sensibilidad con muestra de los dos análisis de sensibilidad incluidos en el ejemplo de la torre de celosía.

En un primer análisis de sensibilidad etiquetado como “Tilt sensitivity” se analiza el efecto que tienen las cargas que se aplican en la inclinación de la torre; en el segundo análisis de sensibilidad etiquetado como “Yaw sensitivity” se estudia el efecto de esas cargas en la torsión de la torre. En ambos casos, para las vigas verticales como las transversales e inclinadas. En la Figura 3 se destacan estos dos análisis de sensibilidad incluidos como nodos del Model Builder.

En cuanto a los resultados obtenidos, la Figura 4 (a) muestra cómo varía en la inclinación de las vigas debido a las cargas que actúan en la parte superior de la torre de celosía, y en la Figura 4 (b) se muestra la variación en la guiñada.

Fig.4 Resultados obtenidos de los análisis de sensibilidad. (a) Variación de la inclinación. (b) Variación de la guiñada.

Referencias

[1] COMSOL Blog. How to Perform a Sensitivity Analysis in COMSOL Multiphysics®, by K.E. Jensen (2020) https://www.comsol.com/blogs/how-to-perform-a-sensitivity-analysis-in-comsol-multiphysics

[2] COMSOL Multiphysics® Application Gallery. Sensitivity Analysis of a Truss Tower (Application ID: 72101) https://www.comsol.com/model/sensitivity-analysis-of-a-truss-tower-72101

- Detalles

- Categoría: Signals ChemDraw

- Visto: 2530

ChemDraw Prime

La opción básica, rápida y eficiente para crear dibujos químicos estándar. Perfecta para generar gráficos de moléculas y reacciones con estilo editorial en minutos. Ideal si necesitas productividad sin complicaciones.

ChemDraw Professional

Va un paso más allá. Incluye predicciones avanzadas (pKa, espectros NMR ^1H y ^13C), conversión nombre‑a‑estructura y viceversa, y acceso a bases de datos científicas como SciFinder‑n y Reaxys . Si tu trabajo exige análisis computacional y búsquedas químicas integradas, esta es tu opción.

Signals ChemDraw

La versión más completa rompe el molde: integra un ecosistema en la nube, gestión centralizada de licencias y control por usuario mediante la plataforma Signals. Permite acceso desde desktop y web, sincronización automática, colaboración en equipo, almacenamiento en la nube y herramientas específicas para biopolímeros (HELM monómeros) . Es ideal si tu flujo de trabajo está orientado al trabajo en equipo y gestión avanzada de datos químicos.

| VERSIÓN | IDEAL PARA... | CARACTERÍSTICAS CLAVE |

| Prime | Dibujos estándar de moléculas/reacciones | Rápido y con herramientas básicas de dibujo |

| Professional | Investigación química y espectroscópica | Predicciones NMR, nombre↔estructura, integración con bases de datos |

| Signals ChemDraw | Equipos colaborativos, nube y gestión de datos químicos | Licencias Saas, formación basada en la nube, colaboración, HELM |

¿Y tú qué necesitas?

- ¿Dibujar moléculas para presentaciones o publicaciones? → ChemDraw Prime

- ¿Necesitas predicciones NMR o búsquedas químicas? → ChemDraw Professional

- ¿Trabajas en equipo, usas nube o gestionas datos complejos? → Signals ChemDraw

¿No estás segura aún? Con esta guía podrás responder a la pregunta clave: ¿Cuál ChemDraw es mejor para ti?

Según tus necesidades, ya sabes: desde rapidez con Prime hasta colaboración total con Signals.

- Detalles

- Categoría: NAG

- Visto: 1567

Publicado por NAG el 6/12/2025

Optimización no convexa y estocástica en 2025: Los motores de la inteligencia del mundo real

1. La forma de la complejidad en los sistemas modernos

Históricamente, la optimización se limitaba en gran medida a problemas convexos bien estructurados, entornos donde las garantías teóricas y la eficiencia algorítmica se alineaban perfectamente. Esto tenía sentido: los algoritmos para programas lineales y convexos a gran escala, capaces de manejar millones de variables y restricciones, han madurado durante décadas. Por el contrario, los problemas no convexos, incluidos los que involucran estructuras discretas o combinatorias, seguían siendo computacionalmente intratables a escala. Pero para 2025, el panorama ha cambiado. Los sistemas comerciales modernos se definen cada vez más por la complejidad, la escala y la incertidumbre. A medida que las industrias pasan de marcos deterministas basados en reglas a arquitecturas basadas en datos infundidas con aleatoriedad, dos pilares metodológicos han surgido como esenciales: la no convexidad y la estocasticidad. Estos forman la base matemática para una optimización robusta y adaptativa en el mundo real.

- La no convexidad se refiere a problemas donde la función objetivo o las restricciones presentan múltiples mínimos locales, mesetas planas o discontinuidades. Resolver estos problemas requiere escapar de los óptimos locales y explorar globalmente.

- La estocasticidad implica modelar explícitamente la aleatoriedad. Esto es crucial cuando los datos, las entradas o los entornos son ruidosos, incompletos o cambiantes, condiciones que prevalecen en casi todos los contextos operativos a gran escala. La combinación de optimización y procesos estocásticos es una de las más fructíferas en las matemáticas aplicadas.

Estos dos paradigmas, utilidados solos o juntos, forman la columna vertebral computacional de los sistemas modernos de toma de decisiones.

2. Donde importa: Seis frentes de transformación

2.1. IA y aprendizaje automático

El aprendizaje profundo, la base de la IA moderna, implica inherentemente entornos de optimización no convexos. Entrenar una red neuronal implica minimizar una función de pérdida de alta dimensión, plagada de puntos de silla y mínimos locales. Los métodos basados en gradientes, como el descenso de gradiente estocástico (SGD), funcionan bien en la práctica, pero métodos más recientes, como las estrategias evolutivas y la optimización bayesiana, están ganando terreno para el ajuste de modelos y la búsqueda de hiperparámetros.

Además, la búsqueda de arquitectura neuronal (NAS), donde se aprende la arquitectura del modelo, requiere resolver un problema combinatorio, no convexo y estocástico que combina aprendizaje y optimización. Los algoritmos de aprendizaje por refuerzo también dependen en gran medida de la estocasticidad para explorar espacios de estados y mejorar las políticas a lo largo del tiempo.

2.2. Sistemas distribuidos

Los entornos informáticos distribuidos modernos, desde el aprendizaje federado en dispositivos de borde hasta los clústeres masivos en la nube, se enfrentan a condiciones dinámicas que dificultan la optimización. En el aprendizaje federado, cada dispositivo cliente tiene su propia distribución de datos, lo que genera pérdidas locales no idénticas. El modelo global debe minimizar una suma ponderada de estos objetivos heterogéneos:

dónde refleja la importancia del cliente o el volumen de datos. En los sistemas en la nube, las tareas deben programarse para optimizar la latencia, el coste y el uso de recursos, a menudo con cargas de trabajo inciertas y disponibilidad de recursos cambiante. Estas condiciones introducen naturalmente costes no convexos y entradas estocásticas.

2.3. Energía y sostenibilidad

Los sistemas eléctricos son cada vez más complejos e integran fuentes intermitentes como la eólica y la solar. La optimización en este ámbito suele implicar problemas de compromiso de unidades no convexas y pronósticos estocásticos de la oferta y la demanda. Los operadores deben garantizar el equilibrio y la estabilidad, minimizando al mismo tiempo las emisiones de carbono y los costes.

2.4. Gestión de costes de la nube

La computación en la nube introduce diversos modelos de precios:

- Bajo demanda: coste lineal

- Instancias reservadas: tarifa fija para compromiso a largo plazo

- Precios al contado: fluctúan con la oferta y la demanda

El panorama de costos totales no es uniforme y varía con el tiempo. Los sistemas FinOps basados en IA optimizan las previsiones aleatorias de la demanda futura, aprovechando las condiciones del mercado y garantizando la fiabilidad.

2.5. Cadenas de suministro y logística

Las cadenas de suministro y las redes logísticas modernas operan en entornos altamente dinámicos, condicionados por interrupciones en tiempo real, variabilidad de la demanda, plazos de entrega inciertos y complejas restricciones geopolíticas. Los enfoques de optimización tradicionales, como los algoritmos de ruta más corta o los programas lineales deterministas, resultan insuficientes cuando las funciones de costes son no lineales, la información es incompleta o las acciones deben adaptarse secuencialmente a lo largo del tiempo.

Consideremos un ejemplo canónico: la planificación de movimientos para sistemas logísticos autónomos, como drones, vehículos de reparto autónomos o agentes robóticos de almacén. Estos sistemas deben determinar una trayectoria durante un horizonte de planificación , donde cada representa el estado del sistema (por ejemplo, ubicación, velocidad) en el paso de tiempo . Un problema general de optimización de trayectoria se puede formular como:

Donde:

- es una función de coste que captura el tiempo de viaje, el consumo de energía o la exposición al riesgo entre estados consecutivos,

- denota la región factible que varía en el tiempo, teniendo en cuenta las condiciones del tráfico, las zonas de exclusión aérea, las restricciones del terreno o los límites reglamentarios,

- Las restricciones también pueden incluir prevención dinámica de colisiones y límites de uso de recursos (pr ejemplo, niveles de batería).

Esta formulación es inherentemente no convexa, debido a:

- Dinámica no lineal o restricciones cinemáticas (por ejemplo, radios de giro del vehículo, límites de aceleración),

- Estructuras de costes fragmentadas o discontinuas (por ejemplo, precios de congestión o umbrales de peaje),

- Evitación de obstáculos modelada mediante exclusiones espaciales no convexas.

Debido a la presencia de incertidumbre, factores como tiempos de viaje estocásticos, actualizaciones meteorológicas en tiempo real o picos de demanda inesperados conducen a:

- Formulaciones de planificación estocástica, donde el costo o la disponibilidad del viaje dependen del escenario,

- Control en línea o de horizonte regresivo, actualizando continuamente los planes basados en sensores en vivo y datos del mercado.

En la práctica, los métodos de solución incluyen:

- Planificadores de movimiento basados en muestreo (por ejemplo, RRT*, PRM) para búsqueda de viabilidad de alta dimensión,

- Programación no lineal de enteros mixtos (MINLP) para incorporar lógica de control discreta (por ejemplo, selección de segmento de ruta),

- Aprendizaje por refuerzo para aprender políticas adaptativas en condiciones de incertidumbre.

- Búsqueda heurística o metaheurística (por ejemplo, recocido simulado, algoritmos genéticos) para la generación de rutas en tiempo real.

A medida que las infraestructuras logísticas escalan y aumenta la autonomía, los marcos de optimización no convexos y estocásticos se vuelven indispensables para permitir una toma de decisiones resiliente, eficiente y en tiempo real en las cadenas de suministro globales.

2.6. Métodos de optimización modernos

Para abordar estos desafíos, los enfoques híbridos y heurísticos son comunes:

- Las metaheurísticas como los algoritmos genéticos y la optimización por enjambre de partículas exploran espacios de soluciones robustos.

- Los modelos de aprendizaje de refuerzo plantean los problemas como decisiones secuenciales bajo incertidumbre.

- La optimización combinatoria neuronal aprende a resolver problemas de optimización utilizando redes neuronales.

Estos métodos evitan los supuestos de convexidad o determinismo, lo que permite una optimización robusta en condiciones de complejidad del mundo real.

3. Caso práctico: Optimización de cartera moderna

3.1. Definiciones y configuración

Sea:

- el vector de ponderación de la cartera, donde cada es la fracción de capital asignada al activo

- es el vector de retorno de los activos en el escenario

- es la probabilidad asociada con el escenario , donde

- es la pérdida de cartera en el escenario , definido como el rendimiento negativo

3.2. Limitaciones de los modelos clásicos

La optimización de cartera tradicional utiliza el marco media-varianza

donde:

- es el vector de rendimientos esperados

- es la matriz de covarianza de los retornos

- es el rendimiento mínimo requerido de la cartera

Esta formulación supone rendimientos distribuidos normalmente, convexidad y restricciones lineales, que rara vez se cumplen en los mercados reales, donde los rendimientos suelen seguir distribuciones leptocúrticas y asimétricas.

3.3. Riesgo de cola y optimización CVaR

Para gestionar los riesgos asimétricos y de cola pesada, definimos

y minimizamos el Valor de Riesgo Condicional (CVaR) en el nivel

donde:

- es una variable auxiliar que representa el Valor en Riesgo (VaR), es decir, el cuartil

- captura el exceso de pérdida más allá de en cada escenario

3.4. Restricciones no convexas y realismo del mercado

La región factible del mundo real incluye:

- Costes de transacción: Modelados como funciones lineales o no lineales por partes según el volumen comercial

- Restricciones de liquidez:

- Regulatorio/ESG: Límites de exposición sectorial, puntuaciones de carbono o zonas de exclusión

Estas restricciones a menudo introducen no convexidades en el problema.

3.5. Resolvedores, algoritmos e implementación

Los procesos de optimización prácticos suelen combinar estrategias globales y locales (algoritmos genéticos, recocido simulado, aprendizaje por refuerzo y métodos híbridos) para abordar entornos complejos y no convexos. Las instituciones financieras implementan estas soluciones mediante computación en la nube para el paralelismo, GPU para la aceleración de Monte Carlo, fuentes de datos en tiempo real para la reoptimización adaptativa y rigurosas pruebas de estrés para garantizar su robustez.

4. Conclusión

La optimización actual refleja la complejidad de los sistemas que gobierna. La no convexidad nos permite modelar la naturaleza no lineal, sujeta a restricciones e irregular de los sistemas reales, mientras que los métodos estocásticos incorporan la aleatoriedad como parte intrínseca de la toma de decisiones. Juntos, forman un marco unificado para operaciones adaptativas, escalables y robustas en IA, finanzas, energía y logística. En un mundo cada vez más marcado por la incertidumbre y la escala, estas herramientas ya no son opcionales: son fundamentales.

Referencias

Shapiro, A., Dentcheva, D., y Ruszczynski, A. (2014). Lectures on Stochastic Programming: Modeling and Theory (2nd ed.). Society for Industrial and Applied Mathematics (SIAM). Una referencia completa sobre programación estocástica, que incluye CVaR, modelado de escenarios y fundamentos teóricos.

Boyd, S., y Vandenberghe, L. (2004). Convex Optimization. Cambridge University Press. El texto fundacional sobre optimización convexa, frecuentemente citado para destacar dónde fallan los supuestos convexos.

- Detalles

- Categoría: Minitab

- Visto: 1206

Simul8 es la plataforma de simulación más rápida, intuitiva y eficaz del mundo, tanto para escritorio como para la web, donde los clientes pueden experimentar con modelos digitales de procesos reales para tomar decisiones fiables e impactantes.

¿Cómo funciona la simulación?

Una simulación es un modelo animado que imita el funcionamiento de un sistema existente o propuesto, como laoperación diaria de un banco, el funcionamiento de una línea de montaje o la asignación de personal en un hospital o centro de llamadas.Con un software de simulación intuitivo como Simul8, puede crear una maqueta visual, similar a la creación de un diagrama de flujo. Al añadir tiempos y reglas a las tareas, recursos y restricciones que conforman su sistema, la simulación puede representar con precisión su proceso real. La simulación ofrece un enfoque muy potente, basado en evidencias, para la toma de decisiones: al usar una representación visual para probar el impacto de los cambios de proceso y los escenarios hipotéticos, puede encontrar un enfoque que brinde los mejores resultados. |

Algunas de las funciones de Simul8 incluyen:

- Simular eventos discretos: transforme la toma de decisiones con un software de simulación rápido e intuitivo.

- Obtener respuestas con gemelos digitales: cree un enfoque rentable para la toma de decisiones en su organización.

- Desbloquear la minería de procesos: cree la estructura completa de su simulación a partir de su registro de datos con un solo clic.

- Planificar para cada escenario: pruebe múltiples ideas en segundos y descubra una forma eficiente de avanzar.

- Detalles

- Categoría: Comsol

- Visto: 977

Introducción y objetivos

La conductividad eléctrica (EC) de una masa para pastel es una propiedad crítica en procesos de cocción por calentamiento óhmico, ya que determina la distribución de calor y afecta fenómenos como la gelatinización del almidón. Sin embargo, su medición experimental es compleja debido a los gradientes de temperatura que se generan en el dispositivo de medición.

El trabajo desarrollado por Niane y sus colaboradores, titulado “Development of a numerical model for measuring the electrical conductivity (EC) of a cake batter” en la revista “Journal of Food Engineering” de Elsevier presenta el desarrollo de un modelo numérico robusto para estimar la EC de la masa de pastel en función de la temperatura y bajo la influencia de campos eléctricos elevados. Para ello los investigadores utilizaron COMSOL Multiphysics®.

Modelización y simulación numérica

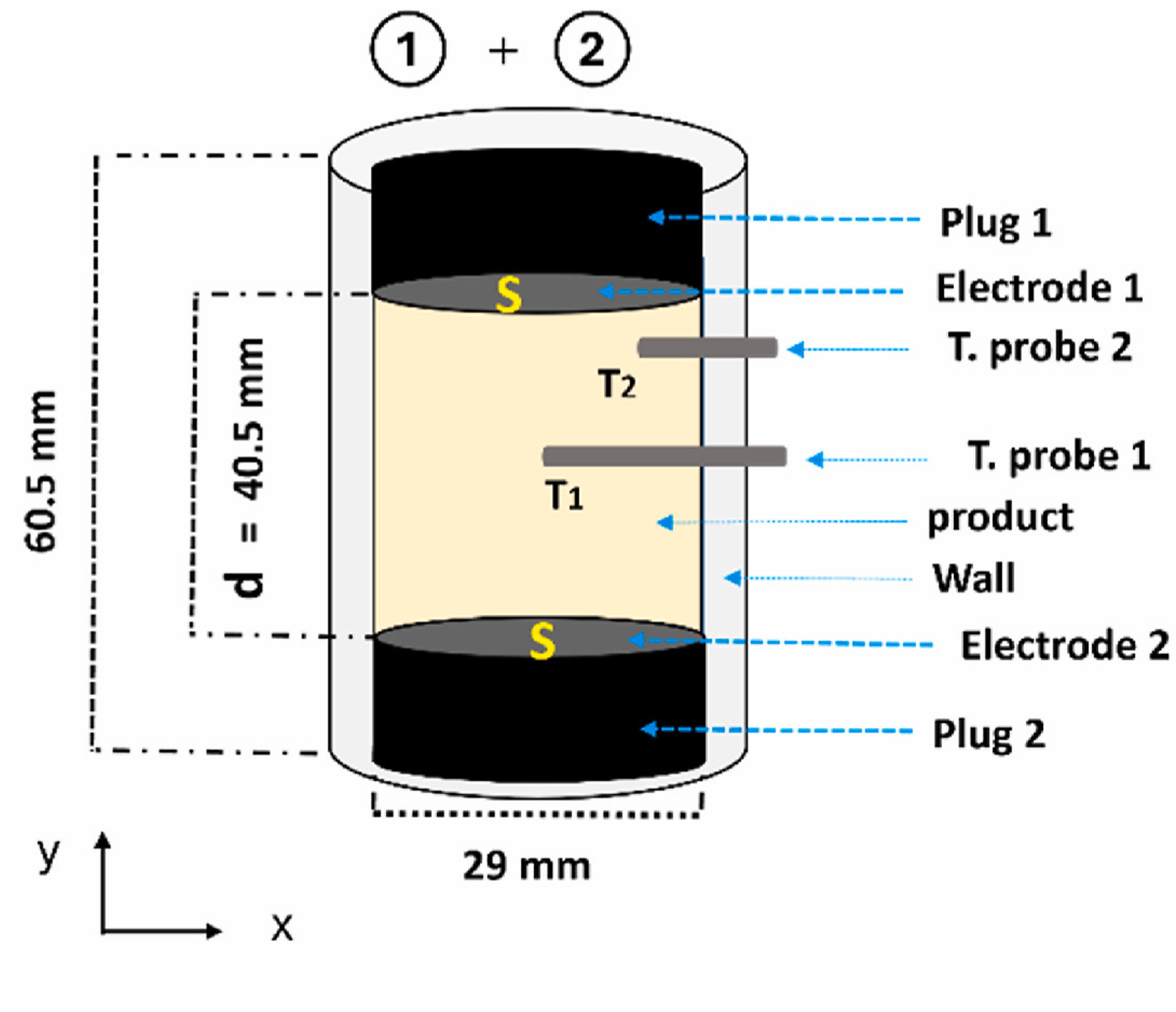

El modelo se desarrolló en COMSOL Multiphysics® usando una geometría bidimensional con simetría axial del dispositivo experimental que se muestra en la Figura 1.

La EC de la masa se modeló como función de la temperatura y del grado de gelatinización del almidón, este último descrito por una cinética de primer orden acoplada a una ley de Arrhenius. La optimización de los parámetros del modelo se realizó mediante el método de Nelder-Mead, comparando perfiles de temperatura experimentales y simulados.

Para optimizar el tiempo de cálculo, se utilizó un modelo bidimensional con simetría axial. La malla consistió en 3648 triángulos, 508 elementos de contorno, 23,274 grados de libertad y una calidad media de malla de 0.812. El tiempo de cálculo requerido fue de 20 segundos, utilizando los siguientes módulos en COMSOL Multiphysics®: Transferencia de Calor, Corriente Eléctrica, Flujo Laminar (para el caso del KCl, donde ocurre convección natural) y Optimización General.

Figura 1. Diagrama de un electrolizador para la electro-hidrogenación directa de tolueno.

Resultados/conclusiones

El modelo permitió reproducir con alta precisión los perfiles de temperatura medidos experimentalmente, tal y como se muestra en la Figura 2. La Figura 3 muestra las conductividades eléctricas (EC) de la masa para cada potencial eléctrico. Los resultados muestran que la EC aumentó con el incremento del voltaje. Por último, La Figura 4 muestra la tasa de gelatinización experimental y la obtenida a partir del modelo.

Figura 2. Comparativa entre la temperatura medida y calculada, para distinta cantidad de aditivo.

En definitiva, COMSOL Multiphysics® se muestra como una herramienta poderosa para integrar múltiples fenómenos físicos y validar modelos experimentales complejos, proporcionando información crucial para la optimización de procesos también el ámbito gastronómico.

Figura 3. Conductividad eléctrica de la masa de pastel a diferentes potenciales eléctricos.

Figura 4. tasa de gelatinización experimental y la obtenida a partir del modelo.

Referencias

[1] Niane et al. “Development of a numerical model for measuring the electrical conductivity (EC) of a cake batter”. Journal of Food Engineering (2026) 402 112687.