- Detalles

- Categoría: Maple

- Visto: 5795

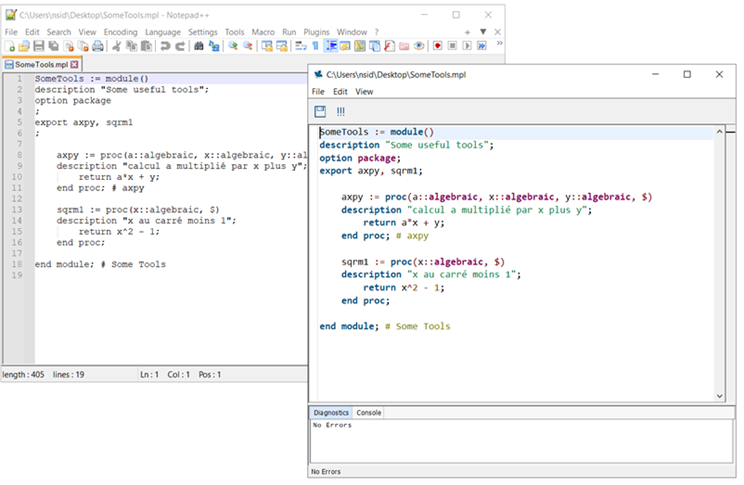

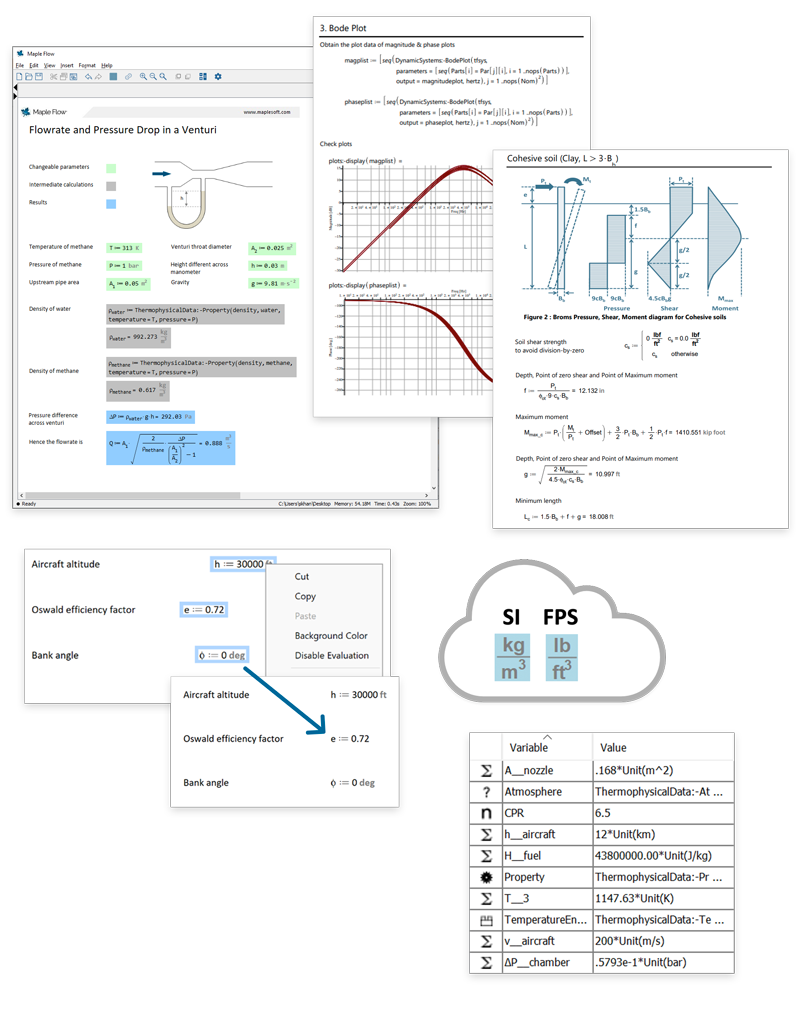

El editor de código de Maple incluye muchas funciones para facilitar la escritura, lectura y depuración de código de Maple, y está disponible para administrar código de inicio, regiones de edición de código y código adjunto a componentes incrustados.

- Resaltado de sintaxis: las palabras clave y los operadores de Maple están coloreados, lo que facilita la detección de errores tipográficos y la identificación de bloques de código.

- Coincidencia de corchetes: al escribir un nuevo carácter de corchete o colocar el cursor junto a uno existente, se resalta su contraparte, por lo que es más fácil emparejarlos.

- Coincidencia de comillas: se resaltan los caracteres de comillas simples, dobles o inversas que no coinciden o que faltan.

- Sangría automática: Después de ingresar la primera línea de un nuevo módulo, procedimiento o declaración si/entonces, las líneas subsiguientes se sangran automáticamente.

- Finalización de comandos: los comandos se pueden ingresar más rápidamente y sin errores escribiendo las primeras letras de su comando y luego seleccionando su elección de una lista de posibles finalizaciones.

- Comprobación de errores: el código se comprueba continuamente en busca de errores a medida que escribe, lo que facilita la identificación de problemas rápidamente.

- Importación/exportación: importe fácilmente código desde .mpl u otros formatos de texto directamente a su editor de código y exporte el contenido de un editor de código a un archivo de texto.

- Detalles

- Categoría: Minitab

- Visto: 7832

La validación del proceso resulta vital para el éxito de las empresas que fabrican medicamentos, vacunas, kits de prueba y muchos otros productos biológicos para personas y animales. Según las directrices de la FDA, la validación del proceso se define como "la recopilación y evaluación de datos, desde el estado de diseño del proceso hasta la producción comercial, que establece la evidencia científica de que un proceso es capaz de proporcionar un producto de calidad de manera consistente".

La FDA recomienda tres etapas para la validación del proceso. Exploraremos los objetivos de las etapas y los tipos de actividades y técnicas estadísticas que se realizan normalmente dentro de cada una. Puede usar Minitab Statistical Software para realizar cualquiera de los análisis que se mencionan aquí.

ETAPA 1: DISEÑO DEL PROCESO

Objetivo: diseñar un proceso adecuado para fabricación comercial rutinaria que pueda proporcionar de manera consistente un producto que cumpla con sus atributos de calidad.

Dentro de la etapa Diseño del proceso, es importante demostrar una clara comprensión del proceso y caracterizar la manera en que responde a diferentes variables de entrada.

Ejemplo: Identificar los parámetros críticos del proceso con Diseño de experimentos (DOE)

Supongamos que usted necesita identificar los parámetros críticos del proceso para una tableta de liberación inmediata. Hay tres variables de entrada del proceso que desea examinar:

- % de relleno

- % de disgregante

- tamaño de las partículas

Usted desea determinar las variables de entrada y la configuración de las variables de entrada que maximice el porcentaje de disolución a los 30 minutos. DOE proporciona una estrategia eficiente de recolección de datos. Las entradas se ajustan simultáneamente para identificar si existen relaciones entre las entradas y la(s) salida(s).

Ejecución del experimento: El primer paso en DOE es identificar las entradas y los rangos correspondientes de las entradas que desea explorar. A continuación, cree un diseño experimental que sirva como su plan de recopilación de datos.

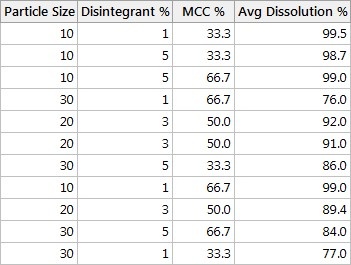

Según el diseño que se muestra en esta tabla, primero vamos a usar

- un tamaño de las partículas de 10

- disgregante de 1%

- CC a 33,3%

Luego registramos el % promedio de disolución correspondiente utilizando seis tabletas de un lote.

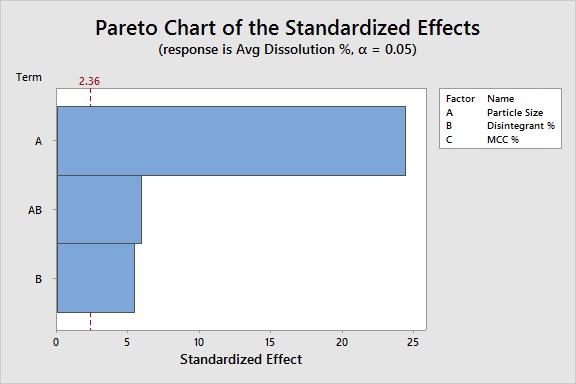

Análisis de los datos: Usando el análisis de DOE y los valores p, estamos preparados para identificar las X que son críticas. De acuerdo con las barras que cruzan la línea roja de significancia en este diagrama de Pareto, podemos concluir lo siguiente:

El tamaño de las partículas y el % de disgregante afectan significativamente el % de disolución, tal como lo hace la interacción entre estos dos factores. El % de relleno no es significativo.

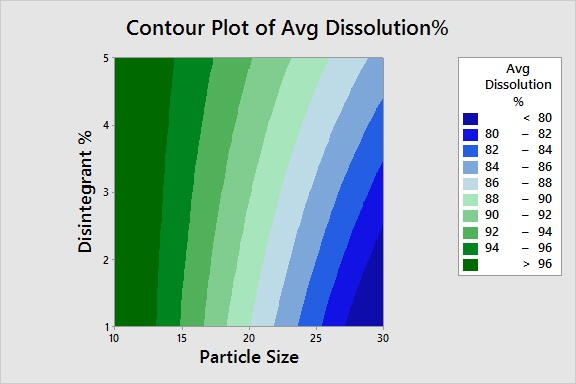

Optimización de la calidad del producto: Ahora que identificamos las X críticas, estamos preparados para determinar la configuración óptima de esas entradas. Usando una gráfica de contorno, podemos identificar fácilmente la ventana de proceso para los valores de “tamaño de las partículas” y “% de disgregante” necesarios para lograr un % de disolución de 80% o más.

ETAPA 2: CALIFICACIÓN DEL PROCESO

Objetivo: evaluar el diseño del proceso para determinar si es capaz de permitir una fabricación comercial reproducible. Antes de la distribución comercial es necesario completar la etapa 2 de manera satisfactoria.

Ejemplo 1: Evaluar los criterios de aceptación con el análisis de capacidad

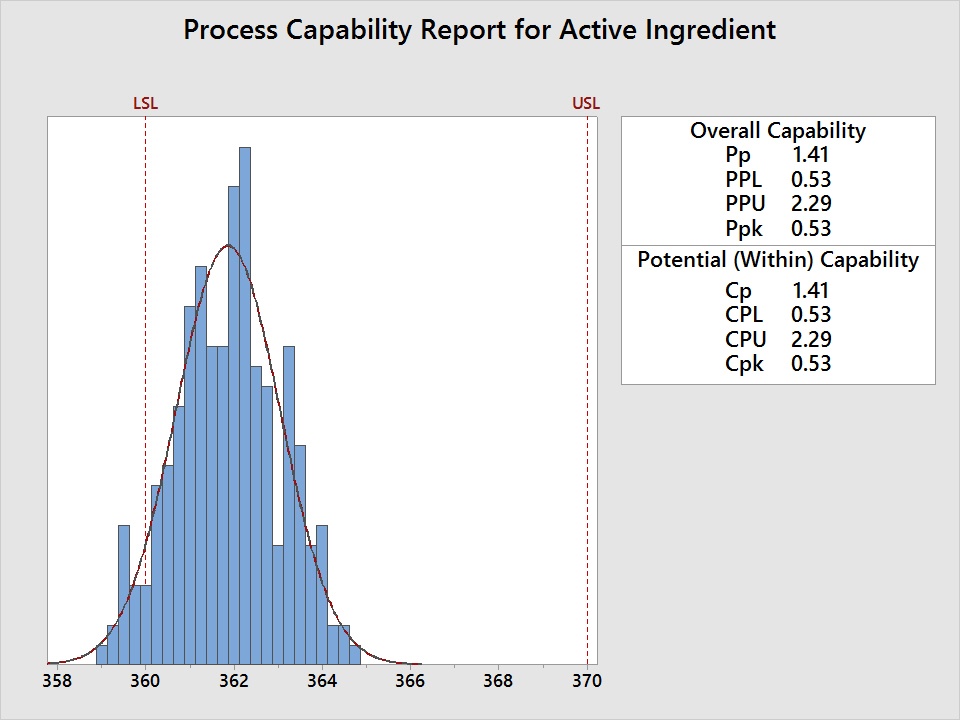

Supongamos que la cantidad de ingrediente activo en un tranquilizante debe estar entre 360 y 370 mg/ml y usted necesita evaluar el nivel de calidad, donde el criterio de aceptación se define como un Cpk mínimo de 1,33. Para evaluar el desempeño del proceso y determinar si las mediciones están dentro de las especificaciones, utilice el análisis de capacidad. Cinco muestras se seleccionan de forma aleatoria de 50 lotes y se mide la cantidad de ingrediente activo. A continuación, los datos se analizan con relación al mínimo de 360 mg/ml y el máximo de 370 mg/ml.

El análisis de capacidad revela un Cpk de 0,53, lo que no satisface el criterio de aceptación de 1,33. Las cantidades de ingrediente activo de este tranquilizante no son aceptables. ¿Entonces, cómo podemos mejorarlo?

Tanto el valor Cp de 1,41 como la gráfica revelan que, aunque la variabilidad es aceptable con respecto a la anchura de los límites de especificación, el promedio del proceso debe cambiar a una cantidad mayor de mg/ml para lograr un Cpk aceptable.

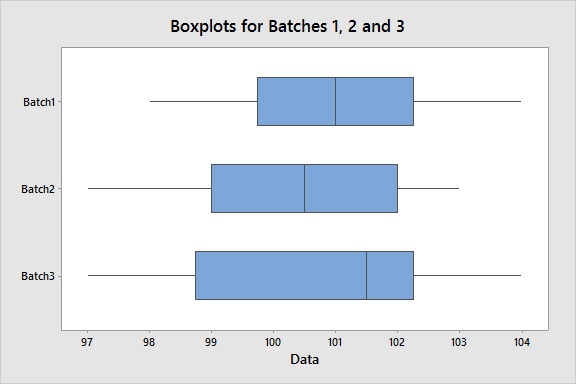

Ejemplo 2: Realizar un análisis de variación entre los lotes con gráficas de caja

Supongamos que queremos evaluar la uniformidad del contenido (una característica de calidad crítica) en tres lotes diferentes en 10 ubicaciones. Para visualizar la variación dentro de los lotes y la variación entre los lotes e identificar cualquier valor atípico, podemos crear gráficas de caja para cada lote. Esta gráfica específica muestra una dispersión homogénea de las mediciones tanto dentro de cada lote como entre los lotes. Además, no hay valores atípicos, que Minitab marcaría con un asterisco (*).

Aunque las gráficas de caja son herramientas útiles para realizar una evaluación visual, también podemos evaluar estadísticamente si existe una diferencia significativa en la variación entre los lotes usando una prueba de varianzas iguales. La prueba revela un valor p mayor que un nivel de significancia de 0,05 (o el nivel de significancia que usted prefiera), lo que apoya la conclusión de que hay consistencia entre los lotes.

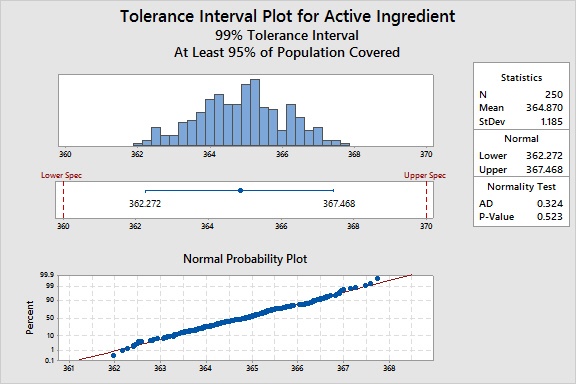

Ejemplo 3: Diversas aplicaciones de los intervalos de tolerancia

Otra herramienta útil para la calificación del proceso es el intervalo de tolerancia. Esta herramienta tiene múltiples aplicaciones. Por ejemplo, los intervalos de tolerancia pueden utilizarse para comparar su proceso con las especificaciones, describir el resultado de un proceso o establecer criterios de aceptación.

Para una determinada característica de un producto, un intervalo de tolerancia proporciona un rango de valores que es probable que abarque un porcentaje especificado de la población (por ejemplo, 95%) para un nivel de confianza especificado (como 99%).

Por ejemplo, supongamos que queremos saber cómo se comparan los valores de ingrediente activo del proceso de manufactura con nuestros límites de especificación. Con base en un estudio de dosis-respuesta, los límites son 360 a 370 mg/ml.

Para este conjunto de datos en particular, Minitab revela que podemos estar 99% seguros de que el 95% de las unidades estará entre 362,272 y 368,259 mg/ml. Por lo tanto, los límites del proceso indican que podemos cumplir los requisitos de 360 a 370, y podemos concluir con un alto grado de confianza que la variación del proceso es menor que la variación permisible, definida por los límites de especificación.

O bien, tal vez tengamos que evaluar la uniformidad del contenido usando una confianza de 99% y una cobertura de 99%. Tomamos una muestra de 30 tabletas y calculamos un intervalo de tolerancia, revelando que podemos estar 99% seguros de que el 99% de las tabletas tendrá una uniformidad de contenido dentro de cierto rango, calculado usando Minitab.

ETAPA 3: VERIFICACIÓN CONTINUA DEL PROCESO

Objetivo: proporcionar aseguramiento continuo de que el proceso se mantiene en un estado de control (el estado validado) durante la fabricación comercial.

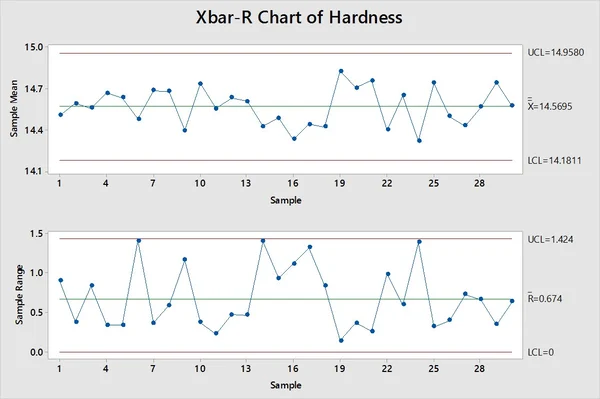

Ejemplo: Monitorear un proceso con gráficas de control

Supongamos que usted es responsable de supervisar un proceso de producción de tabletas orales. Usted necesita demostrar que la dureza es estable en el tiempo y detectar si la variación del proceso ha cambiado y, por lo tanto, requiere atención.

También desea asegurarse de que los operadores de la línea de producción no reaccionen exageradamente a pequeños cambios en los datos, que son inherentes a la variabilidad de rutina. Al evitar las reacciones exageradas, se evitan ajustes innecesarios en el proceso que realmente pudieran provocar un aumento involuntario de la variabilidad.

Usted toma una muestra de cinco tabletas por hora, mide su dureza y luego crea una gráfica de control Xbarra-R.

Esta Gráfica Xbarra-R no revela puntos marcados en rojo y, por lo tanto, indica que el proceso está bajo control estadístico. Usted puede concluir que está manteniendo el estado validado del proceso, y que no se han detectado cambios inusuales e indeseables en la media (según la gráfica Xbarra superior) ni en la variación (según la gráfica R inferior) del proceso.

Si la gráfica de control hubiera revelado un estado fuera de control (un proceso expuesto a fuentes de variación imprevistas), entonces los próximos pasos incluirían caracterizar el problema y realizar una investigación de la causa raíz. ¿Hubo un cambio en las características del material? ¿Hay un problema de mantenimiento o calibración de los equipos? ¿O hay alguna otra fuente de variabilidad que provocó un cambio en el proceso?

YA PARA FINALIZAR

La incapacidad para detectar una variación indeseable en el proceso se puede mitigar con una monitorización de rutina y con gráficas de control. Además de las gráficas de control y las herramientas estadísticas que se utilizan comúnmente para el diseño de procesos, y de las etapas de calificación y verificación continua del proceso, hay otras técnicas estadísticas útiles que pueden apoyar sus esfuerzos de validación del proceso. Por ejemplo, Minitab también incluye muestreo de aceptación para ayudarle a calcular el número de muestras que debe tomar y utilizar una muestra del producto tomada de forma aleatoria para determinar si debe aceptar o rechazar un lote entero.

- Detalles

- Categoría: Comsol

- Visto: 4865

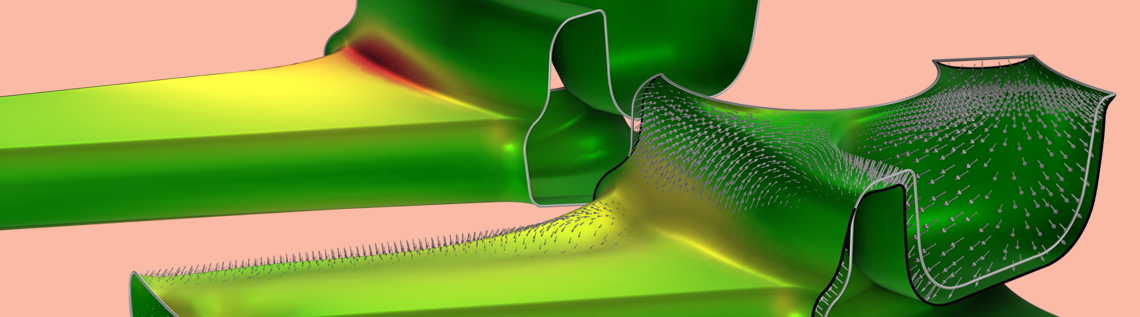

Kristian Ejlebjerg Jensen, director técnico de producto de COMSOL y responsable del módulo de optimización, nos presenta en el blog de COMSOL un método heurístico para mejorar el comportamiento de la fatiga minimizando el estrés, mediante el uso de la optimización basada en gradientes.

Tal y como explica Kristian, muchas métricas de evaluación de la fatiga se basan en la evaluación del estrés, pero son incompatibles con los métodos de optimización de alto rendimiento, como la optimización basada en gradientes. Esto hace que sea un desafío mejorar el rendimiento de la fatiga mediante la aplicación directa de métodos de optimización.

El método presentado mejora miles de variables de diseño mientras se mantienen las características de masa y rigidez del diseño, centrándose en usar la norma p de la tensión de von Mises como objetivo, pero como COMSOL Multiphysics® realiza automáticamente el análisis de sensibilidad necesario para la optimización basada en gradientes, es fácil experimentar con objetivos alternativos.

- Detalles

- Categoría: ChemOffice

- Visto: 5771

Nos gustaría informarles que Revvity Signals ChemOffice 19.x Desktop Suite (incluidos ChemDraw Prime 19.x, ChemDraw Professional 19.x y ChemOffice Professional 19.x) se encuentra ahora en la fase de extinción del ciclo de vida del producto y llegará al final de su vida útil ("EOL") el 12 de junio de 2024.

Durante la fase de extinción, continuaremos brindando soporte limitado a cada Cliente con mantenimiento activo para este Producto, como se describe en el Ciclo de vida del Producto. A excepción de las opciones de soporte descritas en el ciclo de vida del producto Revvity Signals, una vez que se alcanza el EOL, Revvity ya no proporcionará soporte técnico, actualizaciones, activaciones, códigos o acceso a la descarga de la suite ChemOffice 19.x.

Los productos de la suite de escritorio incluyen ChemDraw Prime, ChemDraw Professional, Chem3D, ChemFinder y ChemOffice Professional para la suite de escritorio 19.x. Los clientes que utilizan el control ChemDraw Active-X CDAX Const o CDAX Const NA 19.0 en E-Notebook pueden seguir usando su versión de CDAX y actualizar su entorno de escritorio a una versión posterior de ChemDraw.

Los clientes con una suscripción anual actual o bajo mantenimiento activo son elegibles para la actualización. Los clientes con licencias perpetuas existentes que no estén actualmente en mantenimiento activo pueden comprar una licencia de actualización.

- Detalles

- Categoría: Comsol

- Visto: 18978

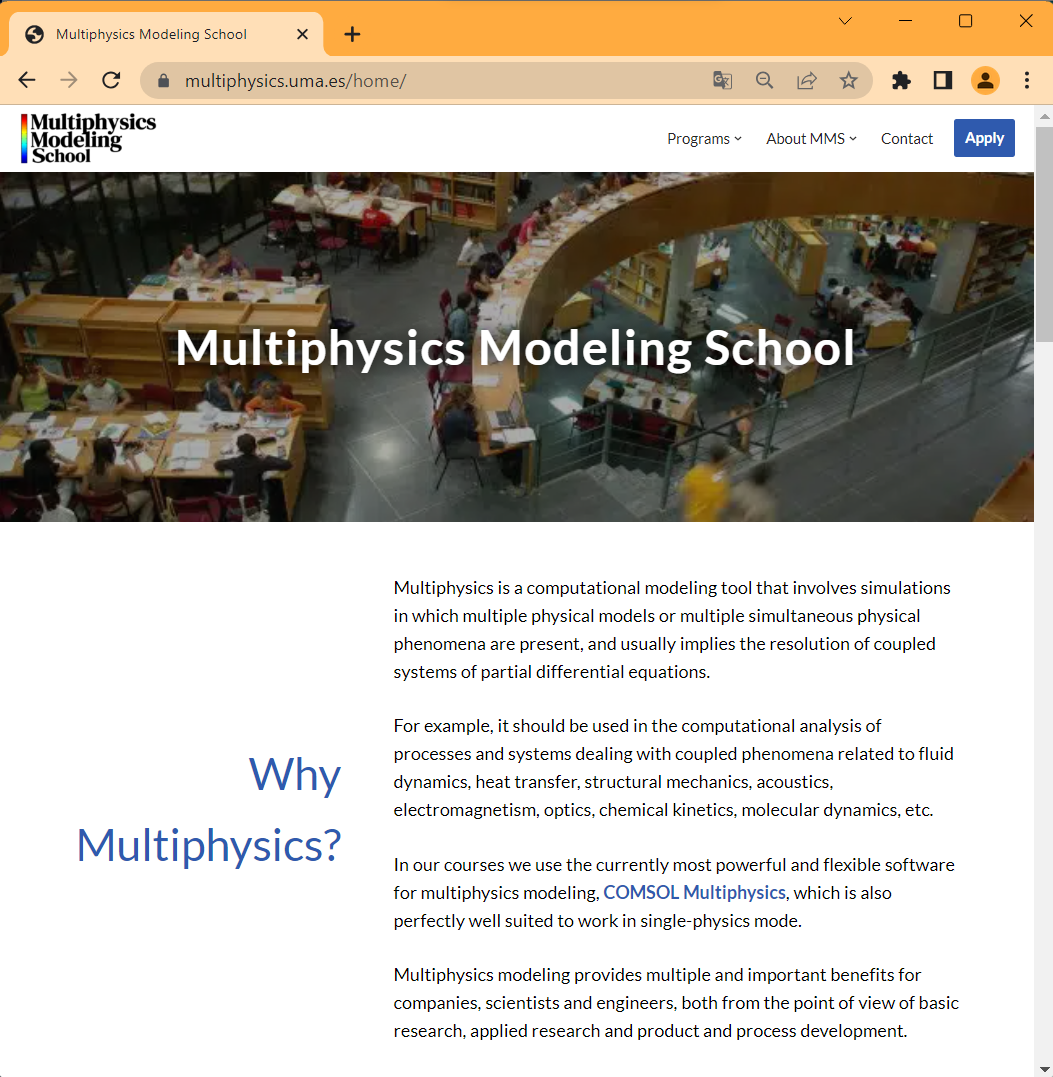

La multifísica es una herramienta de modelización computacional que implica simulaciones en las que están presentes múltiples modelos físicos o múltiples fenómenos físicos simultáneos, y suele implicar la resolución de sistemas acoplados de ecuaciones diferenciales parciales. Por ejemplo, se utiliza en el análisis computacional de procesos y sistemas que traten fenómenos acoplados relacionados con dinámica de fluidos, transferencia de calor, mecánica estructural, acústica, electromagnetismo, óptica, cinética química, dinámica molecular, etc.

Este año, la Universidad de Málaga ha creado la Multiphysics Modeling School (MMS) [1], la cual ofertará el Master's Degree in COMSOL Multiphysics Modeling. Este máster se realizará desde Octubre del 2023 hasta Junio del 2024, será dictado completamente online y en inglés. La organización ha sido llevada a cabo por la Universidad de Málaga la cual ha tenido la colaboración de otras instituciones como Addlink Software Científico, COMSOL, la Universidad Politécnica de Cataluña, el Instituto de Matemática Interdisciplinar (IMI) de la Universidad Complutense de Madrid y el Instituto Carlos I de Física Teórica y Computacional (iC1).

Una de las características más relevantes de MMS es que tendrá 4 especializaciones (programas) posibles que el alumno puede elegir. Éstas son: Electromagnetismo & Óptica, Mecánica Estructural & Acústica, Fluido Dinámica & Transferencia de Calor y finalmente Ingeniería Química & Electroquímica (ver Tabla 1). De acuerdo con la tabla, las asignaturas básicas y avanzadas son comunes para todos los alumnos. Sin embargo, las 5 asignaturas aplicadas son específicas según la elección de los interesados.

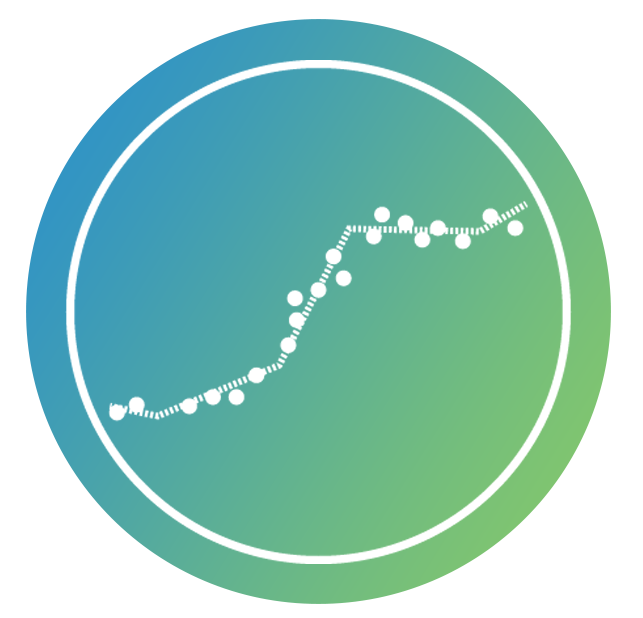

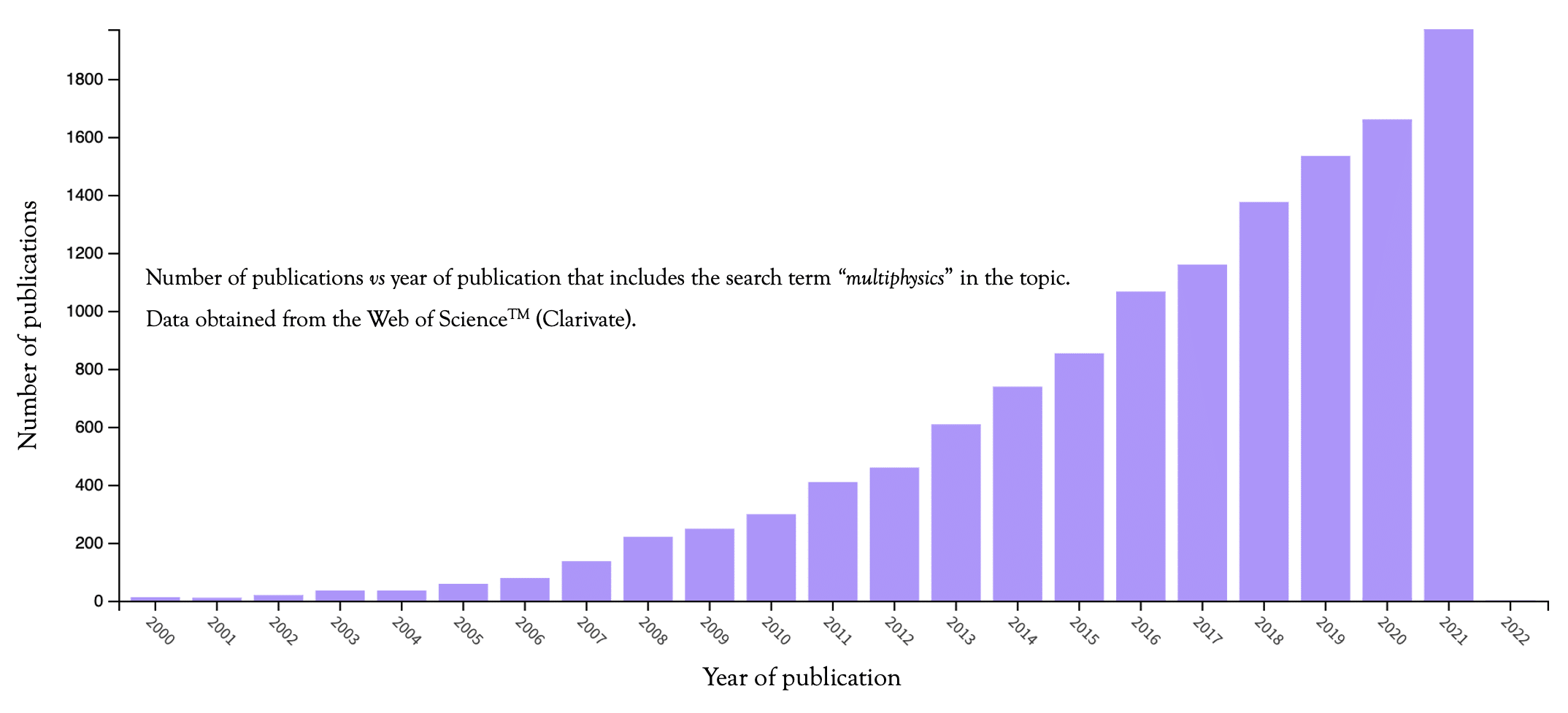

Las ventajas tras haber cursado uno de los programas es múltiple tanto para científicos, ingenieros y miembros de una empresa. Para el caso de los científicos, les permite obtener un conocimiento más detallado y profundo de los mecanismos subyacentes que a menudo están fuera del alcance experimental. Por otro lado, permite validar las ecuaciones que gobiernan un fenómeno al ser comparadas con datos experimentales. Con lo anterior se puede encontrar los parámetros clave. Esto convierte la simulación multifísica en una poderosa herramienta en la investigación científica actual. La aplicación de herramientas de la multifísica se ve reflejado en el número de publicaciones científicas que incorporan la modelización multifísica, ya que ha ido aumentando exponencialmente año tras año (Figura 1).

En el caso de ingenieros, les permite generar modelos muy realistas que incluyen el acoplamiento de diferentes efectos simultáneos. Así, se puede predecir con gran precisión el comportamiento de todo tipo de diseños, productos y dispositivos, así como facilitar su posterior optimización, ahorrando tiempo y dinero. Este hecho lo hace muy interesante para añadir al catálogo de habilidades y conocimientos de los ingenieros actuales.

Finalmente, los departamentos de investigación y desarrollo e innovación (I&D+i) de las empresas se benefician al poder crear modelos complejos de sus sistemas y dispositivos. Esto se basa en el hecho de que, cuanto mejor se comprenda el comportamiento real en la fase de diseño, antes de fabricar prototipos físicos, más se podrá optimizar el rendimiento de los productos y procesos y resolver posibles problemas, ahorrando tiempo, trabajo y costes posteriores.

Figura 1: Número de publicaciones que tratan "multiphysics" por año, desde el 2000 hasta el 2021, de acuerdo con Web of Science.

Por lo tanto, la modelización multifísica proporciona múltiples e importantes beneficios a empresas, científicos e ingenieros, tanto desde el punto de vista de la investigación básica como de la investigación aplicada y el desarrollo de productos y procesos. En efecto, poseer buenos conocimientos de modelización multifísica aumenta la calidad y cantidad de los trabajos de investigación, lo que repercute directamente en el éxito de una carrera científica, y que se ven reflejados. Para el desarrollo de productos, dichos conocimientos aumentan la versatilidad y eficiencia de las tareas de diseño y optimización, hecho que es valorado por las empresas tecnológicas e industriales. Así, una buena formación del personal en modelización multifísica es esencial para la eficacia del proceso de investigación y desarrollo en las empresas tecnológicas e industriales, lo que en última instancia redundará en una mejora de la competitividad de la empresa.

| Tipo de asignaturas | Electrogagnetism & Optics | Structural Mechanics & Acoustics | Fluid Dynamics & Heat Transfer | Chemical Engineering & Electrochemistry |

| Básicas |

Mathematical Foundations |

|||

| Aplicadas |

|

|

|

|

| Avanzadas |

Physics Builder |

|||

Tabla 1: Asignaturas básicas, aplicadas por área específica y avanzadas.

Enlaces de interés

Para aplicar al máster, se tiene que ir al enlace de Apply [2]. Allí se encuentra la información sobre requisitos, así como también los plazos y precios, así como también de los requerimientos. Desde la página de la Multiphysics Modeling School, si una persona quiere más información puede pulsar sobre Contact. Las presentaciones y tesis de máster de otros años se pueden ver en la sección Master’s thesis. Información con respecto al equipo docente y metodología de trabajo se puede ver en [5] y [6].

[1] https://www.multiphysics.uma.es/home

[2] https://www.multiphysics.uma.es/home/enrollment/

[3] https://www.multiphysics.uma.es/home/masters-thesis/

[4] https://www.multiphysics.uma.es/home/teaching-team/

[5] https://www.multiphysics.uma.es/home/methodology/

- Detalles

- Categoría: Minitab

- Visto: 6360

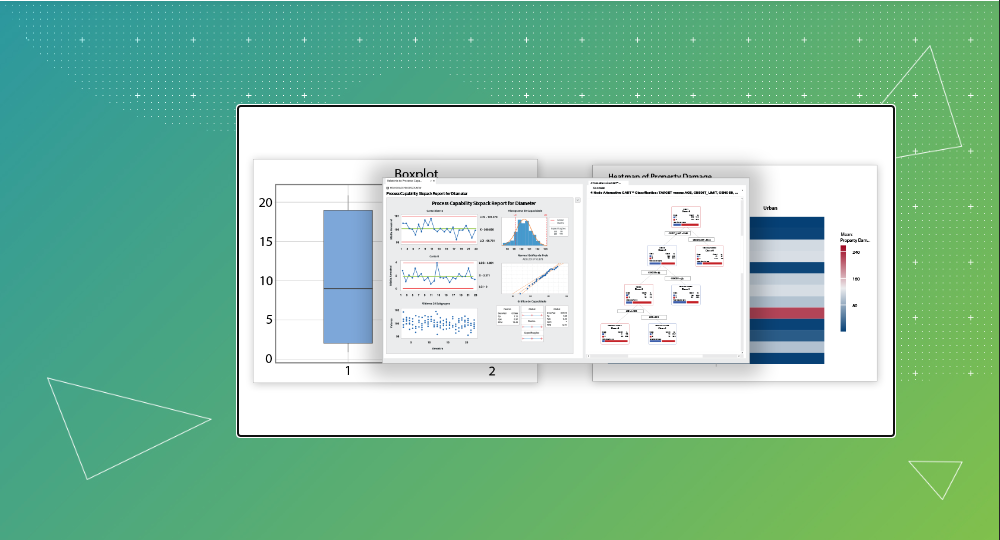

Si realmente se desea aprovechar el análisis predictivo para resolver los desafíos cotidianos, se debe de aumentar el poder analítico de los analizadores con los mejores algoritmos de aprendizaje automático más precisos de su clase. Estos proporcionan una visión más profunda de los datos. Además de proporcionar métodos estadísticos tradicionales, Minitab ha hecho que los métodos más avanzados, como los métodos basados en árboles, sean más accesibles para todos.

Lleve sus capacidades de regresión fuera de este mundo con MARS® (Splines de regresión adaptativa multivariante) o mejore sus habilidades utilizando nuestros métodos basados en árboles, como los árboles de clasificación y regresión, más conocidos como CART®, Random Forests® y gradiente potenciado, más conocido como TreeNet®. ¿No está seguro de qué método elegir? Confirme fácilmente que está utilizando el mejor modelo predictivo para responder a su pregunta con el aprendizaje automático automatizado (Auto-ML). Perfecto para aquellos que son nuevos en el análisis predictivo y necesitan recomendaciones, y expertos que buscan una segunda opinión.

CART®Árboles de clasificación y regresión |

|

Como una de las herramientas más importantes y populares en la minería de datos moderna, CART es el árbol de clasificación definitivo. CART y su motor de modelado han revolucionado el campo de la analítica avanzada e inaugurado la era actual de la ciencia de datos.

Para aquellos que son nuevos en CART, se trata de un algoritmo basado en árboles que funciona buscando muchas formas de particionar o dividir datos localmente en segmentos más pequeños en función de diferentes valores y combinaciones de predictores. CART selecciona las divisiones de mejor rendimiento, luego repite este proceso recursivamente hasta que se encuentra la colección óptima. El resultado es un árbol de decisión representado por una serie de divisiones binarias que conducen a nodos terminales que pueden describirse mediante un conjunto de reglas específicas. El árbol y su diseño son visualmente estimulantes e intuitivos de interpretar, por lo que no es necesario ser un científico de datos para comprenderlo y obtener información útil.

Diseñado para usuarios de todos los niveles, el modelo de CART puede revelar rápidamente relaciones importantes que podrían permanecer ocultas al usar otras herramientas analíticas. CART se destaca en el campo del análisis predictivo gracias a su metodología original y altamente deseable que incluye automatización integrada, facilidad de uso, rendimiento y precisión.

Propietario

La metodología de CART se basa en una teoría matemática histórica introducida en 1984 por cuatro estadísticos de renombre mundial en la Universidad de Stanford y la Universidad de California en Berkeley. El motor de modelado CART, la implementación de árboles de clasificación y regresión de Minitab, es el único software de árboles de decisión que incorpora el código patentado original.

Rápido y Versátil

Las extensiones patentadas del motor de modelado CART se diseñaron específicamente para mejorar los resultados de la investigación y el análisis de mercado, respaldar la implementación de alta velocidad y predecir y puntuar en tiempo real. A lo largo de los años, nuestro motor se ha convertido en uno de los algoritmos de modelado predictivo disponibles más populares y fáciles de usar, y es fundamental para muchos enfoques modernos de minería de datos basados en bagging y boosting.

Random Forests®Los bosques aleatorios de Breiman y Cutler |

|

Basado en una colección de árboles de clasificación y regresión (CART®), el motor de modelado Random Forests® suma las predicciones hechas de cada árbol CART para determinar la predicción general del bosque, al tiempo que garantiza que los árboles de decisión no se vean influenciados entre sí.

Para aquellos nuevos en Random Forests, es una potente técnica de conjunto desarrollada por Leo Breiman y Adele Cutler en la Universidad de California, Berkeley, y es favorecida por muchos practicantes de modelos predictivos. La simplicidad engañosa del algoritmo construye cientos de árboles independientes y emplea mucho muestreo de observaciones y variables.

La capacidad única de Random Forests para evaluar el rendimiento imparcial del modelo en función de los datos listos para usar elimina la necesidad de tener una muestra de prueba/validación separada. Esto posiciona inmediatamente a Random Forests como la mejor herramienta de modelado predictivo en las amplias aplicaciones de datos donde la cantidad de variables excede, a menudo muchas veces, la cantidad de observaciones disponibles.

Responsabilidad

Random Forests tiene una capacidad única para aprovechar cada registro en su conjunto de datos sin los peligros del sobreajuste. Esto es especialmente importante para conjuntos de datos pequeños (en términos de observaciones), donde cada registro puede aportar algo valioso. Random Forests se asegurará de que todos los registros se hayan tenido en cuenta en sus modelos y que no se haya perdido ninguna información.

Importancia variable robusta

Random Forests utiliza técnicas novedosas para clasificar los predictores según su importancia. Esto es conveniente cuando los datos incluyen miles, decenas o incluso cientos de miles de variables o predictores, lo que está más allá del alcance de las herramientas de regresión y clasificación convencionales. Random Forest puede manejar situaciones tan extremas e informar qué variables usar en la investigación de seguimiento. Múltiples rondas de muestreo agregarán solidez y calidad a estos conocimientos.

TreeNet®Aumento de gradiente |

|

La herramienta de aprendizaje automático más flexible, galardonada y potente de Minitab, TreeNet® Gradient Boosting, es capaz de generar modelos extremadamente precisos de manera consistente.

Para aquellos que son nuevos en TreeNet, es una potente implementación de la moderna clase de algoritmos de aprendizaje automático generalmente conocida como Stochastic Gradient Boosting. Desarrollada por Jerome Friedman en la Universidad de Stanford, la técnica es conocida por su excelente precisión predictiva. El secreto está en la forma en que se construye un modelo: en cada iteración se agrega un pequeño árbol al conjunto actual de árboles para corregir los errores combinados del conjunto.

Utilizando la variedad de funciones de pérdida suministradas, el proceso puede ajustarse para la tarea específica de modelado predictivo, como regresión de mínimos cuadrados, regresión robusta, clasificación, etc. Para ayudar con la interpretación del modelo, TreeNet va un paso más allá y genera automáticamente varios 2D y gráficos 3D para explicar la naturaleza de la dependencia de la variable de respuesta en las entradas del modelo. El modelo es lo suficientemente flexible para descubrir e incorporar automáticamente varias no linealidades e interacciones multidireccionales. Un conjunto adicional de controles permite al usuario ajustar las interacciones del modelo para cumplir con los objetivos de diseño específicos.

Precisión incomparable

Nuestro motor de modelado TreeNet tiene un grado de precisión generalmente inalcanzable por un solo modelo o conjuntos, como embolsado o refuerzo convencional. Nuestra metodología no es sensible a los errores de datos y no requiere preparación de datos, preprocesamiento o imputación de valores faltantes que consumen mucho tiempo. Con otros métodos, los errores de datos pueden ser un desafío para la minería de datos convencional y catastróficos para el impulso convencional. Por el contrario, el modelo TreeNet es inmune a tales errores, ya que rechaza dinámicamente los datos que difieren demasiado del modelo existente o que están contaminados con etiquetas objetivo erróneas.

Perspectivas ilustradas

Evite las técnicas convencionales de prueba y error o caminar en la oscuridad en el futuro. Nuestro motor de modelado TreeNet ofrece un conjunto único de información sobre el funcionamiento interno de sus modelos con gráficos de dependencia. Nuestras gráficas de dependencia parcial en 2D muestran la naturaleza de los efectos principales, mientras que nuestras gráficas de dependencia parcial en 3D también incluyen interacciones bidireccionales. Armado con los nuevos conocimientos descubiertos automáticamente por TreeNet, podrá crear modelos de regresión y clasificación de alta precisión si es necesario.

Detección de interacción

La detección de interacciones dentro de nuestro motor de modelado TreeNet establece si se necesitan interacciones de algún tipo en un modelo predictivo. Este sistema no solo ayuda a mejorar el rendimiento del modelo, a menudo de forma espectacular, sino que también ayuda a descubrir y utilizar nuevos conocimientos valiosos.

MARS®Splines de regresión adaptativa multivariable |

|

El motor de modelado MARS® es ideal para los usuarios que prefieren los resultados en una forma similar a la regresión tradicional, pero sin dejar de detectar las no linealidades y las interacciones esenciales.

El enfoque de modelado de regresión de la metodología MARS revela de manera efectiva patrones y relaciones importantes en los datos que son difíciles, si no imposible, de revelar para otros métodos de regresión. El motor de modelado MARS construye su modelo juntando una serie de líneas rectas, donde cada una puede tener su propia pendiente. Esto permite que el motor de modelado MARS trace cualquier patrón detectado en los datos.

Regresión y clasificación de alta calidad

El modelo MARS está diseñado para predecir resultados numéricos, como la factura mensual promedio de un cliente de telefonía móvil o la cantidad que se espera que un comprador gaste en una visita a un sitio web. El motor MARS también es capaz de producir modelos de clasificación de alta calidad para un resultado sí/no. El motor MARS realiza selección de variables, transformación de variables, detección de interacciones y autoevaluaciones, todo de manera automática y a gran velocidad.

Resultados de alto rendimiento

Las áreas en las que el motor MARS ha exhibido resultados de muy alto rendimiento incluyen la predicción de la demanda de electricidad para empresas generadoras de energía, la asociación de las puntuaciones de satisfacción de los clientes con las especificaciones técnicas de los productos y el modelado de presencia/ausencia en los sistemas de información geográfica (SIG).

- Detalles

- Categoría: Maple

- Visto: 5242