- Detalles

- Categoría: Maple

- Visto: 1849

Por Austin Roche.

VerifyTools es un paquete que ha estado disponible en Maple durante aproximadamente 24 años, pero hasta ahora nunca se había documentado, ya que originalmente estaba destinado solo para uso interno. La documentación correspondiente se incluirá en la próxima versión de Maple. Aquí presentamos una vista previa:

VerifyTools es similar al paquete TypeTools. Un tipo es esencialmente un predicado que una sola expresión puede satisfacer o no. Análogamente, una verificación es un predicado que se aplica a un par de expresiones, comparándolas. Así como los tipos se pueden combinar para producir tipos compuestos, las verificaciones también se pueden combinar para producir verificaciones compuestas. Se pueden crear, recuperar, consultar o eliminar nuevos tipos utilizando los comandos AddType, GetType (o GetTypes), Exists y RemoveType, respectivamente. De manera similar, en el paquete VerifyTools podemos crear, recuperar, consultar o eliminar verificaciones utilizando AddVerification, GetVerification (o GetVerifications), Exists y RemoveVerification.

El comando de paquete VerifyTools:-Verify también está disponible como el comando de nivel superior de Maple, el cual ya debería ser familiar para los usuarios expertos de Maple. De manera similar, el comando VerifyTools:-IsVerification también está disponible como un tipo, es decir,

VerifyTools:-IsVerification(ver);

devolverá lo mismo que

type(ver, 'verificación');

Los siguientes ejemplos muestran lo que se puede hacer con estos comandos. Tenga en cuenta que en cada ejemplo en el que se utiliza el comando Verify, es equivalente al comando de nivel superior de Maple, verify. (Tenga en cuenta también que los comandos de VerifyTools que se muestran a continuación serán ligeramente diferentes en comparación con la versión Maple2024):

> with(VerifyTools):

Supongamos que queremos crear una verificación que compruebe que la longitud de un resultado no ha aumentado en comparación con el resultado esperado. Podemos hacerlo mediante el comando AddVerification:

> AddVerification(length_not_increased, (a, b) -> evalb(length(a) <= length(b)));

Primero, podemos comprobar la existencia de nuestra nueva verificación y obtener su valor:

> Exists(length_not_increased);

true

> GetVerification(length_not_increased);

(a, b) → evalb(length(a) ≤ length(b))

Para las verificaciones con nombre, IsVerification es equivalente a Exists (ya que los nombres solo se reconocen como verificaciones si existe una entrada para ellos en la base de datos de verificación):

> IsVerification(length_not_increased);

true

Por otra parte, una verificación estructurada no trivial se puede comprobar con IsVerification,

> IsVerification(boolean = length_not_increased);

true

Mientras que Exists solo acepta nombres:

> Exists(boolean = length_not_increased);

Error, invalid input: VerifyTools:-Exists expects its 1st argument, x, to be of type symbol, but received boolean = length_not_increased

El comando anterior que utiliza Exists también es equivalente a la siguiente llamada de tipo:

> type(boolean = length_not_increased, verification);

true

Ahora usemos la nueva verificación:

> Verify(x + 1/x, (x^2 + 1)/x, length_not_increased);

true

> Verify((x^2 + 1)/x, x + 1/x, length_not_increased);

false

Por último, eliminemos la verificación:

> RemoveVerification(length_not_increased);

> Exists(length_not_increased);

false

> GetVerification(length_not_increased);

Error, (in VerifyTools:-GetVerification) length_not_increased is not a recognized verification

GetVerifications devuelve la lista de todas las verificaciones conocidas por el sistema:

> GetVerifications();

[Array, FAIL, FrobeniusGroupId, Global, Matrix, MultiSet, PermGroup, RootOf, SmallGroupId, Vector, address, after, approx, array, as_list, as_multiset, as_set, attributes, boolean, box, cbox, curve, curves, dataframe, dataseries, default, default, dummyvariable, equal, evala, evalc, expand, false, float, function, function_bounds, function_curve, function_shells, greater_equal, greater_than, in_convex_polygon, indef_int, interval, less_equal, less_than, list, listlist, matrix, member, multiset, neighborhood, neighbourhood, normal, permute_elements, plot, plot3d, plot_distance, plotthing_compile_result, polynom, procedure, ptbox, range, rational, record, relation, reverse, rifset, rifsimp, rtable, set, sign, simplify, sublist, `subset`, subtype, superlist, superset, supertype, symbol, table, table_indices, testeq, text, true, truefalse, type, undefined, units, vector, verifyfunc, wildcard, xmltree, xvm]

- Detalles

- Categoría: Minitab

- Visto: 1361

Por Stacey McDaniel.

El panorama de la atención médica está evolucionando a un ritmo sin precedentes, impulsado en gran medida por la transformación digital que se está produciendo en toda la industria. En esta era digital, la capacidad de aprovechar conjuntos de datos complejos a través de herramientas sofisticadas como Minitab no es solo una ventaja, sino una necesidad para las organizaciones de atención médica que buscan revolucionar la atención al paciente, agilizar las operaciones y mejorar la eficiencia de los costes. Esta publicación profundiza en el impacto multifacético del análisis de datos en la atención médica y demuestra las formas en que Minitab puede ayudar a abordar esta transformación.

EL IMPACTO DEL ANÁLISIS DE DATOS EN LOS RESULTADOS DE LOS PACIENTES

La misión principal de la atención sanitaria es brindar una atención centrada en el paciente que conduzca a resultados óptimos. El análisis de datos desempeña un papel crucial para lograr este objetivo. Al analizar grandes cantidades de datos de pacientes, los proveedores de atención sanitaria ahora pueden predecir patrones de enfermedades, lo que permite intervenciones tempranas y planes de atención personalizados. Este enfoque proactivo no solo mejora los resultados de los pacientes, sino que también reduce significativamente la carga sobre los sistemas de atención sanitaria al evitar que las enfermedades alcancen etapas agudas. Además, la integración de análisis en los registros médicos electrónicos (EHR) ofrece a los médicos información en tiempo real y pautas basadas en evidencia, lo que respalda la toma de decisiones clínicas superiores en el punto de atención.

OPTIMIZACIÓN DE LAS OPERACIONES PARA UNA MEJOR PRESTACIÓN DE SERVICIOS DE SALUD

La eficiencia operativa es fundamental para el éxito de cualquier organización de atención médica. El análisis de datos ofrece una vía para optimizar la asignación de recursos, reducir los tiempos de espera y mejorar la gestión del flujo de trabajo. Al analizar el flujo de pacientes, los niveles de personal y la utilización de recursos, los centros de atención médica pueden identificar cuellos de botella e ineficiencias, allanando el camino para un sistema de prestación de atención al paciente más fluido y eficiente. Esto no solo mejora la experiencia del paciente, sino que también contribuye a una reducción significativa de los costos operativos, lo que hace que la atención médica sea más accesible y asequible.

TRATAMIENTOS PERSONALIZADOS A TRAVÉS DE LA MEDICINA PERSONALIZADA

La era de la medicina de talla única está llegando a su fin y está dando paso a planes de tratamiento personalizados y adaptados a los perfiles de cada paciente. El análisis de datos, con su capacidad para procesar e interpretar conjuntos de datos complejos, es el núcleo de este cambio transformador. Al aprovechar los datos de los pacientes, incluida la información genética, los factores de estilo de vida y el historial médico, los proveedores de atención médica pueden diseñar estrategias de tratamiento altamente personalizadas. Este nivel de personalización garantiza que los pacientes reciban los tratamientos más eficaces, lo que mejora la eficacia de las intervenciones de atención médica y la satisfacción del paciente.

DETECCIÓN DE FRAUDES Y GARANTÍA DEL CUMPLIMIENTO NORMATIVO EN EL ÁMBITO SANITARIO

Las actividades fraudulentas y el incumplimiento de las normas reglamentarias plantean importantes desafíos para la industria de la atención médica. El análisis de datos es una herramienta poderosa para identificar irregularidades en los datos de facturación, mitigando así el riesgo de fraude en la atención médica. Además, el análisis puede agilizar el proceso de cumplimiento al garantizar la precisión de los informes y el cumplimiento de las normas de privacidad de datos. Al protegerse contra el fraude y garantizar el cumplimiento de las normas, las organizaciones de atención médica pueden proteger a sus pacientes y a sí mismas de posibles repercusiones legales y financieras.

UTILIZACIÓN DEL ANÁLISIS PREDICTIVO PARA UNA GESTIÓN EFICAZ DE RIESGOS

El análisis predictivo, un subconjunto del análisis de datos, tiene un inmenso potencial para transformar la gestión de riesgos de la atención médica. Al analizar patrones y tendencias dentro de los datos de atención médica, las organizaciones pueden predecir reingresos de pacientes, identificar pacientes de alto riesgo e intervenir antes de que las condiciones empeoren. Esto no solo mejora los resultados de los pacientes, sino que también optimiza la asignación de recursos de atención médica. Además, el análisis predictivo puede ayudar a gestionar enfermedades crónicas de manera más eficaz, reduciendo la carga general de atención médica.

IMPULSAR LA PARTICIPACIÓN Y LA SATISFACCIÓN DE LOS PACIENTES MEDIANTE EL ANÁLISIS DE DATOS

En el entorno sanitario actual, la participación y la satisfacción de los pacientes son fundamentales. El análisis de datos ofrece información valiosa sobre las preferencias, los comportamientos y los comentarios de los pacientes, lo que permite a las organizaciones sanitarias adaptar sus servicios y estrategias de comunicación en consecuencia. Al analizar los datos sobre la experiencia de los pacientes, los proveedores de atención sanitaria pueden identificar áreas de mejora, mejorar los programas de educación de los pacientes y, en última instancia, fomentar una base de pacientes más comprometida y satisfecha.

La integración del análisis de datos en las operaciones de atención médica y los procesos de toma de decisiones está revolucionando la industria. Socios como Minitab pueden ayudar a las organizaciones a analizar conjuntos de datos complejos y obtener información útil. Al adoptar el análisis de datos, las organizaciones de atención médica pueden lograr mejores resultados para los pacientes, mayor eficiencia operativa y rentabilidad, todo ello mientras abordan las complejidades de la prestación de servicios de atención médica modernos. El futuro de la atención médica está impulsado por los datos y el momento de aprovechar el análisis de datos es ahora.

- Detalles

- Categoría: Twinn Witness

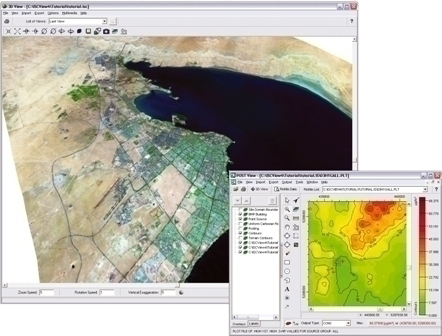

- Visto: 2074

Nos complace anunciar que Witness 27 ya está disponible para su descarga para todos los clientes con una licencia de Witness mantenida.

Witness 27 continúa concentrándose en la facilidad de uso, para que la creación, interacción y actualización de modelos sea más rápida que nunca. Algunas de las nuevas características incluyen:

- Capacidades de depuración mejoradas

- Nueva funcionalidad para registrar viajes, creando más opciones de informes

- Nueva personalización para las visualizaciones de tuberías, que mejora aún más las mejores capacidades de modelado de fluidos de su clase que se encuentran en Witness

Puede obtener una vista previa del lanzamiento en el video a continuación y acceder a la descarga en el portal de atención al cliente.

Como recordatorio, el portal myLanner se ha mudado. Se puede acceder a las descargas, recursos y soporte de Witness a través de la plataforma de usuario Smart Society de Royal HaskoningDHV. Si aún no tiene una cuenta o necesita ayuda para iniciar sesión, comuníquese con Lanner en Lanner.Witness@rhdhv.com.

- Detalles

- Categoría: Comsol

- Visto: 1595

En esta entrada del blog de COMSOL, el blogger invitado René Christensen de Acculution ApS analiza la función de ajuste de fracciones parciales que se incluyó en la versión COMSOL Multiphysics 6.2.

En la versión 6.2 de COMSOL Multiphysics®, hay una nueva función de ajuste de fracciones parciales. Esta funcionalidad analiza una función de la frecuencia de valor complejo dada a través de sus partes reales e imaginarias. El resultado es una suma de varias fracciones que se ajustan a la función y describen el sistema de una manera muy compacta en el rango de frecuencia en cuestión. Las fracciones se conocen como fracciones parciales y juntas forman una función de transferencia numérica, que es relevante para obtener información sobre el funcionamiento interno del sistema subyacente y también permite una fácil transformación al dominio del tiempo. Las partes reales e imaginarias de los valores de entrada generalmente provienen de simulaciones a priori , pero también pueden ser valores importados de otro software o incluso de otras mediciones.

Tabla de contenido

Este es el listado de lo que podrá encontrar en esa entrada del blog

- Transformación de tiempo a frecuencia

- Funciones de transferencia

- Descomposición en fracciones parciales

- Ajuste de fracciones parciales

- Polos reales

- Polos complejos

- Polos repetitivos

- Polos inestables

- Función de transferencia no racional: retardo temporal

- Función de transferencia no racional: microacústica

- Simetría conjugada, frecuencias negativas

- Reflexiones finales

- Detalles

- Categoría: NAG

- Visto: 1697

Los algoritmos numéricos y estadísticos de NAG funcionan con mucho lenguajes y entornos

Para una transición perfecta del prototipo a la producción.

La Librería NAG está diseñada para ser la biblioteca de algoritmos numéricos y estadísticos más flexible disponible. Incluso incluye documentación interactiva y permite cambiar de lenguaje fácilmente.

La visión de NAG es que todas las empresas puedan sacar el máximo partido a sus modelos y sistemas computacionales. Por eso, los expertos de NAG están siempre a su disposición para ofrecerle asesoramiento y hablarle sobre la mejor forma de utilizar la Librería de NAG.

- Detalles

- Categoría: Lakes

- Visto: 1512

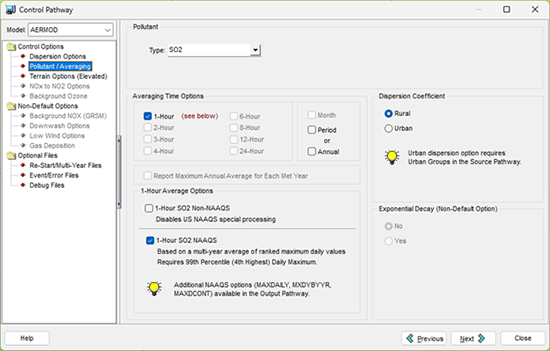

En 2010, la Agencia de Protección Ambiental de los Estados Unidos (US EPA) revisó las Normas Nacionales de Calidad del Aire Ambiental (NAAQS) para el dióxido de nitrógeno (NO2) y el dióxido de azufre (SO2) a corto plazo. Debido a las formas únicas de estas normas, que se basan en distribuciones anuales de concentraciones máximas diarias por hora en lugar de la distribución de todos los valores por hora, el modelo de dispersión del aire AERMOD tuvo que actualizarse para realizar los cálculos correspondientes.

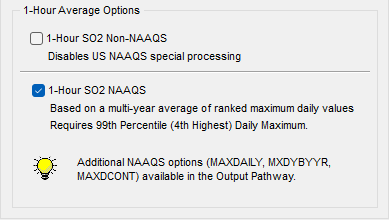

Casi 15 años después, AERMOD sigue utilizando métodos de cálculo NAAQS y no_NAAQS. Sin embargo, comprender cómo emplear estos métodos de cálculo tan diferentes puede generar confusión. AERMOD View de Lakes Environmental reduce la confusión del modelador al presentar claramente las opciones de promedio de 1 hora del modelo.

En la configuración de la ruta de control (Control Pathway) de AERMOD View, los modeladores encontrarán las opciones Pollutant/Averaging (Contaminante/Promedio). Este es uno de los controles principales de un proyecto AERMOD, ya que las selecciones que se realicen aquí determinarán los métodos de cálculo empleados en el código de AERMOD.

Visualización Pollutant/Averaging de AERMOD View

Cuando se habilita la siguiente configuración, AERMOD automáticamente habilitará las rutinas de procesado especiales NAAQS:

- Tipo de contaminante (Pollutant Type): Establezca en NO2 o SO2

- Tiempo promedio (Averaging Time): La opción de 1 hora es el único periodo promedio de corto plazo seleccionable

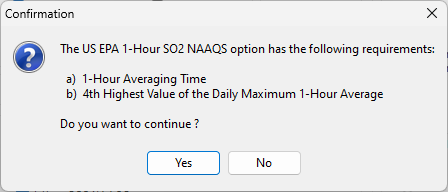

Lakes Environmental incluyó las opciones de promedio de 1 hora para aclarar qué modo utilizará AERMOD. Los usuarios que deseen continuar con su proyecto para calcular los NAAQS de NO2 o SO2 de 1 hora deben seleccionar la casilla de verificación 1-Hour NO2/SO2 NAAQS. Aparecerá un cuadro de diálogo de confirmación adicional para confirmar la selección.

Para los modeladores que desean calcular los impactos horarios de NO2 o SO2 por separado de esta evaluación NAAQS, la selección 1-Hour NO2/SO2 Non-NAAQS deshabilitará las rutinas de procesamiento de US NAAQS.

Diferencias en las salidas:

Seleccionar el período de promedio adecuado es fundamental porque los resultados de estos métodos pueden ser muy diferentes.

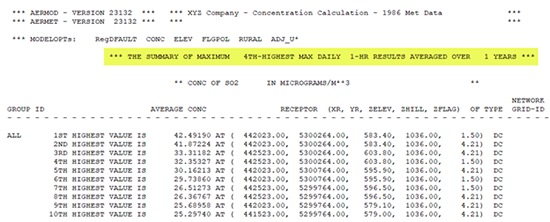

Con el procesamiento de NAAQS habilitado, el modelo rastrea el promedio máximo diario de 1 hora para cada valor alto deseado y promedia esos valores a lo largo de la cantidad de años que se procesan. Las tablas de salida en el archivo de salida de AERMOD informarán los resultados como “The Summary of Maximum nth Highest Max Daily 1-HR Results Averaged Over y Years”, donde n es el valor alto especificado por el usuario (normalmente el 4º más alto para SO2 y el 8º más alto para NO2) e y es la cantidad de años procesados en la ejecución del modelo.

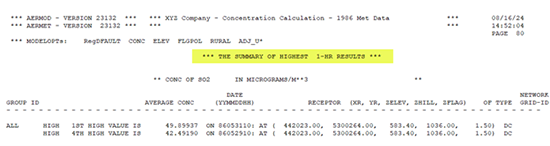

Cuando el procesamiento no NAAQS está habilitad, los resultados se informan como “The Summary of Highest 1-HR Results” sin promedios realizados a lo largo de varios años y sin una distribución diaria máxima realizada por el modelo.

- Detalles

- Categoría: Minitab

- Visto: 1366

Por Shawn Shapiro.

En la industria de producción de alimentos, es fundamental mantener los más altos estándares de seguridad y calidad. Una de las amenazas más temidas para la seguridad alimentaria es la bacteria Listeria monocytogenes, que puede provocar enfermedades graves e incluso la muerte. Un brote de Listeria puede tener consecuencias devastadoras tanto para los consumidores como para las empresas, incluidas retiradas costosas de productos del mercado, daños a la reputación y graves repercusiones legales. Entonces, ¿cómo pueden las empresas asegurarse de que están haciendo todo lo posible para evitar tales brotes? Entra en escena Minitab Statistical Software.

ENTENDIENDO LA AMENAZA DE LISTERIA

La Listeria monocytogenes es una bacteria resistente que puede proliferar en ambientes fríos, lo que la hace especialmente peligrosa en los alimentos refrigerados. Se encuentra a menudo en la carne cruda, los productos lácteos no pasteurizados y los alimentos listos para consumir, como los embutidos y los quesos blandos. Debido a su capacidad para crecer a bajas temperaturas y resistir diversas técnicas de conservación de alimentos, Listeria requiere medidas de control y seguimiento diligentes durante todo el proceso de producción de alimentos.

CÓMO AYUDA MINITAB A PREVENIR LOS BROTES DE LISTERIA

Minitab es una potente herramienta de análisis estadístico que puede ayudar a las empresas productoras de alimentos a identificar posibles peligros, monitorizar puntos críticos de control e implementar medidas correctivas para prevenir la contaminación por Listeria. A continuación, se muestra cómo Minitab puede cambiar las reglas del juego para mantener la seguridad alimentaria:

- Análisis de riesgos basado en datos

Antes de que una empresa pueda controlar la Listeria, primero debe identificar dónde y cómo podría ingresar al proceso de producción. Con Minitab, las empresas pueden realizar un análisis de riesgos integral, analizando datos pasados para identificar patrones o tendencias que podrían indicar puntos de riesgo de contaminación. Esto permite a las empresas concentrar sus recursos en áreas de alto riesgo e implementar medidas preventivas de manera más eficaz. - Monitorización y control en tiempo real

Uno de los componentes clave de cualquier plan de seguridad alimentaria es la monitorización de los puntos críticos de control (PCC). Se trata de etapas del proceso de producción en las que se puede aplicar un control para prevenir o eliminar un riesgo para la seguridad alimentaria. Las capacidades de creación de gráficos de control de Minitab permiten a las empresas monitorizar los PCC en tiempo real, lo que garantiza que cualquier desviación de la norma se identifique y corrija rápidamente. Esta monitorización en tiempo real es crucial para evitar que los pequeños problemas se conviertan en problemas a gran escala. - Optimización de procesos mediante Six Sigma

Muchas empresas de producción de alimentos utilizan metodologías Six Sigma para mejorar sus procesos, reducir la variabilidad y mejorar la calidad. Minitab es una herramienta esencial para los profesionales de Six Sigma, ya que ofrece una gama de herramientas estadísticas que ayudan a optimizar los procesos. Al reducir la variabilidad en los procesos de producción, las empresas pueden minimizar las posibilidades de contaminación por Listeria, lo que garantiza que todos los productos cumplan con los mismos altos estándares de seguridad y calidad. - Análisis de causa raíz

Si se detecta contaminación, es fundamental identificar y eliminar rápidamente la fuente. Las herramientas de análisis de causa raíz de Minitab, como los diagramas de Pareto y de espina de pescado, pueden ayudar a las empresas a identificar la causa exacta de la contaminación. Esto permite tomar medidas correctivas específicas, lo que garantiza que no surjan problemas similares en el futuro. - Análisis predictivo para la prevención proactiva

Además de las medidas reactivas, Minitab también permite el análisis predictivo, lo que ayuda a las empresas a anticipar los riesgos potenciales antes de que se conviertan en problemas. Al analizar las tendencias y correlaciones de los datos, Minitab puede pronosticar dónde y cuándo es más probable que se produzcan brotes de Listeria, lo que permite a las empresas tomar medidas proactivas para prevenirlos. - Cumplimiento y presentación de informes

Las normas de seguridad alimentaria exigen documentación y elaboración de informes rigurosos. Minitab simplifica este proceso al proporcionar plantillas fáciles de usar e informes personalizables que garantizan el cumplimiento de todas las normas y regulaciones pertinentes. Esto no solo ayuda a mantener la seguridad alimentaria, sino también a demostrar la debida diligencia a los reguladores y las partes interesadas.

La amenaza de la Listeria en el proceso de producción de alimentos es real y potencialmente devastadora, pero no tiene por qué causar histeria. Al aprovechar el poder de Minitab, las empresas pueden implementar estrategias sólidas basadas en datos para prevenir la contaminación, garantizar el cumplimiento y mantener los más altos estándares de seguridad alimentaria. Por lo tanto, no permita que la Listeria lo mantenga despierto por las noches: use Minitab para mantener su proceso.