- Detalles

- Categoría: Minitab

- Visto: 1625

Por Joshua Zable.

Por qué Minitab Workspace es un sustituto superior a Visio para los usuarios de herramientas de mejora continua, herramientas Lean Six Sigma, herramientas de mejora de procesos y herramientas de mejora de la calidad.

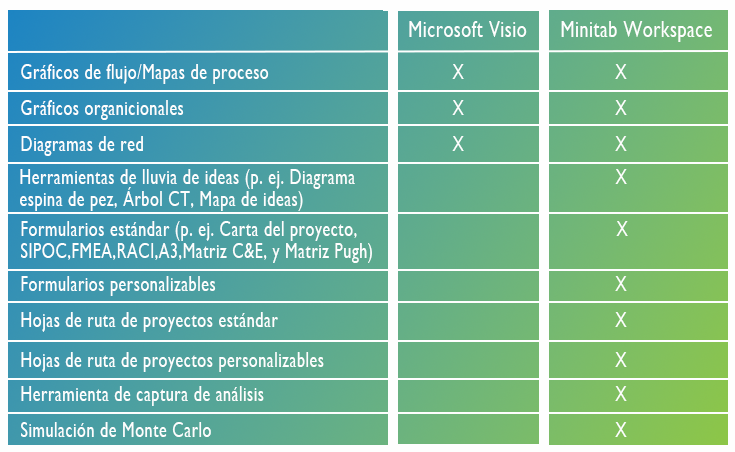

Muchos clientes nos dicen lo mucho que les gusta Minitab Workspace, pero se enfrentan a la resistencia de los directores de TI, que cuestionan esa necesidad al tener acceso a Visio. Si bien es cierto que muchos usuarios de Microsoft 365 tienen acceso a Visio y que existe cierta superposición entre los productos, tienen aplicaciones muy diferentes.

Microsoft posiciona Visio como una herramienta versátil para “crear diagramas profesionales en cualquier momento”. Si bien puede generar varios diagramas, diagramas de flujo y organigramas, no está diseñado específicamente para la mejora continua o el análisis de datos. Por otro lado, Minitab Workspace está diseñado específicamente para profesionales orientados a los datos que necesitan visualizar, analizar y mejorar los procesos de negocios.

Ambos productos son fáciles de usar y están bien considerados. Minitab Workspace tiene calificaciones ligeramente más altas en Capterra y, si bien se lo considera una de las mejores plataformas de colaboración en G2, ambos cuentan con las mismas calificaciones generales altas.

¿Qué diferencia a Minitab Workspace de Visio?

Al igual que Visio, Minitab Workspace permite a los usuarios crear una variedad de herramientas, desde diagramas de flujo y mapas de procesos hasta diagramas de carriles y mapas de flujo de valor. Si bien estos son una parte esencial del conjunto de herramientas de mejora de procesos, no ofrecen la historia completa. Workspace permite a los clientes ejecutar proyectos Y proporciona herramientas adicionales para permitir la ejecución y el análisis. Vea las diferencias en el siguiente gráfico:

Herramientas de lluvia de ideas -> Minitab Workspace ofrece herramientas de lluvia de ideas como mapas mentales, 4S, 8P, diagramas de espina de pescado (o diagramas de causa y efecto), materiales hombre-máquina, mapas de ideas y árboles CT.

Formularios estándar y personalizables -> Con una gran cantidad de formularios, Minitab Workspace ofrece una biblioteca sólida de formularios personalizables y con formato condicional. La lista incluye un FMEA (análisis de modos de falla y efectos) estándar, un plan de acción 30-60-90, una matriz C&E (matriz de causa y efecto), una matriz Pugh, un modelo de Kano, una matriz de impacto versus esfuerzo y muchos más. Además, Minitab Workspace le permite crear herramientas y formularios personalizados que se pueden compartir en toda su organización, lo que mejora su versatilidad y facilidad de uso.

Hojas de ruta de proyectos estándar y personalizables -> Minitab Workspace ofrece una gama completa de hojas de ruta de proyectos de mejora continua, incluidas las hojas de ruta DMAIC (Definir-Medir-Analizar-Mejorar-Controlar), CDOV (Concepto-Diseño-Optimizar-Verificar), QFD (Implementación funcional de calidad), Kaizen Event, PDCA (Planificar-Hacer-Verificar-Actuar) y Simplemente hágalo. Minitab Workspace le permite personalizar las hojas de ruta de proyectos utilizando cualquier plantilla que desee, lo que garantiza una ejecución del proyecto consistente y exitosa.

Simulación de Monte Carlo -> Minitab Workspace permite que incluso los principiantes creen una simulación de Monte Carlo en tan solo cuatro sencillos pasos . El uso de esta herramienta puede ayudar a tener en cuenta el riesgo en el análisis cuantitativo y la toma de decisiones, lo que le permite explorar el comportamiento del sistema de forma más rápida, económica y, posiblemente, incluso más segura.

Minitab Workspace admite la resolución analítica de problemas

Mientras que el objetivo de Visio es permitir la creación de diagramas de forma rápida y sencilla , el objetivo de Minitab Workspace es utilizar los diagramas para resolver problemas . Existe una diferencia significativa entre simplemente organizar los datos y aplicarlos para abordar desafíos. Por ejemplo, tanto Visio como Workspace ofrecen la función de mapeo de flujo de valor. Sin embargo, los números de Visio son cadenas de texto y, por lo tanto, no se pueden utilizar para cálculos clave, mientras que Workspace puede reconocer datos y calcular automáticamente métricas de rendimiento clave. Mientras que Visio le ofrece una bonita visualización de su flujo de valor, Workspace ofrece la posibilidad de realizar ajustes para realizar mejoras, además de un diagrama similar.

Minitab Workspace también ofrece herramientas de captura de análisis diseñadas específicamente para usuarios de Minitab Statistical Software que ayudan a guiar, resumir y presentar análisis estadísticos. Esto demuestra aún más cómo Minitab Workspace está diseñado como una herramienta versátil de resolución de problemas que complementa la toma de decisiones basada en datos.

¿Diagramas o resolución de problemas? Ambos

Microsoft Visio y Minitab Workspace son soluciones intuitivas y asequibles. Si solo se centra en los diagramas de flujo, Visio es intuitivo y probablemente sea de fácil acceso a través de su licencia de Microsoft 365. Si está utilizando el poder de los diagramas para llegar a las causas fundamentales y resolver problemas, Minitab Workspace es una herramienta mucho más potente. ¡Que disfrute creando diagramas!

- Detalles

- Categoría: Maple

- Visto: 1541

Si su propósito para este año es mejorar sus habilidades de programación en Maple, entonces eche un vistazo a este taller grabado de la Conferencia de Maple que le muestra formas prácticas de mejorar tsu uso del código Maple y las técnicas para depurar sus scripts.

- Detalles

- Categoría: Comsol

- Visto: 1817

Una de las grandes herramientas que COMSOL Multiphysics® pone a nuestra disposición es la posibilidad de realizar estudios paramétricos (“parametric sweep”) y analizar cómo afecta el cambio de una o más variable al resto de parámetros de nuestro modelo. Sin embargo, es habitual trabajar con modelos complejos en los que hay varias físicas acopladas, lo que se traduce en tiempos de simulación prolongados.

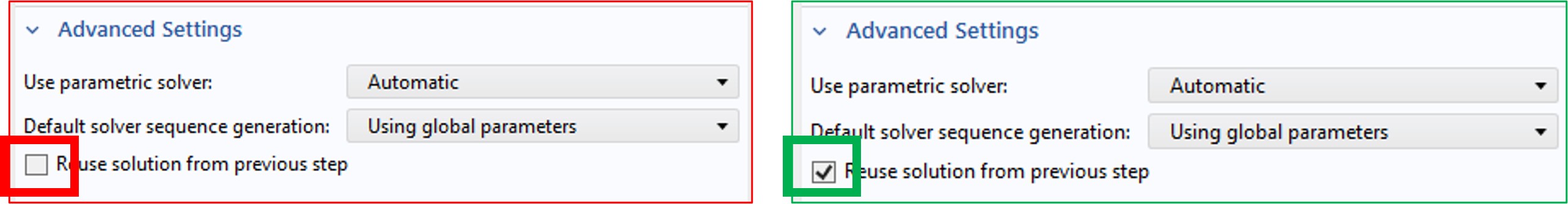

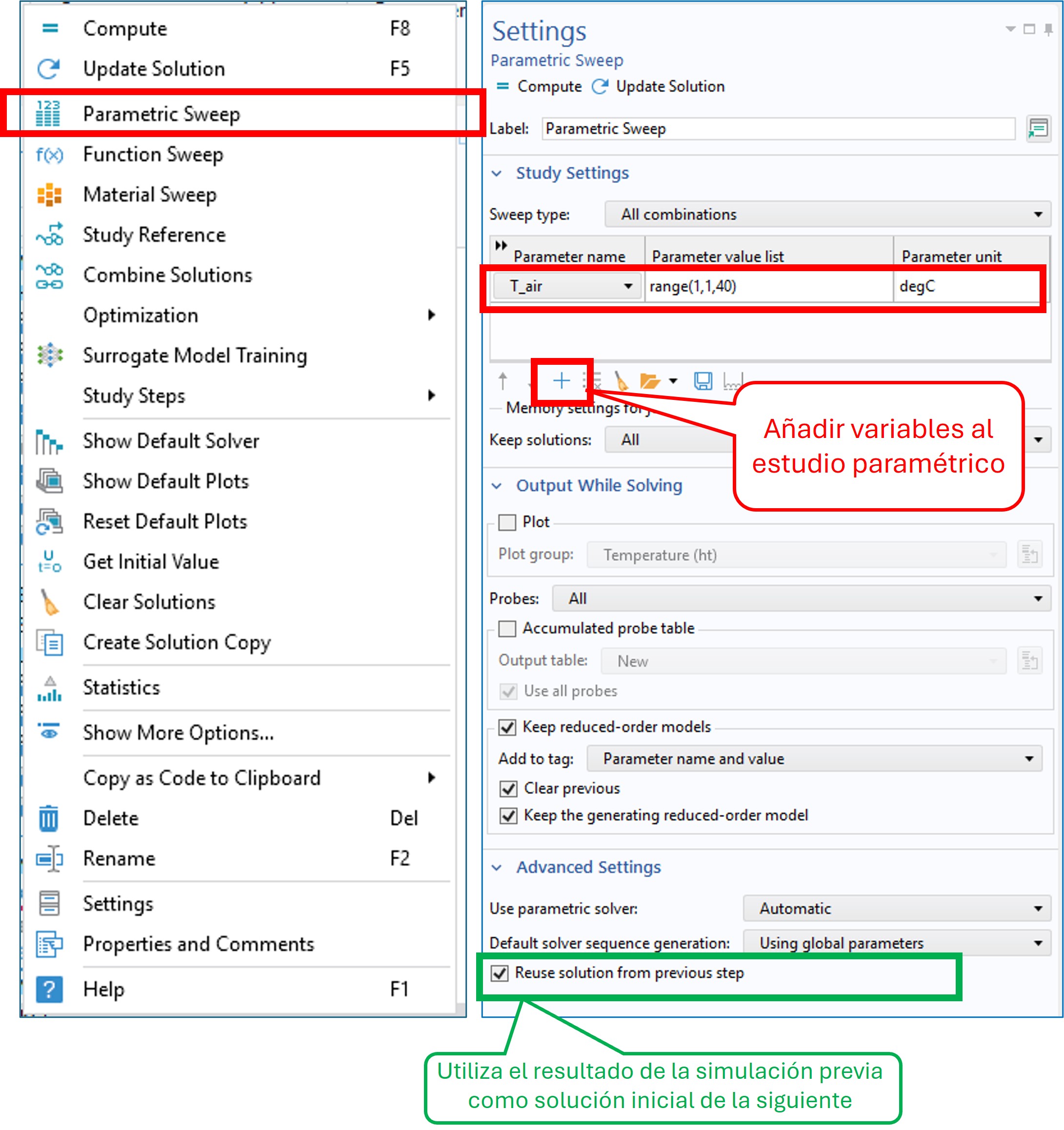

Pues bien, ¿sabía que puede reducir drásticamente el tiempo de tus estudios paramétricos en COMSOL Multiphysics®? Solo necesita activar la opción "Reuse Solution" como se muestra en la Figura 1.

Figura 1. Distintas funciones disponibles en COMSOL Multiphysics® en el nodo de “Study” y configuración del estudio paramétrico (parametric sweep).

¿Cómo funciona?

Cuando realiza un estudio paramétrico, por defecto, COMSOL suele resolver cada caso desde cero. Pero si activa la opción “Reuse Solution”, el programa utilizará la solución del caso anterior como condición inicial para el siguiente paso. Esto mejora la velocidad de convergencia sin perder precisión en los resultados de la simulación numérica, especialmente en modelos no lineales y resulta de gran utilidad en análisis transitorios con pequeños cambios entre parámetros.

Ejemplo

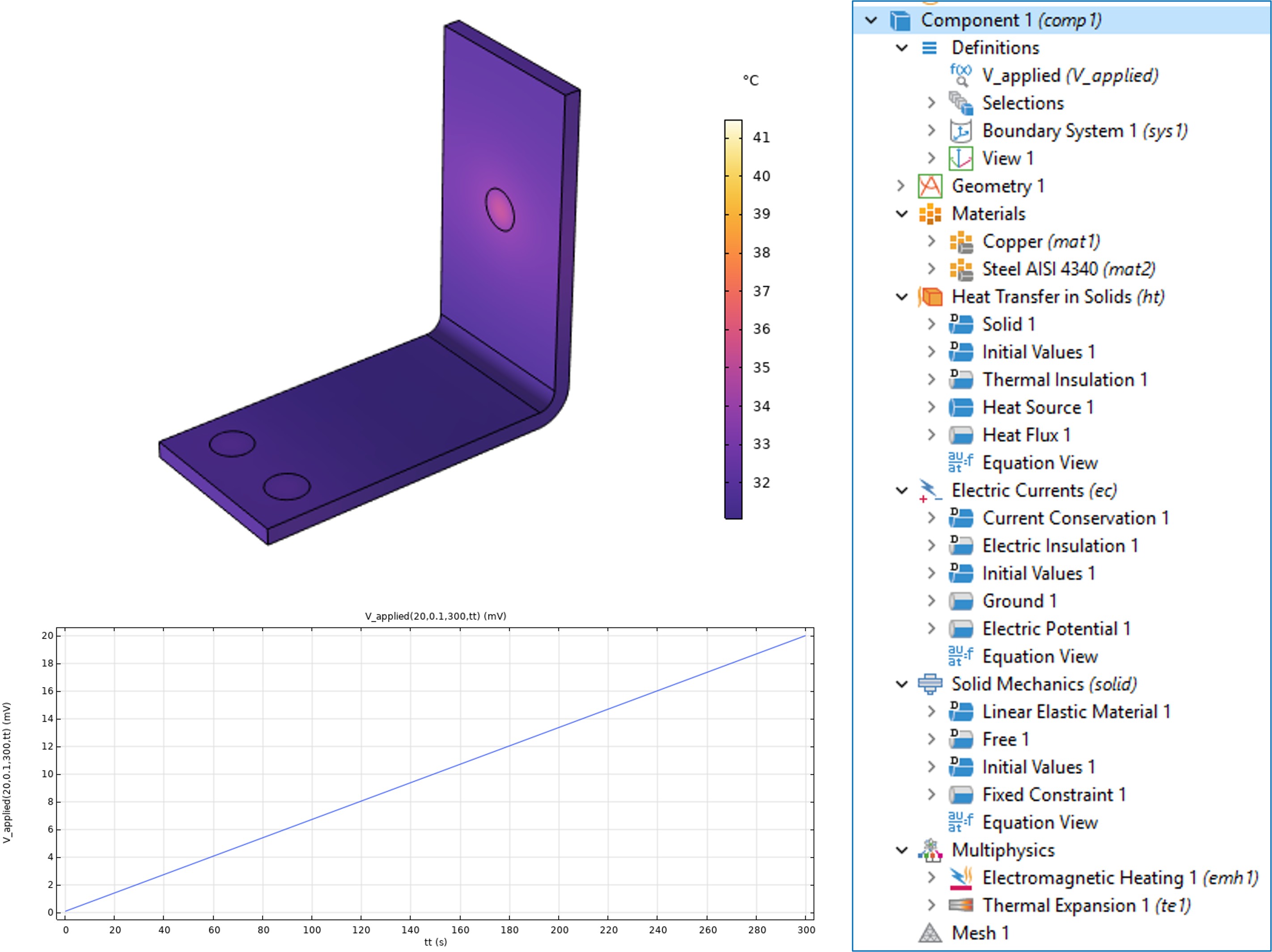

Veamos el clásico ejemplo de la barra colectora que se muestra en la Figura 2. La barra está sometida a una diferencia de potencial, y el paso de la corriente eléctrica provoca una generación de calor por efecto Joule. Debido a los gradientes de temperatura que se generarán en el sólido, el material sufrirá una deformación mecánica. De este modo las físicas involucradas son las siguientes: corrientes eléctricas, transferencia de calor y mecánica de sólidos.

Figura 2. Modelo 3D de la barra colectora con campo de temperaturas, físicas incluidas y evolución del potencial eléctrico aplicado en función del tiempo.

En el ejemplo, se lleva a cabo un estudio con dependencia temporal y un análisis paramétrico para distintas temperaturas del aire circundante a la barra, asumiendo un coeficiente de película convectivo de 5 W/(m2·K) (señalada en la Figura 2), el cual entra con una velocidad de 0.1 m/s. Las temperaturas que se evalúan están 1 y 40ºC. Por otra parte, el potencial que se aplica en la barra se modeliza con expresión analítica lineal en función del tiempo, desde 0 mV al inicio de la simulación hasta 20 mV al final de la misma, tal y como se muestra en la Figura 2.

Resultados obtenidos

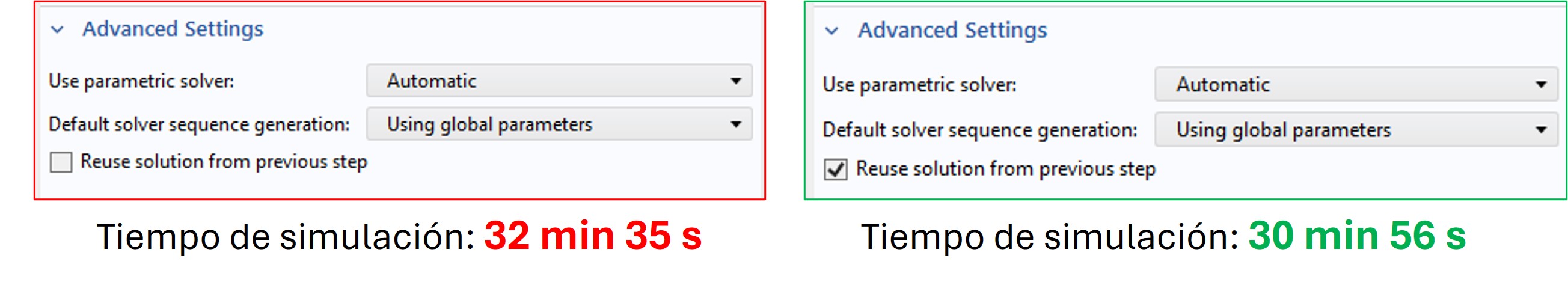

La Figura 3 permite comparar los tiempos de simulación obtenidos cuando se usa y cuando no se usa la función de “reuse solution”. Observamos que, con esta sencilla estrategia, se pueden reducir los tiempos de simulación en más de un 5%.

Figura 3. Comparativa de los tiempos requeridos para completar la simulación con dependencia temporal y análisis paramétrico cuando no se usa y cuando sí se usa la función “reuse solution”.

En definitiva, ¡aquí tenemos un “tip” sencillo para tener en cuenta a la hora de reducir los tiempos de simulación sin comprometer la precisión de los resultados!

- Detalles

- Categoría: Minitab

- Visto: 1320

Por Alyssa Sarro.

Dentro del equipo de Investigación y Desarrollo (I+D) de una empresa, encontrará un conjunto diverso de personas, desde científicos e ingenieros hasta gerentes de productos e investigadores de mercado. Además de la colaboración cruzada dentro de los equipos de I+D, existe una gran dependencia de otros departamentos, como el de fabricación, que desempeña un papel en los pasos que sigue un producto en su camino hacia el mercado. Los equipos de I+D son el motor de la innovación, impulsan el progreso dentro de sus organizaciones y dan forma al futuro del mañana. Entre los muchos desafíos que enfrentan los equipos de I+D, la clave para resolver sus problemas se encuentra en los datos. Analicemos las complejidades de I+D y veamos cómo el análisis de datos en Minitab hace que estas complejidades sean manejables.

Fase de investigación

La fase de investigación es el pilar fundamental del proceso de I+D, en el que se conciben y se ponen a prueba ideas innovadoras. Para garantizar el éxito de estas iniciativas, los investigadores recurren al análisis de datos y a las estadísticas para superar los desafíos y avanzar en su camino de I+D.

Antes de que una idea llegue al mercado, los investigadores empiezan por traducir las necesidades de los clientes en características mensurables del producto. Es allí donde se utilizan los conocimientos obtenidos a partir de la investigación de mercado para dar forma al desarrollo del producto. Esto ayuda al departamento de I+D a evaluar qué necesidades deben poder satisfacer para tener éxito en el mercado.

Veamos un ejemplo en el que se utiliza el software estadístico Minitab para comprender mejor cómo se puede utilizar el análisis de datos para validar la investigación de productos. Su equipo de I+D busca desarrollar un nuevo sistema de imágenes por ultrasonido. Dos aspectos fundamentales de este nuevo diseño son la portabilidad y la calidad de la imagen. Desea determinar si existe una diferencia significativa en las preferencias de los usuarios entre los diseños de las máquinas.

Los ingenieros de diseño y software pueden utilizar una prueba de 2 proporciones para analizar las preferencias de una muestra de profesionales médicos por diferentes atributos de los sistemas de ultrasonido. Por ejemplo, podrían presentarles a los participantes escenarios en los que tengan que elegir entre sistemas con mayor resolución de imagen pero menor portabilidad, y viceversa. Al analizar las respuestas, la prueba de 2 proporciones puede ayudar a determinar si existe una diferencia estadísticamente significativa en las preferencias entre las dos opciones de diseño. Este análisis puede brindar información valiosa sobre qué dirección de diseño priorizar para un mayor desarrollo.

Después de esta prueba inicial de investigación de mercado, el equipo de I+D puede estar seguro de que comprende las necesidades de los clientes, pero el desafío adicional radica en la viabilidad del producto . En otras palabras, ¿se puede diseñar y construir el producto con la tecnología existente según un estándar que se ajuste a las necesidades de los clientes?

La viabilidad del producto es importante por muchas razones. Cuando se realiza correctamente en la fase de investigación, los ingenieros pueden detectar posibles riesgos y desafíos para permitir una asignación adecuada de recursos, ahorrar tiempo y dinero. Demuestra la viabilidad del producto para dar confianza a las partes interesadas de cara al futuro.

Volviendo a nuestro ejemplo de ultrasonido, realizamos un diseño de experimentos (DOE) para poder evaluar el rendimiento del dispositivo en función de múltiples factores diferentes. A partir de nuestra investigación inicial, sabemos que la portabilidad y la resolución de la imagen son factores clave que se deben tener en cuenta al considerar otros factores.

Para investigar exhaustivamente el impacto de los diferentes materiales en el dispositivo de ultrasonidos, el equipo de I+D empleó un diseño factorial completo. Este enfoque implicó evaluar sistemáticamente todas las combinaciones posibles de tres factores clave: material (aluminio y plástico), espesor de la pared (dos niveles: fino y grueso) y la presencia o ausencia de nervaduras de refuerzo. Al probar cada una de estas combinaciones, el diseño factorial completo proporciona una imagen completa de cómo estos factores, tanto individualmente como en interacción, influyen en el rendimiento del dispositivo. Esta exploración exhaustiva permitirá al equipo obtener una comprensión profunda del espacio de diseño, lo que en última instancia conducirá a la identificación de la combinación óptima de factores que cumplan con los estrictos requisitos de portabilidad, resistencia, seguridad y precisión.

A lo largo de estos diferentes pasos, Minitab permitió a los investigadores maximizar el impacto de su trabajo y reducir los costos antes de que el producto avance más en el proceso de desarrollo. Al permitir a los investigadores analizar datos, probar hipótesis y optimizar procesos, Minitab contribuye al avance de los equipos de I+D en las primeras etapas de sus pruebas.

La fase de desarrollo

La fase de desarrollo es crucial para traducir los resultados de la investigación en productos y procesos tangibles. Esta fase implica un riguroso proceso de diseño, prueba y reelaboración. Para garantizar la calidad, la confiabilidad y la eficiencia del producto, los equipos de desarrollo se basan en información basada en datos. Minitab ofrece ese conjunto integral de herramientas necesarias para respaldar a los ingenieros en su trabajo.

Los desarrolladores buscan verificar y validar que el diseño propuesto va a ofrecer los resultados que buscan. En la fase de desarrollo, el enfoque se centra en definir las especificaciones de diseño y los procesos de fabricación. Con lo que los investigadores han proporcionado al equipo de I+D, los ingenieros del lado del desarrollo tienen la base que necesitan para llevar el producto a la meta.

Si analizamos dónde hemos dejado el sistema de imágenes por ultrasonido, los desarrolladores deben responder las siguientes preguntas:

“¿Cómo puedo garantizar que nuestros sistemas producirán resultados dentro de ciertas especificaciones?”

&

"¿Puedo tener la seguridad de que el producto funcionará como se espera después de su lanzamiento?"

Análisis de capacidad:

Para evaluar la capacidad del proceso de fabricación del sistema de obtención de imágenes por ultrasonido, los ingenieros pueden utilizar las herramientas de análisis de capacidad de Minitab. Pueden analizar la variación de las características clave de rendimiento, como la resolución de la imagen, la sensibilidad y la precisión, en múltiples ejecuciones de producción. Al comparar el resultado del proceso con especificaciones predefinidas (por ejemplo, resolución mínima aceptable, error máximo permitido), los ingenieros pueden determinar si el proceso es capaz de producir de manera constante sistemas que cumplan con los estándares de rendimiento requeridos.

Por ejemplo, si el análisis revela que el proceso no es capaz, los ingenieros pueden usar Minitab para identificar las causas fundamentales de la variación . Esto podría implicar analizar los datos del proceso para identificar los pasos o las máquinas específicas que contribuyen a la variabilidad. Una vez identificadas las causas fundamentales, los ingenieros pueden implementar acciones correctivas, como ajustar la configuración de la máquina, mejorar la capacitación de los operadores o modificar el proceso de fabricación. Al monitorear y analizar continuamente los datos de capacidad del proceso, los ingenieros pueden garantizar que los sistemas de imágenes por ultrasonido cumplan constantemente con los altos estándares requeridos para las aplicaciones médicas.

Análisis de confiabilidad:

Para garantizar la confiabilidad a largo plazo del sistema de imágenes por ultrasonido, los ingenieros pueden utilizar las herramientas de análisis de confiabilidad de Minitab. Pueden realizar análisis de datos de vida útil en sistemas o componentes prototipo, como el transductor o la batería, para estimar su vida útil esperada y predecir las tasas de fallas.

Por ejemplo, los ingenieros pueden utilizar el análisis de Weibull para modelar el comportamiento de falla de la batería. Al analizar los datos de las pruebas de vida acelerada, en las que las baterías se someten a temperaturas o voltajes más altos, pueden predecir la vida útil de la batería en condiciones normales de funcionamiento. Esta información es crucial para determinar el período de garantía, planificar los programas de mantenimiento y garantizar la satisfacción del cliente.

Además, el análisis de confiabilidad puede ayudar a identificar posibles debilidades en el diseño. Al analizar los modos de falla de los sistemas prototipo, los ingenieros pueden identificar áreas de mejora e implementar cambios de diseño para mejorar la confiabilidad y durabilidad generales del sistema de imágenes por ultrasonido.

El proceso de I+D es un ciclo continuo de aprendizaje y mejora. Mientras que la investigación se centra en generar nuevos conocimientos y explorar territorios inexplorados, el desarrollo traduce estos descubrimientos en potencial de mercado. Al fomentar una comprensión clara de los objetivos de cada uno y aprovechar los conocimientos de Minitab, las organizaciones pueden garantizar que los esfuerzos de investigación estén alineados estratégicamente con los objetivos de desarrollo, maximizando así el retorno de la inversión en innovación.

- Detalles

- Categoría: Lakes

- Visto: 1690

La nueva versión contiene las siguientes implementaciones:

- Modelos actualizados: Nuevos ejecutables AERMOD, AERMAP, AERMET y AERSURFACE (versión 24142) de la EPA de EE.UU. en compilaciones de 32 bits y 64 bits.

- Versión paralela actualizada de AERMOD y AERMAP: Nuevas versiones de MPI (paralelo) para las actualizaciones de AERMOD y AERMAP con fecha 24142.

- Nuevas opciones regulatorias predeterminadas: En AERMOD 24142, la fuente móvil RLINE, el método de conversión GRSM NO2 y los datos meteorológicos COARE ahora se admiten en el modo predeterminado regulatorio (DFAULT).

- Actualizaciones de WebGIS: Los últimos productos de datos de cobertura del suelo de MRLC están disponibles para su descarga en la utilidad AERSURFACE de AERMET View.

- Notas adicionales: Revise las notas de la versión completas para obtener una lista detallada de todos los cambios.

- Detalles

- Categoría: NAG

- Visto: 2098

Introducción

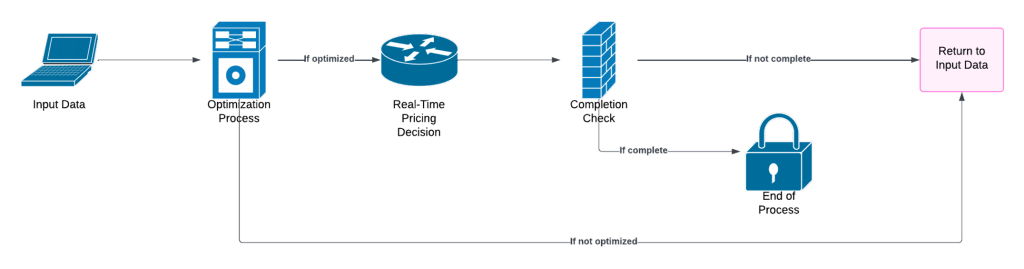

El aprendizaje automático (ML) está transformando la forma en que resolvemos problemas, analizamos datos y tomamos decisiones. Pero para liberar todo su potencial, las técnicas de optimización desempeñan un papel fundamental. Esta guía explora cómo la optimización se relaciona con el aprendizaje automático para crear sistemas más inteligentes, rápidos y eficientes, que resuelvan desafíos complejos del mundo real en sectores como las finanzas, la logística y la atención sanitaria.

Antes de profundizar en el tema, aclaremos los conceptos básicos.

¿Qué es el aprendizaje automático (ML)?

El aprendizaje automático es un sistema de inteligencia artificial que permite a los ordenadores aprender de los datos y hacer predicciones o tomar decisiones sin estar programadas explícitamente.

- Programación tradicional: seguir instrucciones fijas y predefinidas.

- Aprendizaje automático: aprenda patrones a partir de datos y mejore el rendimiento a lo largo del tiempo.

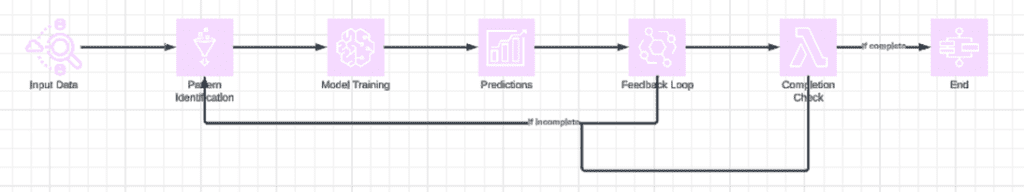

Cómo funciona

- Alimente el modelo con datos.

- El modelo analiza los datos, identifica patrones y genera información.

- A medida que el modelo procesa más datos, ajusta y mejora sus predicciones.

Principales tipos de aprendizaje automático

El aprendizaje automático se clasifica normalmente en tres tipos:

Aprendizaje supervisado

Definición: Los modelos aprenden de datos etiquetados (datos con respuestas correctas).

Ejemplos:

- Regresión: predice valores continuos (por ejemplo, precios de la vivienda).

- Clasificación: predice categorías (por ejemplo, spam vs. no spam).

2. Aprendizaje no supervisado

Definición: Los modelos analizan datos no etiquetados para encontrar patrones ocultos.

Ejemplo:

- Agrupamiento: Agrupar clientes según su comportamiento de compra.

3. Aprendizaje por refuerzo

Definición: Los modelos aprenden interactuando con un entorno y recibiendo recompensas o penalizaciones por sus acciones. Ejemplo:

- Entrenar robots para caminar u optimizar el uso energético del hogar.

¿Por qué es importante el aprendizaje automático?

El aprendizaje automático está transformando las industrias al mejorar la eficiencia, la toma de decisiones y la resolución de problemas. A continuación, se ofrecen algunos ejemplos:

- Fabricación: Predecir fallas de máquinas para permitir el mantenimiento preventivo y reducir costos.

- Finanzas: Detecte transacciones fraudulentas en tiempo real y personalice servicios financieros, como préstamos a medida.

- Logística: Optimice las rutas de entrega para ahorrar tiempo y combustible.

Atención médica: analizar datos médicos para ayudar con diagnósticos tempranos y planes de tratamiento personalizados.

¿Qué son las técnicas de optimización?

Las técnicas de optimización son métodos matemáticos que se utilizan para mejorar los modelos de aprendizaje automático. Buscan la mejor solución posible a un problema, a menudo minimizando los errores (funciones de pérdida) o maximizando el rendimiento (precisión).

Técnicas de optimización habituales

1. Descenso de gradiente

- Qué hace: ajusta los parámetros de un modelo paso a paso para minimizar los errores.

- Por qué es importante: es la columna vertebral del entrenamiento de la mayoría de los modelos de ML, ya que garantiza que los modelos converjan en la solución óptima.

2. Recocido simulado

- Cómo funciona: se inspira en el enfriamiento de metales. Explora soluciones, incluidas algunas menos óptimas inicialmente, para evitar quedarse estancado en una “mejor” solución local.

- Ideal para: problemas complejos con espacios de soluciones impredecibles (por ejemplo, programación, optimización de rutas).

3. Optimización bayesiana

- Qué hace: utiliza probabilidades para predecir la calidad de las soluciones antes de probarlas.

- Beneficio clave: ideal para ajustar hiperparámetros, ahorrando tiempo y recursos computacionales significativos.

4. Algoritmos genéticos

- Cómo funciona: Imita la selección natural:

- Comience con múltiples soluciones.

- Seleccione lo mejor.

- Combínalos (cruzalos) y modifícalos (muta) para mejorar los resultados.

- Ideal para: problemas con múltiples respuestas posibles, como optimización del diseño y programación.

5. Adagrado

- Qué hace: ajusta las tasas de aprendizaje individualmente para cada parámetro en función de gradientes anteriores.

- Por qué es útil: Perfecto para manejar datos dispersos (por ejemplo, procesamiento de texto o imágenes), ya que se centra en características menos frecuentes para un mejor aprendizaje.

Ahora que hemos sentado las bases para el aprendizaje automático y la optimización, profundicemos más. En las siguientes secciones, exploraremos cómo las técnicas de optimización potencian el rendimiento del aprendizaje automático, abordan desafíos del mundo real y crean valor tangible en todas las industrias.

Fundamentos de optimización matemática

¿Qué es la optimización matemática?

En esencia, la optimización matemática es el proceso de encontrar la mejor solución posible para un problema determinado en un conjunto definido de condiciones o restricciones. Esto implica:

- Maximizar o minimizar una función objetivo: una fórmula matemática que representa el objetivo (por ejemplo, minimizar el costo, maximizar la precisión).

- Satisfacer restricciones: reglas que restringen las posibles soluciones (por ejemplo, recursos o tiempo limitados).

Expresión matemática

Optimiza: f(x) sujeto a las restricciones g(x) ≤ c

Dónde:

f(x): Función objetivo a maximizar o minimizar.

g(x): Restricciones limitantes de x.

c: Límites de las restricciones.

Por ejemplo, en ML, f(x) podría representar la función de pérdida (tasa de error) y el objetivo es minimizarla durante el entrenamiento del modelo.

Principales aplicaciones del aprendizaje automático

La optimización matemática proporciona la base para muchos procesos críticos en el aprendizaje automático. Analicemos sus principales aplicaciones:

1. Modelos de entrenamiento: minimización de funciones de pérdida

- Qué significa: Durante el entrenamiento, los modelos de ML tienen como objetivo minimizar una función de pérdida, que cuantifica qué tan lejos están las predicciones de los valores reales. Los algoritmos de optimización ajustan los parámetros (por ejemplo, pesos y sesgos) para reducir este error paso a paso.

- Ejemplo: una red neuronal que predice los precios de la vivienda utiliza la optimización para minimizar la diferencia entre los precios previstos y los reales.

2. Ajuste de hiperparámetros: búsqueda de configuraciones óptimas

- Qué significa: Los hiperparámetros son configuraciones (por ejemplo, tasa de aprendizaje, tamaño de lote) que controlan cómo aprenden los modelos de ML. Las técnicas de optimización ayudan a encontrar los mejores hiperparámetros para maximizar el rendimiento.

- Por qué es fundamental: Las configuraciones de hiperparámetros deficientes pueden generar modelos que se sobreajusten, se desajustan o se entrenan demasiado lentamente.

- Ejemplo: la optimización bayesiana predice la mejor combinación de hiperparámetros para reducir el gasto computacional y aumentar la precisión del modelo.

3. Asignación de recursos: garantizar la eficiencia computacional

- Qué significa: Los modelos de ML suelen requerir recursos importantes, como memoria y tiempo de GPU. La optimización garantiza que los recursos se asignen de manera eficiente para equilibrar los costos y el rendimiento.

- Ejemplo: Los sistemas de aprendizaje automático distribuido optimizan el uso de recursos en varias GPU para reducir el tiempo de entrenamiento y, al mismo tiempo, respetar los límites de costos. Las plataformas en la nube asignan dinámicamente los recursos del servidor para equilibrar las cargas y ahorrar energía.

Perspectiva más amplia

Si bien el aprendizaje automático aprovecha en gran medida la optimización, es importante reconocer que la optimización matemática es un marco universal. Más allá del aprendizaje automático, se utiliza para:

- Optimizar rutas de entrega en logística.

- Asignar recursos para carteras financieras.

- Agilizar los cronogramas de producción en la industria manufacturera.

Esta versatilidad hace que la optimización sea una herramienta indispensable en todas las industrias, permitiendo una toma de decisiones más inteligente y una mayor eficiencia.

Uniéndolo todo

La optimización matemática proporciona la columna vertebral teórica para muchas tareas de aprendizaje automático, desde la minimización de funciones de pérdida hasta la asignación eficiente de recursos. Comprender estos fundamentos es crucial para liberar todo el potencial de los modelos de aprendizaje automático para resolver problemas del mundo real.

La intersección de la optimización y la IA/ML

La optimización matemática y el aprendizaje automático (ML) no solo coexisten, sino que se impulsan mutuamente. La optimización funciona como el motor que impulsa la eficiencia y la eficacia del ML, lo que permite algoritmos más inteligentes, decisiones más rápidas y mejores resultados en todas las industrias. Analicemos esto.

Cómo las técnicas de optimización potencian el aprendizaje automático

1. Eficiencia del entrenamiento

- Qué significa: La optimización es la columna vertebral del entrenamiento de los modelos de ML. Al minimizar la función de pérdida, ayuda a que los algoritmos aprendan más rápido y con menos recursos computacionales.

- Ejemplo: Gradient Descent y sus variantes (por ejemplo, Adam, RMSProp) refinan iterativamente los parámetros del modelo, garantizando que los modelos converjan a la mejor solución de manera eficiente.

- Por qué es importante: Una convergencia más rápida significa menor tiempo de entrenamiento, menores costos computacionales y una implementación más rápida de soluciones de ML.

2. Modelos de toma de decisiones

- Qué significa: La optimización permite que los modelos de ML tomen decisiones maximizando o minimizando objetivos específicos bajo restricciones.

Aplicaciones

- Precios dinámicos: los modelos de optimización ayudan a las empresas a establecer precios en tiempo real, equilibrando la oferta, la demanda y los márgenes de ganancia.

- Gestión de cartera: Los algoritmos optimizan la asignación de activos, teniendo en cuenta el riesgo y la rentabilidad.

- Ejemplo: Netflix utiliza sistemas de recomendación basados en optimización para determinar el mejor contenido para sugerir a usuarios individuales.

3. Aprendizaje por refuerzo

- Qué significa: El aprendizaje de refuerzo (RL) aprovecha la optimización para permitir que los agentes aprendan estrategias óptimas maximizando las recompensas acumuladas a lo largo del tiempo.

- Cómo funciona: Los problemas de RL se enmarcan como procesos de decisión de Markov (MDP), donde la optimización determina las mejores acciones que un agente debe tomar en un estado determinado.

- Ejemplo: Los vehículos autónomos utilizan RL para optimizar las estrategias de conducción, equilibrando la velocidad, la seguridad y la eficiencia del combustible.

- Por qué es importante: sin optimización, los agentes de RL tendrían dificultades para identificar políticas efectivas en entornos complejos de varios pasos.

Estudio de caso: Cómo el aprendizaje automático redujo los costos y aceleró los resultados

Aviso legal. Este escenario ficticio ilustra el potencial transformador del aprendizaje automático (ML) en la logística. Está diseñado con fines educativos y no se basa en un relato real.

SwiftRoute estaba perdiendo dinero, perdiendo tiempo y frustrando a los clientes. Las rutas de entrega ineficientes, los costos de combustible en aumento y los plazos incumplidos estaban hundiendo sus ganancias y la satisfacción de los clientes.

- Rutas ineficientes: los conductores tardaron un 20% más en completar las entregas que sus competidores.

- Costes en aumento: el consumo de combustible y el mantenimiento del vehículo reducen profundamente los márgenes de ganancia.

- Plazos incumplidos: las tasas de entrega a tiempo cayeron por debajo del 75 %, lo que generó enojo y pérdida de clientes.

Ante la creciente competencia y la reducción de los márgenes, SwiftRoute necesitaba una solución para recuperar el control y reconstruir la confianza.

La solución: logística impulsada por ML

SwiftRoute adoptó un enfoque de aprendizaje automático para optimizar las operaciones:

Limpieza de datos:

- Años consolidados de datos confusos de GPS, entregas y flotas.

- Se eliminaron duplicados y errores para crear un conjunto de datos confiable para el análisis.

Desarrollo de modelos ML:

- Desarrollé modelos predictivos para ajustar dinámicamente las rutas de entrega en tiempo real según el tráfico, el clima y las cargas de paquetes.

- Programación lineal aplicada y aprendizaje de refuerzo para la optimización de rutas.

Prueba piloto:

- Implementamos la solución ML con una pequeña flota para identificar debilidades y ajustar el sistema.

Implementación en toda la empresa:

- Se adaptó la solución a toda la flota y se capacitó a los conductores utilizando herramientas gamificadas para garantizar la aceptación y una adopción sin problemas.

Los resultados: victorias tangibles

SwiftRoute transformó sus operaciones logísticas y logró un éxito medible:

- Entregas más rápidas: los tiempos promedio de ruta disminuyeron considerablemente.

- Ahorros: La reducción del consumo de combustible y la optimización del uso del vehículo dieron como resultado una disminución de gastos.

- Satisfacción del cliente mejorada: entregas puntuales mejoradas.

- Ahorros operativos totales: ganancias de eficiencia en todos los ámbitos.

Los obstáculos y cómo los superaron

El viaje de SwiftRoute no estuvo exento de desafíos, pero las acciones estratégicas los ayudaron a superar los obstáculos:

Datos desordenados: se invirtió tiempo y esfuerzo en limpiar y estandarizar años de datos inconsistentes.

Resistencia del conductor: Los programas de capacitación gamificados incentivaron a los conductores a adoptar el nuevo sistema y brindaron apoyo continuo.

Refinamiento del modelo: las actualizaciones iterativas mejoraron la capacidad del modelo para manejar datos meteorológicos y de tráfico en tiempo real.

Conclusiones para los investigadores de operaciones

El éxito de SwiftRoute ofrece información útil:

Comience poco a poco: realice pruebas piloto para validar las soluciones de ML antes de ampliarlas a otras operaciones.

Priorizar la calidad de los datos: unos datos limpios y confiables son la base de cualquier iniciativa de aprendizaje automático exitosa.

Invertir en la capacitación del equipo: involucre a las partes interesadas desde el principio para garantizar la adopción y el éxito a largo plazo.

Mida los KPI sin descanso: realice un seguimiento de las métricas clave (por ejemplo, tiempo de entrega, ahorro de costos, satisfacción del cliente) para demostrar el ROI y perfeccionar la solución.

- Detalles

- Categoría: Comsol

- Visto: 2178

La actualización Update 1 de la versión 6.3 del software COMSOL® (compilación 6.3.0.335) proporciona mejoras de rendimiento y estabilidad para COMSOL Multiphysics®, COMSOL Server™, COMSOL Client para su uso con COMSOL Server™ y Model Manager Server.

La actualización se aplica a la versión 6.3 del software COMSOL® (compilación 6.3.0.290).

A continuación listamos algunas mejoras introducidas en la actualización:

COMSOL Multiphysics

- La ventana Chatbot ahora admite la funcionalidad de Azure OpenAI Service.

- Mejoras significativas en la funcionalidad de limpieza de geometría y la operación virtual de fusión de caras.

- Se solucionó un problema que provocaba que apareciera texto negro sobre un fondo negro al editar celdas de una tabla mientras se usaba una combinación de tema oscuro en COMSOL Multiphysics® y tema oscuro de alto contraste en Windows®.

- Las funciones externas ahora producen un error cuando sus nombres entran en conflicto con los nombres reservados.

- Se resolvió un problema por el cual COMSOL Multiphysics® dejaba de responder al evaluar un conmutador de función que contenía una rama de función que dependía de una función global o local definida por el usuario con la misma etiqueta de nodo que la rama.

- En las interfaces de malla móvil y geometría deformada, las expresiones que definen el desplazamiento de la malla en un nodo de deformación prescrita ahora se evalúan directamente en los límites cuando se utilizan las coordenadas de los límites. Este cambio puede producir resultados diferentes en comparación con las versiones anteriores si las expresiones involucran variables que son discontinuas entre el límite y los dominios adyacentes. Anteriormente, el desplazamiento del límite se determinaba promediando las expresiones evaluadas en los dominios adyacentes.

- Para mejorar el rendimiento al utilizar casos de carga, el resolvedor paramétrico ahora utiliza la opción Automático para el orden de ejecución del valor de parámetro . Si esto genera un comportamiento inesperado, es posible utilizar el valor predeterminado anterior Según lo especificado .

- Las variables dependientes de la salida para los modelos de orden reducido ahora almacenan consistentemente los valores correctos, independientemente del orden en que se enumeran las salidas en el nodo de reducción del modelo.

- Para los modelos de orden reducido con salidas lineales y retroalimentación de entrada, el vector de sesgo de salida ahora se calcula correctamente cuando las entradas tienen valores de entrenamiento distintos de cero.

- Los operadores de vibración aleatoria ahora son compatibles con la opción de cálculo de flujo de contorno en la sección Discretización de la ventana Configuración para las interfaces de mecánica estructural relevantes. Esta opción está disponible cuando se habilita la configuración Opciones de física avanzadas .

- La interfaz de usuario para el paso de estudio de reducción del modelo se ha simplificado para el método de descomposición ortogonal (POD) adecuado.

- Se ha mejorado el mapeo de objetos de solución con datos adicionales, como soluciones anteriores y vectores propios izquierdos, para lograr una mayor solidez. Sin embargo, los objetos de solución antiguos aún pueden contener datos corruptos y causar errores internos cuando se utilizan. En tales casos, se recomienda volver a calcular la solución.

- Se ha mejorado el rendimiento de las animaciones de cámara.

- Se corrigió un error que impedía el uso de la Actualización de la biblioteca de aplicaciones en Linux ® con libwebkit2gtk-4.1 o superior, por ejemplo, en Ubuntu ® 24.04.

- La herramienta de administración de licencias lmadmin se ha eliminado del conjunto de instalación debido a vulnerabilidades de seguridad.

- Mejoras de seguridad, rendimiento, usabilidad y estabilidad.

Application Builder

- Se resolvió un problema en el que las secciones de la cinta en las aplicaciones aparecían habilitadas a pesar de estar inicialmente deshabilitadas.

- Se corrigió un error que podía impedir la apertura de archivos de modelos compilados para Java.

- Mejora del rendimiento del editor de formularios para aplicaciones con una gran cantidad de formularios.

- Mejoras de estabilidad.

Model Manager

- Mejoras de estabilidad.

Model Manager Server

Se solucionó un problema con el lanzamiento de un servidor Model Manager en sistemas Linux ® con kernels de tamaño de página grande, como Ubuntu® arm64+largemem. Un servidor de Model Manager ahora escribe un mensaje de error en la línea de comando y en el archivo de registro si el servidor no puede iniciarse debido a que un puerto ya está ocupado. La fecha mostrada en la interfaz web para un atributo primitivo del tipo de valor Fecha ya no depende de la zona horaria local del usuario. Mejoras de estabilidad.AC/DC Module

- Mejoras de estabilidad.

Acoustics Module

- Mejoras de estabilidad.

Battery Design Module

- Mejoras de estabilidad.

CAD Import Module

- Se agregó soporte para importar archivos ACIS® 2025 1.0 y SOLIDWORKS ® 2025 en Windows® y Linux®.

- Mejoras de estabilidad.

CFD Module

- Las nuevas configuraciones predeterminadas del resolvedor para simulaciones de flujo de fluidos estacionarios brindan reducciones sustanciales del tiempo de solución en la mayoría de los casos. Las nuevas configuraciones se aplican a la secuencia del resolvedor cuando se agrega un estudio estacionario o un paso de estudio estacionario , cuando las configuraciones del resolvedor se restablecen a sus valores predeterminados y a los estudios estacionarios existentes para los cuales no se ha editado el nodo Configuraciones del resolvedor.

- Mejoras de estabilidad.

Chemical Reaction Engineering Module

- Las advertencias de varias funciones de acoplamiento ahora solo se muestran cuando se resuelven las ecuaciones afectadas.

- Ahora se muestra una advertencia cuando las ecuaciones de transporte de masa en forma no conservativa se acoplan con un flujo de fluido compresible para las funciones de acoplamiento Flujo de reacción, Especies diluidas y Precipitación en flujo de fluido .

- Mejoras de estabilidad.

Composite Materials Module

- Mejoras de estabilidad.

Corrosion Module

- Mejoras de estabilidad.

Design Module

- Mejoras de estabilidad.

ECAD Import Module

- Mejoras de estabilidad.

Electric Discharge Module

- Definiciones de variables mejoradas para la emisión de electrones de campo de la función Electrodo en la interfaz de Descarga eléctrica.

- Mejoras de estabilidad.

Electrochemistry Module

- Mejoras de estabilidad.

Geomechanics Module

- Mejoras de estabilidad.

Heat Transfer Module

- Mejoras de estabilidad.

LiveLink™ for Inventor®

- Mejoras de estabilidad.

LiveLink™ for MATLAB®

- Mejoras de estabilidad.

LiveLink™ for Revit®

- Mejoras de estabilidad.

Metal Processing Module

- Mejoras de estabilidad.

Nonlinear Structual Materials Module

- Mejoras de estabilidad.

Optimization Module

- Mejoras de rendimiento para funciones de control y optimizaciones transitorias.

- Mejoras de estabilidad.

Pipe Flow Module

- Mejoras de estabilidad.

RF Module

- Mejoras de estabilidad.

Rotordynamics Module

- Mejoras de estabilidad.

Semiconductor Module

- Se corrigió un error en el que aparecía una advertencia falsa para el modelo de tunelaje WKB .

Structural Mechanics Module

- Se corrigió un error de falta de memoria que podía ocurrir cuando una interfaz de Layered Shell y una función de contacto estaban presentes simultáneamente.

- Se solucionó un problema con la generación automática de pruebas de materiales desde el nodo Material de prueba cuando una interfaz de Mecánica de sólidos o un subnodo Modelo de material usa selecciones de dominio manuales.

- Mejoras de estabilidad.

Uncertainty Quantification Module

- Mejoras de estabilidad.

Wave Optics Module

- Mejoras de estabilidad.

ACIS es una marca registrada de Spatial Corporation. Autodesk, el logotipo de Autodesk, Inventor y Revit son marcas registradas o marcas comerciales de Autodesk, Inc. y/o sus subsidiarias y/o afiliadas en los EE. UU. y/o en otros países. Linux es una marca registrada de Linus Torvalds en los EE. UU. y en otros países. macOS es una marca registrada de Apple Inc. en los EE. UU. y en otros países. MATLAB y Simulink son marcas registradas de The MathWorks, Inc. Microsoft, Excel y Windows son marcas registradas o marcas comerciales de Microsoft Corporation en los Estados Unidos y/o en otros países. SOLIDWORKS es una marca registrada de Dassault Systèmes. SolidWorks Corp. Ubuntu es una marca registrada de Canonical Ltd.